Acumos 플랫폼을 통한 머신러닝 모델 패키징 및 공유

초록

Acumos는 머신러닝 모델을 Docker 기반 마이크로서비스로 패키징하고, 메타데이터와 함께 카탈로그에 등록해 손쉽게 재사용·배포할 수 있게 하는 오픈 플랫폼이다. 모델 개발자는 선호하는 언어와 라이브러리를 사용해 모델을 업로드하고, 플랫폼은 자동으로 의존성을 추출·컨테이너화한다. 엔드유저는 Docker 이미지와 REST API만으로 모델을 호출해 비즈니스 애플리케이션에 통합할 수 있다. 사례 연구에서는 감성 분석 모델을 공유함으로써 데이터 라벨링·학습 비용을 크게 절감하고, 적은 학습 데이터로도 높은 AUC를 달성함을 보여준다.

상세 분석

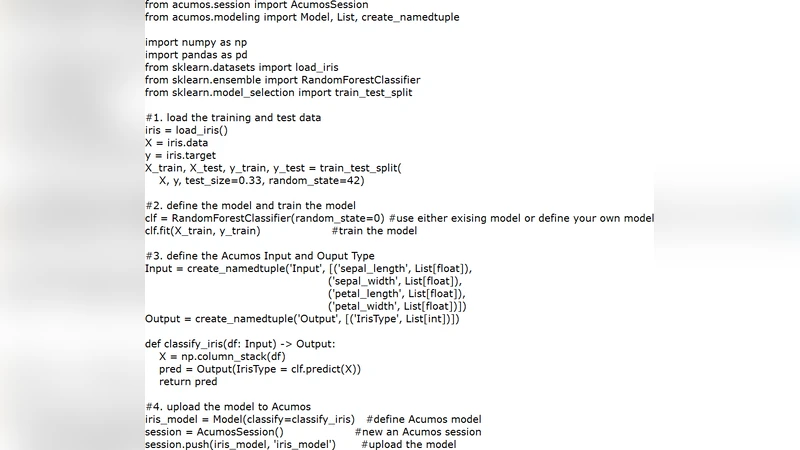

Acumos는 머신러닝 모델의 “패키징‑공유‑배포” 전 과정을 표준화함으로써 기존의 모델 재사용 장벽을 크게 낮춘다. 첫 번째 핵심은 다중 언어·프레임워크 지원이다. Python, R, Java API를 제공해 scikit‑learn, TensorFlow, Spark MLlib 등 다양한 라이브러리로 만든 모델을 그대로 온보딩할 수 있다. 모델 업로드 시 플랫폼은 정적·동적 분석을 결합해 의존성 라이브러리를 자동 추출하고, 이를 기반으로 Dockerfile을 생성한다. 이 과정에서 사용자는 별도의 의존성 명세서를 작성할 필요가 없으며, 모델 자체는 블랙박스로 취급돼 지적 재산권 보호와 프라이버시 유지가 가능하다.

두 번째 핵심은 모델‑레벨 격리와 마이크로서비스화이다. Acumos는 모델을 독립적인 컨테이너 이미지로 변환하고, RESTful 인터페이스를 자동 생성한다. 이를 통해 엔드유저는 클라우드든 온프레미스든 Docker를 지원하는 환경이면 즉시 모델을 배포하고 호출할 수 있다. 또한, Kubernetes와 같은 오케스트레이션 툴과의 연동이 가능해 대규모 서비스 운영에도 적합하다.

세 번째는 메타데이터 기반 검색·카탈로그 기능이다. 모델을 퍼블리시할 때 입력·출력 스키마, 모델 설명, 적용 도메인 등을 기술하면, 다른 사용자는 키워드와 스키마 매칭을 통해 적합한 모델을 손쉽게 찾을 수 있다. 이는 기존 ModelDB·OpenML이 제공하는 소스코드 수준 공유와 달리, 실행 가능한 Docker 이미지 자체를 배포함으로써 “즉시 사용 가능한” 모델 생태계를 만든다.

논문에서 제시한 감성 분석 사례는 두 가지 시나리오를 비교한다. Acumos를 이용해 IMDB 데이터셋으로 사전 학습된 모델을 공유받은 경우, Amazon 리뷰 500건에 대해 AUC 0.9376을 기록했다. 반면, 동일한 모델을 직접 Amazon 데이터만으로 학습하면 10,000건 이상의 라벨링이 필요했으며, 성능도 뒤처졌다. 이는 사전 학습된 모델을 재사용함으로써 라벨링 비용·컴퓨팅 비용을 크게 절감하고, 데이터 불일치 문제도 완화할 수 있음을 실증한다.

마지막으로, Acumos는 오픈소스 기반이므로 기업 내부에서 사설 레지스트리를 운영하거나, KubeFlow와 같은 추가 도구와 연계해 파이프라인을 확장할 수 있다. 다만 현재 지원 언어·프레임워크가 제한적이며, 복잡한 파이프라인(예: 실시간 스트리밍)에서는 추가적인 오케스트레이션 레이어가 필요할 수 있다. 전반적으로 Acumos는 모델 재사용을 촉진하고, 비전문가가 ML 서비스를 손쉽게 도입하도록 돕는 실용적인 플랫폼이라 평가된다.

댓글 및 학술 토론

Loading comments...

의견 남기기