자동 딥 뉴럴 네트워크 설계: 효율적 전역 최적화(EGO) 기반 구성 방법

초록

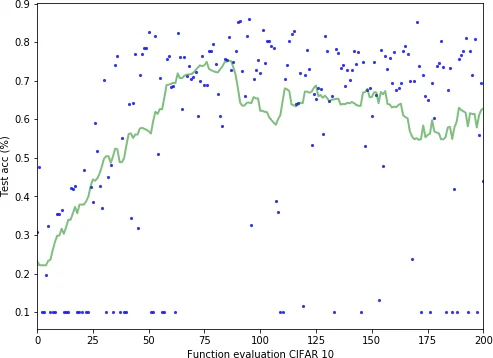

본 논문은 효율적 전역 최적화(EGO) 알고리즘을 활용해, 순수 컨볼루션 레이어만으로 구성된 가변형 CNN 아키텍처를 자동으로 탐색한다. 초기 라틴 하이퍼큐브 샘플링과 랜덤 포레스트 메타모델을 결합하고, 다중 온도 파라미터를 이용한 MGF 기반 인필 기준을 병렬로 최적화한다. 200번의 평가(각 10~50 epoch)만으로 MNIST와 CIFAR‑10에서 기존 수작업 설계와 경쟁력 있는 정확도를 달성한다.

상세 분석

이 연구는 딥러닝 모델 설계의 두 가지 핵심 난제를 동시에 해결한다. 첫째, 하이퍼파라미터와 구조적 선택이 뒤섞인 고차원·이산·연속 혼합 탐색 공간을 정의하고, 이를 26개의 고정 파라미터(3개의 스택 사용 시)와 학습률·감쇠율 등 2개의 최적화 파라미터로 제한한다. 각 스택은 필터 수(f), 커널 크기(k), L2 정규화, 스트라이드(s), 활성화 함수(a), 드롭아웃 비율(d) 등 7개의 독립 파라미터와 2개의 공유 파라미터를 갖는다. 이러한 설계는 얕은 네트워크부터 6계층까지 깊은 네트워크까지 포괄할 수 있어 탐색 범위가 넓지만, 파라미터 수가 고정돼 메타모델 학습이 용이하다.

둘째, 탐색 알고리즘으로 EGO를 선택했는데, 전통적인 가우시안 프로세스 대신 랜덤 포레스트를 메타모델로 채택해 이산·정수 변수 처리 능력을 강화했다. 초기 설계는 라틴 하이퍼큐브 샘플링(LHS)으로 다변량 공간을 균등히 커버하고, 이후 MGF 기반 인필 기준(M(x; t))을 사용한다. 이 기준은 온도 파라미터 t를 로그 정규 분포에서 샘플링해 q개의 서로 다른 탐색 성향(탐험 vs 활용)을 동시에 생성한다. 온도가 클수록 불확실성이 큰 후보를 우선 선택해 전역 탐색을 촉진하고, 작을수록 현재 메타모델의 예측값을 활용해 지역 최적화를 진행한다.

병렬 실행을 위해 각 온도에 대해 MIES(Mixed‑Integer Evolution Strategy)로 최적화된 후보 x₀ᵢ를 도출하고, GPU 클러스터에서 동시에 학습·평가한다. 이렇게 하면 EGO의 전통적인 순차적 특성을 깨고, 평가 비용이 높은 딥러닝 훈련을 효율적으로 분산시킬 수 있다.

실험에서는 MNIST와 CIFAR‑10 두 데이터셋에 대해 각각 200번의 후보 평가(각 후보는 10 epoch 또는 50 epoch)만 수행했음에도 불구하고, 최종 선택된 아키텍처는 기존 수작업 설계와 비슷하거나 약간 높은 정확도를 기록했다. 특히 데이터 증강이나 사전 지식 없이도 경쟁력을 확보했다는 점이 주목할 만하다. 연구는 또한 평가 예산이 제한된 상황에서도 충분히 좋은 구조를 찾을 수 있음을 실증했으며, 탐색 비용을 크게 절감하면서도 모델 성능을 유지하는 방법론을 제시한다.

이러한 접근은 (1) 탐색 공간을 명확히 정의하고 파라미터 수를 고정해 메타모델 학습을 안정화, (2) 랜덤 포레스트 기반 메타모델로 이산·연속 변수 모두를 효과적으로 예측, (3) 온도 기반 다중 인필 기준으로 탐색 다양성을 확보, (4) 병렬 후보 평가로 실용적인 시간 절감을 달성한다는 점에서 기존 자동화 설계 기법(베이지안 최적화, 진화 알고리즘 등)보다 실용적·효율적이다. 향후 연구에서는 더 큰 데이터셋·복합 태스크, 그리고 다른 네트워크 블록(예: residual, attention)까지 확장하는 것이 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기