다중 평가자 신뢰도 분석 도구 InterRater

초록

InterRater는 여러 평가자가 동일한 대상에 대해 부여한 점수를 비교해 Fleiss kappa를 계산하고, 각 평가자가 전체 그룹과 얼마나 일치하는지를 사용자 쌍의 전열(permutation) 방식을 통해 정량화하는 파이썬 기반 소프트웨어이다. Linux 환경에서 실행 가능하며, 코드와 데이터는 Zenodo와 GitHub에 공개돼 재현성과 확장성을 제공한다. 시스템 리뷰, 의료 진단 알고리즘 검증, 교육 평가 등 다양한 분야에 적용할 수 있다.

상세 분석

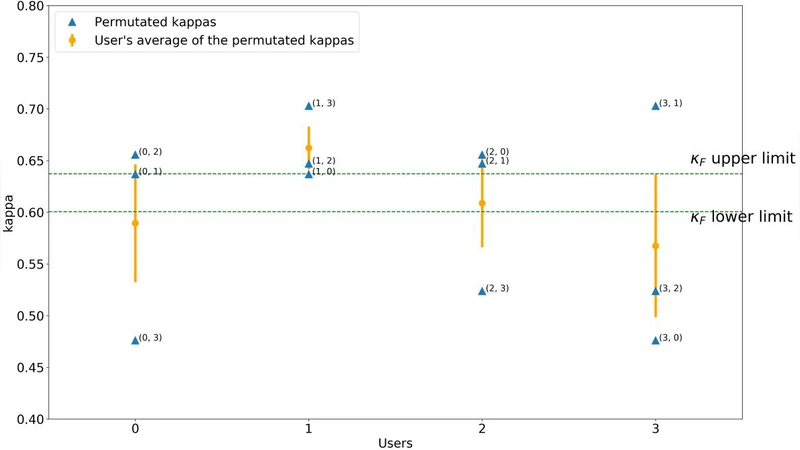

InterRater는 기존의 인터‑레이터 신뢰도 분석 도구가 갖는 몇 가지 한계를 보완한다. 첫째, 전통적인 Fleiss kappa 계산은 전체 평가자 집단에 대한 단일 지표만 제공한다는 점에서 개별 평가자의 기여도를 파악하기 어렵다. InterRater는 모든 가능한 평가자 쌍을 순열(permutation)하여 각 쌍에 대한 일치도를 별도로 계산하고, 이를 기반으로 “평가자‑별 평균 일치도”를 도출한다. 이 과정은 사용자 정의 가중치를 적용하거나, 특정 평가자를 제외한 서브그룹 분석을 수행할 때 유용하다.

둘째, 구현 언어를 파이썬으로 선택함으로써 데이터 전처리·시각화·통계 분석을 하나의 파이프라인에서 수행할 수 있다. pandas와 numpy를 이용한 대규모 데이터 프레임 처리, matplotlib·seaborn을 활용한 히트맵·산점도 시각화, 그리고 statsmodels를 통한 추가 통계 검증이 자연스럽게 연계된다. 또한, CLI(Command Line Interface)와 간단한 GUI를 제공해 비전문가도 손쉽게 실행할 수 있다.

셋째, 소프트웨어 배포와 지속 가능한 유지보수를 위해 코드를 Zenodo와 GitHub에 각각 DOI와 버전 관리 형태로 공개하였다. 이는 연구 재현성을 강화하고, 향후 기능 추가(예: Cohen’s kappa, Krippendorff’s alpha)나 다른 프로그래밍 언어와의 인터페이스 제공을 위한 포크(fork)와 풀 리퀘스트(pull request)를 장려한다.

네번째, Linux 전용 실행 파일을 제공함으로써 서버 기반 배치 처리와 클라우드 환경에서의 자동화 파이프라인 구축이 가능하다. Dockerfile이 포함되어 있어 컨테이너화된 배포도 손쉽게 수행할 수 있다. 다만, Windows 전용 GUI가 부재한 점은 일부 사용자에게 진입 장벽이 될 수 있다.

마지막으로, 적용 사례를 통해 InterRater의 실용성을 검증하였다. 시스템 리뷰에서 다섯 명의 전문가가 120개의 논문을 평가한 데이터를 이용해 Fleiss kappa와 개별 평가자 평균 일치도를 동시에 보고함으로써, 특정 평가자의 편향을 조기에 식별하고 전체 리뷰 품질을 향상시킬 수 있었다. 의료 진단 알고리즘 검증에서는 3명의 방사선과 의사가 200개의 영상에 대해 판독한 결과를 분석해, 알고리즘과 인간 평가자 간의 일치도를 정량화하는 데 활용되었다.

이와 같이 InterRater는 기존 통계 패키지에서 제공하지 못하는 세밀한 사용자‑별 신뢰도 정보를 제공하면서도, 오픈소스·플랫폼 독립적 특성으로 다양한 연구·실무 환경에 적용 가능하도록 설계되었다. 향후 다중 라벨(multi‑label) 평가, 연속형 점수에 대한 ICC( intraclass correlation coefficient) 지원 등 기능 확장이 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기