프레임 수준 화자 임베딩을 활용한 텍스트 독립 화자 인식 및 엔드투엔드 모델 분석

초록

본 논문은 1‑차원 CNN과 선형 활성화를 이용해 화자 임베딩을 추출하고, 이를 프레임 수준으로 분해해 음성의 음소·음성학적 클래스 정보를 어떻게 인코딩하는지 분석한다. VoxCeleb1으로 학습한 모델은 i‑vector와 동등하거나 약간 우수한 성능을 보이며, 고층에서는 개별 음소보다 넓은 음성학적 클래스 구분에 더 강한 특징을 학습한다는 점을 확인하였다.

상세 분석

이 연구는 기존의 x‑vector와 i‑vector 방식이 갖는 한계를 보완하고자, 1‑차원 컨볼루션(전체 주파수 축을 한 번에 처리)과 선형 활성화(비선형성을 최소화)로 구성된 엔드투엔드 스피커 인식 네트워크를 설계하였다. 네트워크는 4개의 1‑D CNN 레이어와 두 개의 완전 연결(FC) 레이어로 이루어지며, 통계 풀링(statistics pooling) 대신 평균 풀링을 적용해 프레임‑레벨 임베딩을 추출할 수 있게 구조를 변형하였다.

학습에는 VoxCeleb1 개발 셋(1,211명, 147,935 utterance)을 사용했으며, 데이터 증강(리버버레이션·노이즈)도 적용하였다. 실험 결과, FC2 레이어의 선형 출력(활성화 제거)에서 추출한 600‑차원 임베딩은 PLDA 백엔드와 결합했을 때 EER 5.3%를 기록, i‑vector(5.4%)와 거의 동등한 수준을 보였다. x‑vector는 동일 조건에서 6.0%~7.1% 수준으로 뒤처졌다.

프레임‑레벨 분석을 위해 모델 구조를 평균 풀링 레이어가 FC2 직전까지 위치하도록 수정하였다. 이렇게 하면 각 레이어의 출력이 시간 축에 따라 직접적인 프레임 임베딩이 되며, 이를 이용해 두 가지 프록시 태스크를 수행했다. 첫 번째는 TIMIT 데이터셋을 이용한 음소 인식이다. 각 레이어별 프레임 임베딩을 LSTM‑기반 세그멘탈 모델에 입력했을 때, 낮은 레이어일수록 음소 오류율(PER)이 낮고, 높은 레이어일수록 PER이 상승했다(예: 6번째 레이어에서 34% 수준). 이는 고층이 음소 구체적 정보를 점차 희석하고, 화자 구분에 더 유리한 추상적 특징을 학습한다는 것을 의미한다.

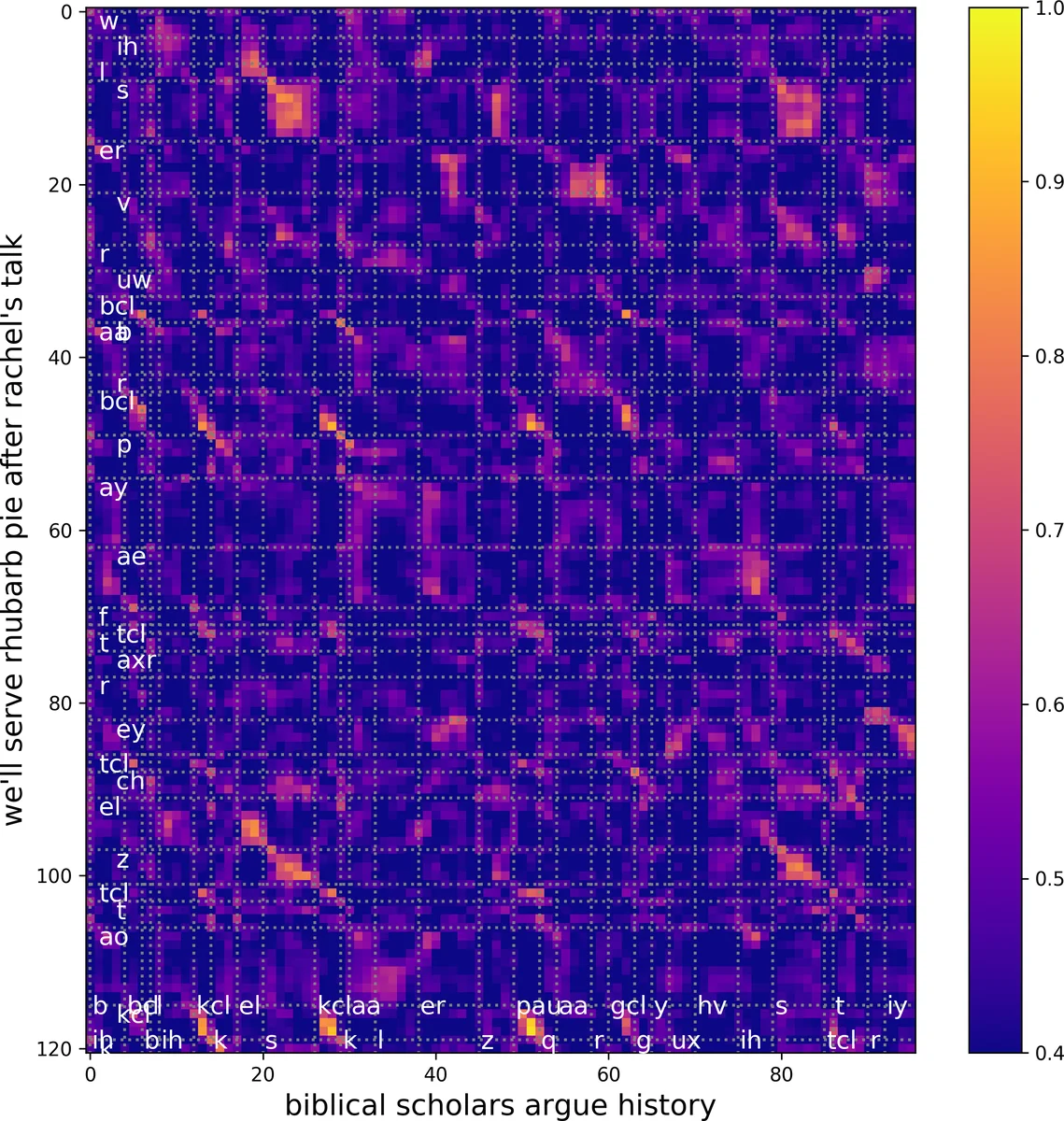

두 번째는 넓은 음성학적 클래스(예: 모음, 파열음, 마찰음 등) 구분이다. 각 음소 구간을 프레임 임베딩 평균으로 요약한 뒤, 클래스별 평균 벡터와 코사인 유사도로 분류했을 때, 학습 초기에는 구분력이 낮았지만 에폭이 진행될수록 특히 고층에서 정확도가 크게 향상되었다. 혼동 행렬을 살펴보면, 6번째 레이어에서는 대부분의 클래스가 정확히 구분되지만, 파열음과 마찰음, 비음과 반모음 등 일부는 여전히 혼동된다. 이는 네트워크가 ‘폐쇄음‑마찰음’ 혹은 ‘음성‑비음’ 같은 더 큰 그룹으로 음성을 추상화하고 있음을 시사한다.

또한, 동일 화자의 프레임 임베딩 간 코사인 유사도를 분석한 결과, 같은 음성학적 클래스에 속하는 프레임은 높은 유사도를 보였으며, 특히 /iy/, /ih/와 같은 고주파 모음이 화자 구분에 크게 기여한다는 점을 발견했다. 반대로 /w/와 같은 반모음은 유사도가 낮아 화자 식별에 덜 중요한 것으로 나타났다. 이러한 통계는 기존 연구에서 강조된 ‘모음·비음이 화자 구분에 유리하다’는 결론과 일치한다.

전체적으로 본 논문은 (1) 선형 활성화를 통한 임베딩 추출이 성능 저하 없이 구현 가능함을, (2) 프레임‑레벨 임베딩을 활용해 네트워크가 학습하는 음성학적 특성을 정량적으로 해석할 수 있음을, (3) 텍스트 독립 화자 인식에서 개별 음소보다는 넓은 음성학적 클래스가 핵심적인 구분 단위임을 입증하였다. 이러한 인사이트는 향후 데이터 증강, 손실 함수 설계, 혹은 멀티‑태스크 학습 등에 활용되어 보다 견고한 화자 인식 시스템을 구축하는 데 기여할 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기