XNORBIN 95테라연산초와트 하드웨어 가속기

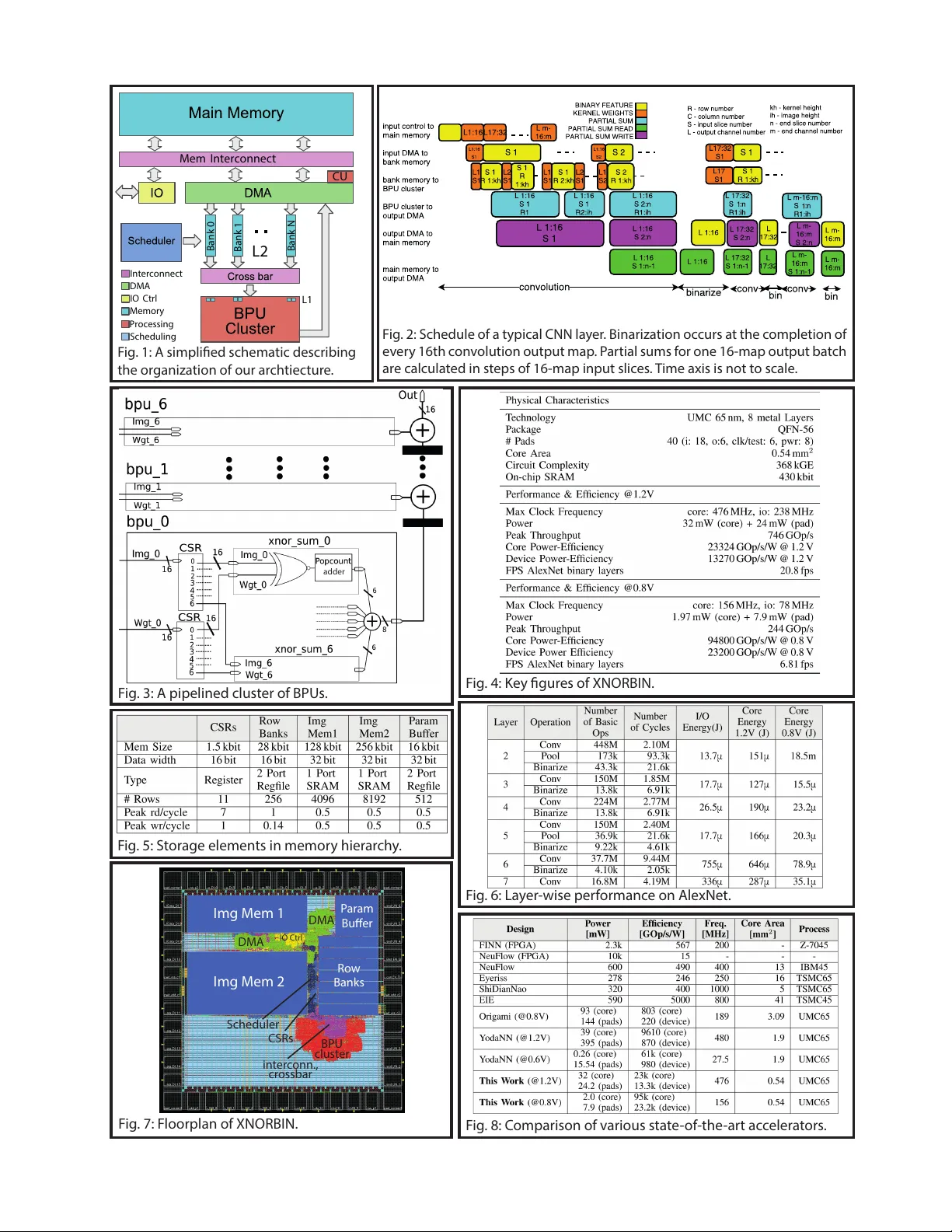

XNORBIN은 65 nm 공정으로 구현된 이진 CNN 전용 가속기로, 가중치와 특징맵을 1비트로 양자화해 메모리 요구량을 8‑32배 감소시키고 XNOR‑popcount 연산으로 곱셈‑덧셈을 대체한다. 0.8 V 동작 시 95 TOPS/W의 에너지 효율과 2.0 TOPS/MGE의 면적 효율을 달성하며, 전체 연산을 온칩 SRAM에 머물게 함으로써 오프칩 I/O 에너지를 최소화한다.

저자: Andrawes Al Bahou, Geethan Karunaratne, Renzo Andri

본 논문은 최신 컨볼루션 신경망(CNN)의 높은 연산량과 메모리 요구량이 저전력 임베디드 시스템에 적용되기 어려운 문제를 해결하고자, 이진 신경망(BNN)의 특성을 극대화한 ASIC 가속기 XNORBIN을 제안한다. BNN은 가중치와 중간 특징맵을 +1/‑1 이진값으로 표현함으로써 메모리 사용량을 8‑32배 감소시키고, 곱셈‑덧셈 연산을 XNOR 연산과 POPCOUNT 연산으로 대체한다. 이러한 변환은 연산 유닛을 크게 단순화하고, 비트 수준 연산만으로도 정확한 정수 결과를 얻을 수 있게 한다.

XNORBIN의 아키텍처는 크게 세 부분으로 구성된다. 첫 번째는 메인 SRAM(128 kbit 입력, 256 kbit 출력)으로, 가장 큰 레이어인 binary AlexNet까지 온칩에 저장할 수 있도록 설계되었다. 두 번째는 로우 뱅크(row banks)로, 입력 특징맵의 행을 버퍼링해 컨볼루션 윈도우 이동 시 SRAM 접근을 최소화한다. 세 번째는 BPU 클러스터로, 7개의 BPU가 각각 7개의 XNOR‑SUM 유닛을 포함한다. 각 XNOR‑SUM 유닛은 16비트 벡터(16개의 특징맵)를 동시에 XNOR 연산하고 POPCOUNT를 수행한다. BPU 내부의 CSR(Controlled Shift Register)은 입력 특징맵과 필터 비트를 병렬로 제공하며, 크로스바를 통해 BPU와 로우 뱅크를 연결한다.

연산 흐름은 다음과 같다. 컨볼루션 윈도우가 이미지 행을 따라 이동하면서 XNOR‑SUM 유닛이 1D 컨볼루션 결과를 매 사이클마다 산출한다. 7개의 BPU 결과는 2D 컨볼루션 값을 만들기 위해 합산된다. 이 정수 결과는 DMA 컨트롤러와 근접한 연산 유닛(CU)으로 전달되어 부분합을 read‑add‑write 방식으로 누적한다. 모든 부분합이 모이면 CU는 사전 계산된 임계값을 이용해 재이진화(활성화·배치 정규화) 작업을 수행하고, 최종 이진 결과를 16비트 워드로 패킹해 메모리에 저장한다.

XNORBIN은 7×7 이하 커널을 지원하도록 설계되었으며, 더 큰 커널은 여러 단계로 분할해 처리한다. 메인 메모리 용량(250 kbit)은 입력·출력 특징맵의 최대 크기를 제한하지만, 현재 구현된 파라미터 버퍼와 외부 플래시 메모리 인터페이스를 통해 네트워크 깊이에 제한을 두지 않는다.

실험 결과, 65 nm 공정에서 0.8 V 동작 시 XNORBIN은 746 GOp/s(1.2 V)와 244 GOp/s(0.8 V)의 처리량을 보이며, 에너지 효율은 23.3 TOPS/W(1.2 V)와 95 TOPS/W(0.8 V)를 달성한다. 전체 전력 소비는 1.8 mW이며, 메모리 접근이 전체 전력의 69 %를 차지한다. 이는 기존 이진 가중치 가속기인 YodaNN이 25배, FPGA 기반 FINN이 168배보다 훨씬 낮은 에너지당 연산량을 의미한다.

또한, 논문은 PyTorch 기반 훈련 모델을 XNORBIN 제어 스트림으로 자동 변환하는 툴 체인을 제공한다. 이를 통해 연구자와 엔지니어는 복잡한 하드웨어 설계 없이도 BNN을 손쉽게 XNORBIN에 매핑하고 실시간 추론을 수행할 수 있다.

결론적으로, XNORBIN은 온칩 메모리 중심 설계, 비트 연산 기반 계산, 다계층 데이터 재사용 구조를 결합해 mW 수준 전력 소모에서 실시간 이미지 분류를 가능하게 하는 최초의 ASIC 이진 CNN 가속기이다. 이는 저전력 임베디드 비전, 모바일 디바이스, 사물인터넷 등 전력 제한이 엄격한 응용 분야에 큰 영향을 미칠 것으로 기대된다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기