텍스트 독립 화자 검증을 위한 LSTM 기반 모델

본 논문은 MFCC 기반 음성 특징을 입력으로 사용하여, 두 층으로 구성된 LSTM 네트워크를 시암쌍(Siamese) 구조로 학습시킴으로써 텍스트 독립 화자 검증을 수행한다. 초기에는 Softmax 손실로 사전 학습을 진행하고, 이후 대조 손실(contrastive loss)로 미세조정하여 동일 화자와 비동일 화자 쌍의 거리 차이를 학습한다. 실험 결과 1초 길이의 짧은 발화에 대해 기존 GMM‑UBM, i‑vector, PLDA 기반 방법보다…

저자: Aryan Mobiny, Mohammad Najarian

본 논문은 텍스트 독립 화자 검증(text‑independent speaker verification) 문제에 대해, 전통적인 GMM‑UBM·i‑vector 등 통계 기반 방법과 달리 심층 순환 신경망인 LSTM(Long Short‑Term Memory)을 활용한 새로운 엔드‑투‑엔드 프레임워크를 제안한다. 연구 배경으로는 텍스트 독립 설정이 화자와 무관한 내용(발음, 억양, 배경 소음 등)까지 포함하므로 화자 고유의 음성 특성을 추출하기가 매우 어렵다는 점을 들었다. 기존 GMM‑UBM·i‑vector는 비지도 방식으로 학습되어 검증 프로토콜과 최적화 목표가 일치하지 않는다는 한계가 있었으며, 최근 딥러닝 기반 방법이 등장했지만 대부분 텍스트‑종속 혹은 짧은 발화에 국한된 경우가 많았다.

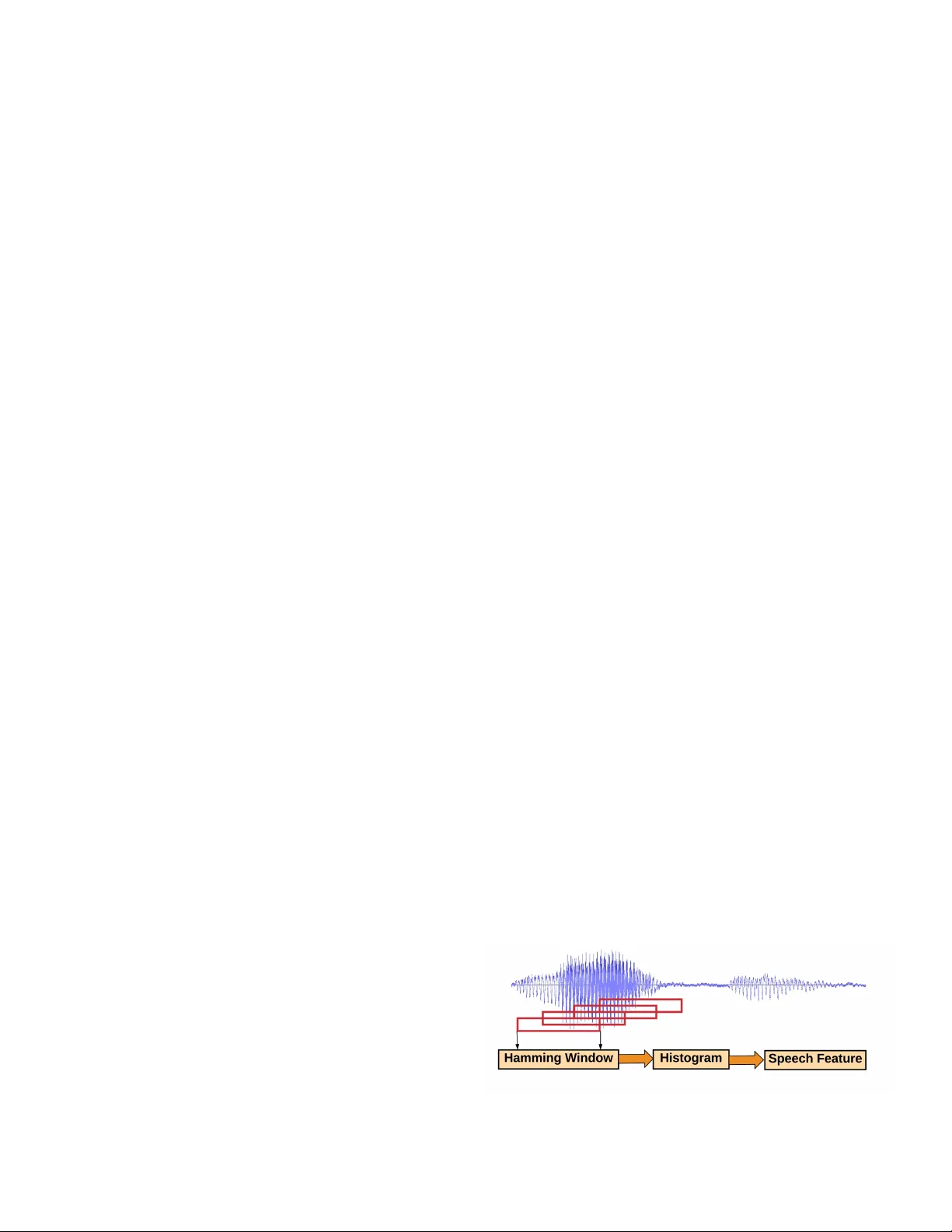

제안된 시스템은 크게 3단계로 구성된다. 첫 번째는 전처리 단계로, 원시 음성 신호에 대해 25 ms 윈도우와 60 % 오버랩을 적용해 40개의 로그 필터뱅크를 추출하고, 평균·분산 정규화를 수행한다. VAD를 통해 무음 구간을 제거하고, 1초 길이(100프레임) 구간을 고정 입력으로 만든다. 두 번째는 모델 학습 단계이다. 기본 LSTM 네트워크는 두 층으로 이루어져 각각 300개의 유닛을 갖으며, 시암쌍(Siamese) 구조로 두 개의 동일 네트워크가 가중치를 공유한다. 초기에는 Softmax 손실을 사용해 화자 식별 과제를 수행함으로써 파라미터를 사전 학습한다. 이후 동일·비동일 화자 쌍을 입력으로 받아 마지막 은닉 상태의 유클리드 거리를 계산하고, 대조 손실(contrastive loss)로 미세조정한다. 대조 손실은 동일 쌍에 대해 거리 제곱을 최소화하고, 비동일 쌍에 대해 마진 M보다 큰 거리를 유지하도록 설계되었다. 또한 L2 정규화와 효과적인 쌍 선택 알고리즘을 도입해 학습 효율과 일반화 성능을 높였다. 세 번째는 평가 단계로, 테스트 발화를 동일한 전처리 과정을 거쳐 LSTM에 입력하고, 얻어진 임베딩 벡터와 각 화자 모델(등록 단계에서 평균된 d‑vector) 간 거리를 비교한다. 성능 평가는 Equal Error Rate(EER) 기준으로 수행한다.

실험은 TensorFlow 기반으로 구현했으며, 데이터 증강으로 매 배치마다 무작위 1초 구간을 추출했다. 배치 정규화와 그래디언트 클리핑을 적용해 학습 안정성을 확보하였다. 평가 프로토콜은 기존 연구

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기