시간 도메인 딥 레지듀얼 네트워크 기반 음원 위치 추정

초록

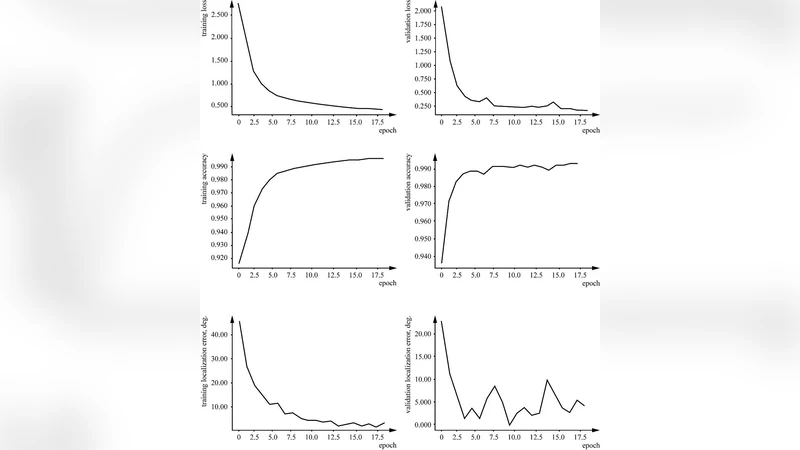

본 논문은 8채널 선형 마이크 배열에서 30 ms 길이의 원시 파형을 입력으로 받아, 10° 간격으로 구분된 방위각 클래스를 분류하는 딥 레지듀얼 신경망을 설계·학습하였다. 99.2%의 프레임 분류 정확도와 평균 4°의 표준편차를 달성했으며, 실시간 구현과 음성 인식 파이프라인에 적용했을 때 기존 GCC‑PHAT 기반 시스템 대비 단어 오류율을 1.14% 감소시켰다.

상세 분석

이 연구는 기존 음원 위치 추정 방법이 주로 주파수 도메인에서 상관관계나 위상 정보를 이용해 복잡한 탐색 과정을 수행하는 데 비해, 시간 도메인 원시 신호를 그대로 활용하는 새로운 접근을 제시한다. 8채널 마이크 배열(채널 간 3 cm 간격)에서 16 kHz, 30 ms(480 샘플) 길이의 프레임을 입력으로 하는 1‑D 컨볼루션 기반 레지듀얼 블록을 두 개 포함한 네트워크 구조는 파라미터 효율성을 높이며, 배치 정규화와 드롭아웃을 통해 과적합을 효과적으로 억제한다.

네트워크는 첫 번째 1‑D 컨볼루션 레이어에서 기본적인 시간‑주파수 특징을 추출하고, 이어지는 레지듀얼 레이어가 깊은 표현을 학습한다. 마지막 전결합 레이어와 소프트맥스는 0°~180°를 10° 간격으로 나눈 19개의 방위각 클래스와 ‘음원 없음’ 클래스를 동시에 예측한다. 학습은 Adam 옵티마이저와 크로스 엔트로피 손실을 사용했으며, 20 epoch 중 18 epoch에서 과적합이 시작되는 것을 확인했다.

데이터셋은 GTZAN 음악 파일을 무작위 재생하면서 0°~180°까지 10° 간격으로 1시간 분량을 수집하고, 1시간의 정적(무음) 데이터를 포함한다. 실험실 환경(2 × 3 m)과 다른 방(다른 반향 특성)에서 테스트했을 때 평균 절대 방위각 오차가 12° 이하로 유지되어, 학습된 모델이 방향 간격보다 더 정밀하게 일반화됨을 보여준다.

음성 인식 파이프라인에 적용한 결과, 기존 GCC‑PHAT 기반 로컬라이제이션과 MVDR 빔포밍을 사용한 경우 WER 2.99%였던 반면, 제안된 레지듀얼 네트워크 기반 로컬라이제이션을 사용하면 WER 1.85%로 크게 개선되었다. 이는 레지듀얼 네트워크가 제공하는 방위각 추정 정확도가 빔포밍의 지향성을 보다 정확히 맞추어 잡음 억제와 신호 강화에 기여했기 때문이다.

또한, 이 방법은 Fourier 변환을 생략함으로써 연산량을 크게 감소시키며, 1‑D 컨볼루션만으로도 주파수‑시간 정보를 자동으로 학습한다는 점에서 실시간 처리에 유리하다. 향후 다중 음원 추정, LSTM·GRU와 같은 순환 레이어 도입을 통해 동적 상황에서도 지속적인 추적이 가능하도록 확장할 여지가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기