링크 장애가 데이터센터 네트워크에서 MapReduce 성능에 미치는 영향

초록

본 논문은 혼합정수선형계획(MILP) 모델을 활용해 다양한 데이터센터 네트워크(DCN) 토폴로지에서 발생하는 단일·다중 링크 장애가 MapReduce의 셔플 단계 완료 시간에 미치는 영향을 정량적으로 평가한다. 실험 결과, 토폴로지별로 5 %에서 40 %까지 지연이 발생했으며, 서버‑중심 PON 기반 DCN이 가장 높은 복원력을 보였다.

상세 분석

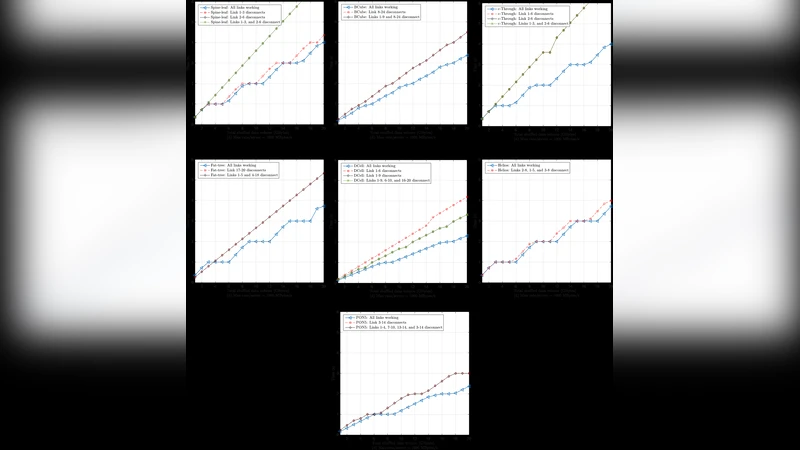

본 연구는 데이터센터 내부의 네트워크 장애가 빅데이터 프레임워크인 MapReduce의 핵심 단계인 셔플 작업에 미치는 영향을 체계적으로 분석하였다. 먼저, 저자들은 7가지 대표적인 DCN 토폴로지(Spine‑and‑Leaf, Fat‑Tree, BCube, DCell, c‑Through, Helios, 그리고 서버‑중심 PON) 각각에 대해 10개의 맵 워커와 6개의 리듀스 워커를 배치하고, Indy GraySort 벤치마크를 이용해 1 GB~20 GB 규모의 입력 데이터를 전송하도록 설정하였다. MILP 모델은 각 토폴로지에서 링크 장애 발생 시 최적 라우팅 경로와 서버 전송률을 동시에 고려해 전체 셔플 완료 시간을 최소화하도록 설계되었으며, 에너지 효율성도 함께 최적화 목표에 포함하였다.

실험에서는 비치명적(single‑point) 링크 장애와 다중 링크 장애 두 시나리오를 적용했으며, 특히 가장 많이 사용되는 링크(예: Fat‑Tree의 17‑20번 링크, BCube의 핵심 링크)와 ToR‑서버 간 연결을 고의적으로 차단하였다. 결과는 토폴로지마다 크게 차이나는데, Spine‑and‑Leaf 구조는 일부 링크(1‑3번) 차단 시 2 %~6 % 정도의 지연만 발생했으며, 이는 대체 경로가 충분히 확보돼 있기 때문이다. 반면 Fat‑Tree는 ToR‑서버 연결이 단일 장애점(single point of failure)으로 작용해 복제 메커니즘이 없을 경우 재계산 비용이 크게 증가한다.

BCube와 DCell은 서버당 두 개의 물리적 링크를 보유해 다중 경로를 제공하지만, DCell은 워크로드 배치에 민감해 가장 많이 사용되는 1‑6번 링크가 차단될 경우 최대 40 %의 지연이 발생한다. 이는 DCell의 계층적 연결 구조가 특정 리듀스 워커에 과도한 트래픽을 집중시키는 경향이 있기 때문이다. c‑Through와 Helios는 광학 스위치를 활용해 ToR 스위치 수 대비 높은 포트 집적도를 제공하지만, 여전히 핵심 스위치에 대한 의존도가 높아 다중 링크 장애 시 각각 평균 37 %와 5 %의 지연이 관찰되었다.

가장 눈에 띄는 결과는 서버‑중심 PON 기반 DCN이다. 이 구조는 각 서버가 직접 광학 AWGR을 통해 다른 서버와 연결되며, 링크 장애가 발생해도 대체 경로가 풍부하게 존재한다. 실험에서는 단일 링크 장애 시 평균 22 %의 지연이었고, 최대 4개의 링크가 동시에 차단될 때도 전체 지연이 22 % 수준에 머물렀다. 이는 PON의 패시브 특성과 서버‑중심 라우팅이 결합돼 장애 복원력이 크게 향상된 결과로 해석된다.

또한, 논문은 에너지 효율성 측면에서도 각 토폴로지의 전력 소비 모델을 적용했으며, PON 기반 설계가 전력 소모 측면에서도 경쟁력을 유지한다는 점을 강조한다. 향후 연구 과제로는 스위치 전환 지연, 스위치 자체 장애, 그리고 MapReduce의 복제 팩터를 고려한 보다 정교한 모델링이 제시되었다. 전체적으로 본 연구는 데이터센터 설계 시 네트워크 토폴로지 선택이 애플리케이션 수준의 성능과 복원력에 미치는 영향을 정량적으로 보여주며, 특히 서버‑중심 PON이 차세대 고신뢰성 데이터센터 아키텍처로서 유망함을 입증한다.

댓글 및 학술 토론

Loading comments...

의견 남기기