음성 비서용 장치 지시 발화 탐지

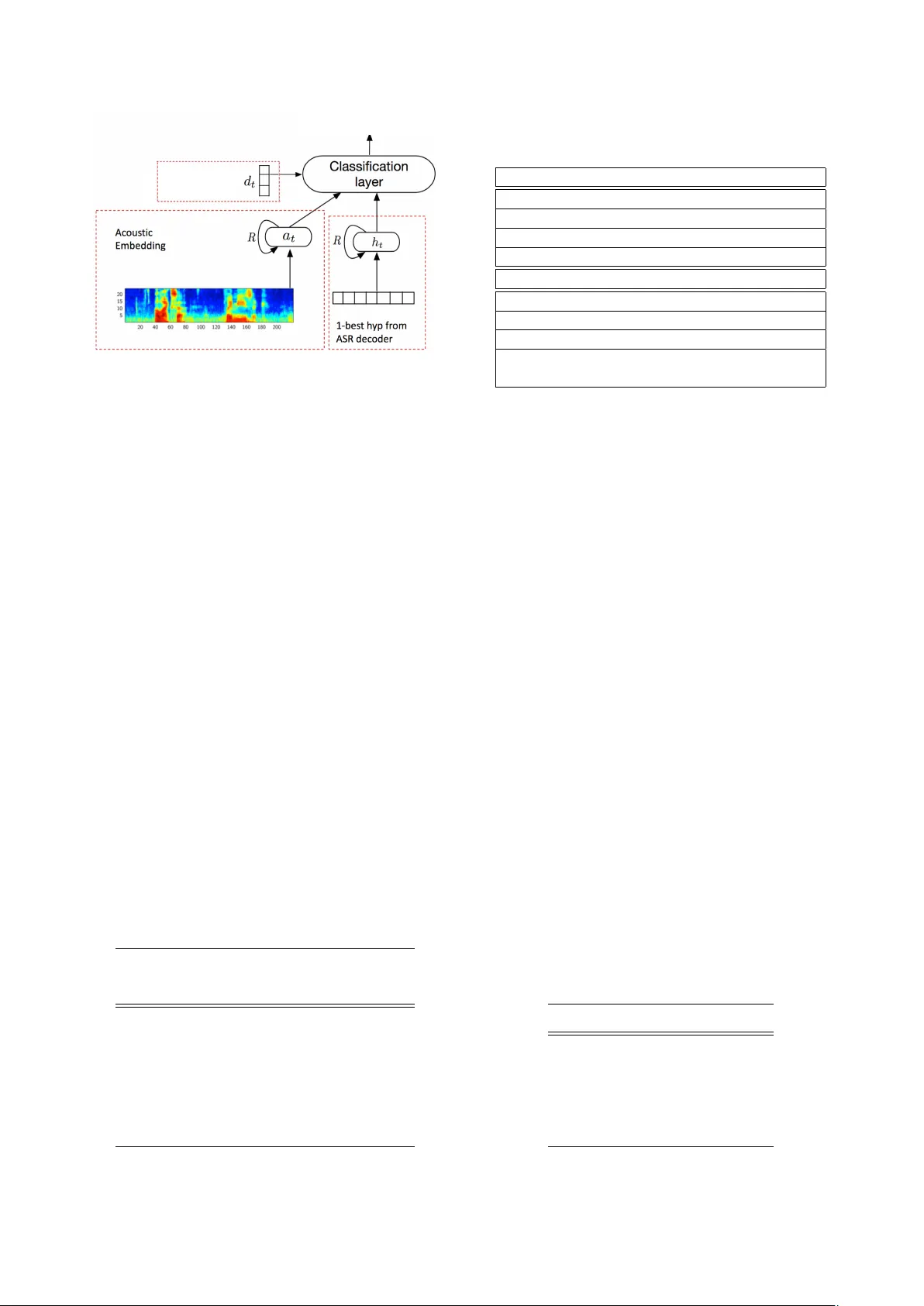

본 논문은 음성 비서와의 대화에서 사용자가 의도한 장치 지시 발화와 배경 잡음(비지시 발화)을 구분하는 분류기를 제안한다. 두 개의 LSTM 네트워크를 각각 음향 특징과 ASR 1‑best 문자 시퀀스에 학습시켜 고정 길이 임베딩을 얻고, 이를 ASR 디코더에서 추출한 18개의 메타 특징과 결합한 뒤 전결합 DNN으로 최종 판단한다. 실험 결과, 개별 특징만 사용할 때는 EER이 9.3%~20.1%였으나, 세 가지를 통합했을 때 5.2%까지 낮…

저자: Sri Harish Mallidi, Rol, Maas

본 논문은 스마트 스피커와 같은 원거리 음성 비서 장치가 사용자의 의도된 명령을 정확히 인식하고, 배경 잡음이나 타인의 대화를 무시하도록 돕는 “장치‑지시 발화(Device‑directed Utterance) 탐지” 모델을 제안한다. 기존 연구는 주로 음향 기반의 prosody 특징(에너지, 피치, 발화 속도 등)이나 ASR 디코더에서 추출한 confidence 점수, N‑gram 등 단일 정보원에 의존해 왔으며, 이러한 접근법은 복합적인 실제 환경에서 한계가 있었다. 저자들은 세 가지 상이한 정보원을 동시에 활용함으로써 이러한 한계를 극복하고자 한다.

시스템 구조는 크게 네 부분으로 나뉜다. 첫 번째는 음향 임베딩을 생성하는 LSTM이다. 입력은 25 ms 윈도우와 10 ms 스트라이드로 추출한 64 차원 log‑filter‑bank 에너지(LFBE)이며, 프레임‑레벨 장치‑지시 라벨을 반복해 학습한다. 마지막 프레임의 pre‑softmax 출력을 2 차원 벡터로 사용해 “음향 임베딩(a)”을 만든다. 두 번째는 ASR 디코더에서 추출한 18개의 메타 특징이다. 여기에는 트렐리스 엔트로피(불확실성 지표), Viterbi 비용(음향·언어 모델 적합도), 혼동 네트워크의 arc 수, 1‑best 가설의 confidence(단어 posterior 곱) 등이 포함된다. 세 번째는 ASR 1‑best 가설의 문자 시퀀스를 GloVe 기반 임베딩(문자 수준)으로 변환한 뒤, 동일한 구조의 LSTM에 입력해 마지막 문자 출력으로 200 차원 “문자 임베딩(c)”을 얻는다. 네 번째는 앞서 얻은 a, c, d(디코더 특징)를 연결한 22 차원 벡터를 전결합 신경망(fully‑connected DNN)에 넣어 최종 장치‑지시 여부를 판단한다.

데이터는 Amazon 내부에서 수집한 실제 사용자 대화로 구성되었다. 훈련 세트는 250 시간(350 k 발화)이며, 장치‑지시 발화가 200 k, 비지시 발화가 150 k이다. 테스트 세트는 30 시간(50 k 발화)으로, 장치‑지시가 38 k, 비지시가 12 k이다. 성능 평가는 Equal Error Rate(EER)와 DET(Detection‑Error‑Tradeoff) 곡선으로 수행하였다.

실험 결과, 개별 특징만 사용할 경우 디코더 특징이 가장 우수해 9.3 % EER, 음향 임베딩은 10.9 % EER, 문자 임베딩은 20.1 % EER를 기록했다. 두 개를 조합했을 때는 a+d가 6.5 % EER, c+d가 6.9 % EER, a+c가 8.6 % EER로 각각 개선되었다. 세 가지를 모두 결합한 최종 모델은 5.2 % EER를 달성했으며, 이는 가장 좋은 단일 특징 대비 44 % 상대적인 개선에 해당한다. DET 곡선에서도 결합 모델이 모든 운영점에서 개별 모델을 앞섰다.

시스템 설계상의 주요 인사이트는 다음과 같다. 첫째, 음향 임베딩은 원시 신호의 시간‑주파수 패턴을 포착해, 특히 배경 잡음이 심한 환경에서 강인한 특징을 제공한다. 둘째, 문자 임베딩은 사용자가 실제로 말한 텍스트의 구조적 특성을 반영한다. 장치‑지시 발화는 짧고 명령형 문장이 많아 일관된 어휘와 구문을 보이는 반면, 비지시 발화는 자유로운 대화 형태로 다양성이 크다. 셋째, 디코더 메타 특징은 ASR 엔진이 입력을 얼마나 확신하는지를 정량화한다. 트렐리스 엔트로피가 높고 Viterbi 비용이 큰 경우는 일반적으로 비지시 발화와 연관된다. 이러한 세 가지 정보를 결합함으로써 서로 보완적인 정보를 제공하고, 단일 특징만으로는 구분하기 어려운 경계 상황에서도 높은 정확도를 유지한다.

한계점으로는 문자 임베딩 학습에 사용된 프레임 수가 음향 LSTM에 비해 현저히 적어(8 M vs 91 M) 성능 차이가 발생한다는 점이다. 데이터 양을 늘리거나 더 깊은 모델(예: Transformer‑ 기반 문자 인코더)을 적용하면 개선 가능성이 있다. 또한 디코더 특징은 특정 ASR 엔진에 종속적이므로, 다른 엔진이나 언어에 적용하려면 재학습 및 특징 재설계가 필요하다.

향후 연구 방향은 (1) 스피커 식별, 마이크 배열 방향성 등 추가적인 멀티‑모달 정보를 통합해 더욱 견고한 모델을 구축, (2) 실시간 서비스에 적합하도록 모델 경량화 및 온‑디바이스 추론 최적화, (3) 다국어·다방언 환경에서의 일반화 성능 검증, (4) 사용자 프라이버시를 보호하면서도 효과적인 학습을 위한 연합 학습(federated learning) 기법 도입 등을 제시한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기