멀티스피커 TTS를 위한 Wasserstein GAN 기반 WaveNet 음성합성 모델링

본 논문은 멀티스피커 텍스트‑투‑스피치 시스템에서 WaveNet 보코더와 결합된 음향 모델을 학습하기 위해 조건부 GAN 및 Wasserstein GAN‑GP를 도입한다. 기존 MSE 기반 학습의 과도한 평활화와 보코더 입력의 불일치를 완화하기 위해, 생성기 손실에 평균 제곱오차(MSE), 적대적 손실(ADV), 그리고 사전 학습된 WaveNet의 이산 혼합 로지스틱(DML) 손실을 가중합한다. 실험 결과, WGAN‑GP와 DML 손실을 함께 …

저자: Yi Zhao, Shinji Takaki, Hieu-Thi Luong

본 논문은 최신 신경 보코더인 WaveNet을 활용한 멀티스피커 텍스트‑투‑스피치(TTS) 시스템에서, 음향 모델의 학습 방법이 최종 합성 음성의 품질에 미치는 영향을 집중적으로 분석한다. 기존의 음향 모델은 주로 최소 평균 제곱오차(MSE) 기준으로 학습되었으며, 이로 인해 예측된 mel‑spectrogram이 과도하게 평활화되는 문제가 있었다. 평활화된 스펙트로그램은 WaveNet 보코더에 입력될 때 고주파 디테일이 손실되고, 결과적으로 “buzziness”와 같은 인공음이 발생한다. 특히 멀티스피커 상황에서는 화자마다 데이터 양이 제한적이기 때문에, 이러한 문제는 더욱 두드러진다.

이를 해결하기 위해 저자는 두 가지 주요 아이디어를 제안한다. 첫 번째는 조건부 생성적 적대 신경망(GAN)과 그 변형인 Wasserstein GAN with Gradient Penalty(WGAN‑GP)를 음향 모델 학습에 도입하는 것이다. GAN 구조에서는 생성기(G)와 판별기(D)가 경쟁적으로 학습하면서, 생성기가 실제와 구분하기 어려운 mel‑spectrogram을 생성하도록 유도한다. WGAN‑GP는 기존 GAN이 겪는 학습 불안정성(모드 붕괴, 그래디언트 소실 등)을 완화하고, Lipschitz 연속성을 보장하기 위해 판별기의 입력에 대한 그래디언트 패널티를 추가한다.

두 번째 아이디어는 사전 학습된 WaveNet 보코더가 제공하는 이산 혼합 로지스틱(DML) 손실을 음향 모델의 손실 함수에 포함시키는 것이다. WaveNet은 샘플링 단계에서 각 타임스텝을 이산 혼합 로지스틱 분포로 모델링하고, 이 분포와 실제 파형 사이의 로그우도 손실을 계산한다. 이 DML 손실을 역전파하면, 음향 모델은 단순히 스펙트로그램 도메인에서의 차이만 최소화하는 것이 아니라, 최종 파형 재생 단계에서 발생하는 왜곡까지 직접 최소화하게 된다. 따라서 음향 모델과 보코더가 사실상 공동 최적화되는 효과를 얻는다.

구현 세부 사항으로는, 음향 모델의 기본 구조로 SRU(Simple Recurrent Unit)를 채택하였다. SRU는 LSTM 대비 연산량이 적고, 게이트 연산이 간소화되어 병렬화가 용이해 대규모 멀티스피커 데이터셋을 빠르게 학습할 수 있다. 생성기와 판별기 모두 화자 코드를 입력에 결합함으로써, 다중 화자 상황에서도 화자 특성을 유지하도록 설계되었다. 구체적으로, 생성기는 언어학적 특징과 화자 코드를 받아 mel‑spectrogram을 출력하고, 판별기는 실제 mel‑spectrogram과 생성된 mel‑spectrogram을 구분하며 동일한 화자 코드를 조건으로 사용한다.

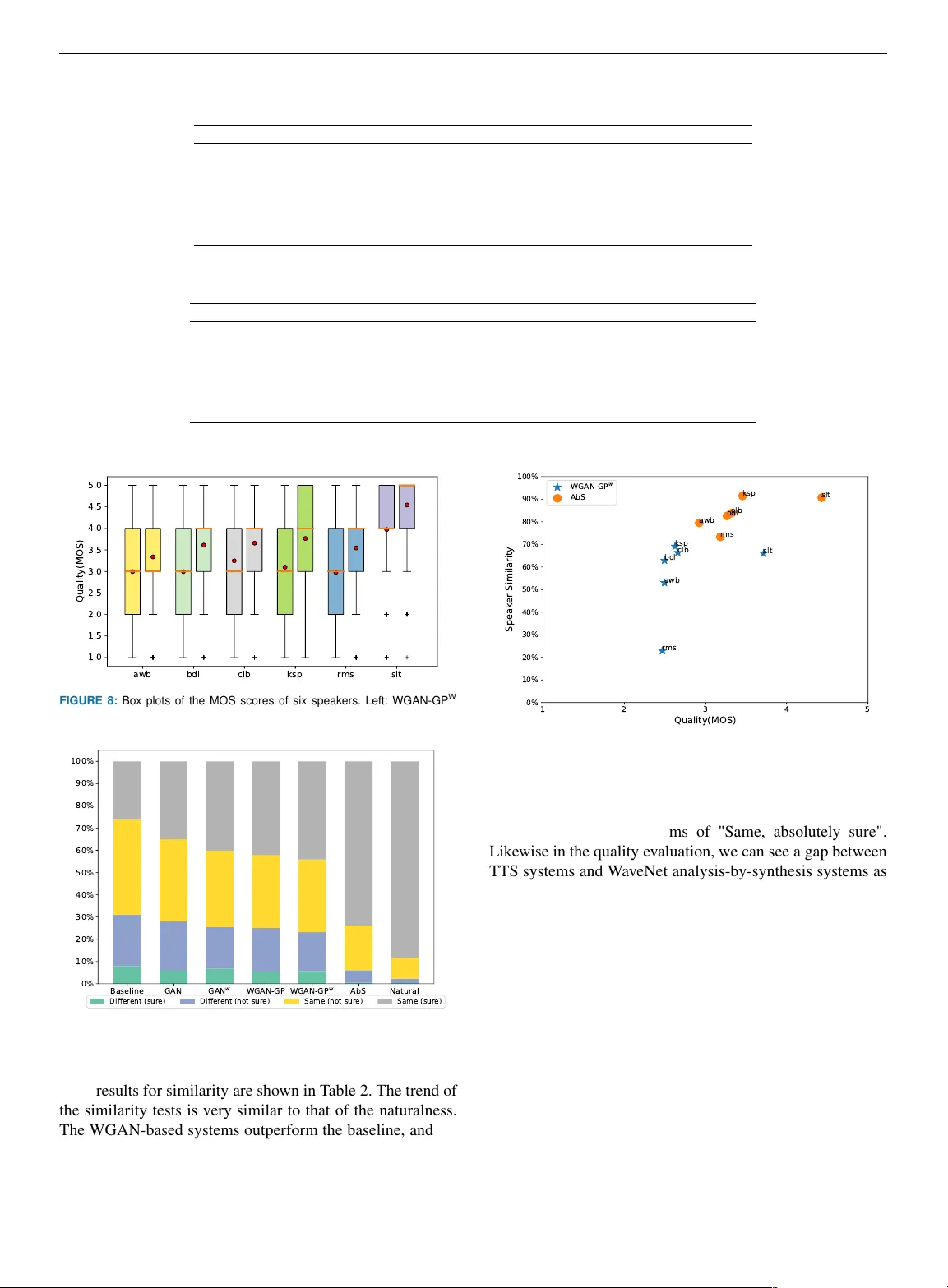

실험은 일본어 및 영어 다중 화자 데이터셋을 사용해 수행되었다. 비교 대상은 다음과 같다: (1) 전통적인 MSE‑only 모델, (2) GAN‑MSE, (3) WGAN‑GP‑MSE, (4) 각각에 DML 손실을 추가한 변형(총 6가지). 평가 항목은 주관적 청취 테스트(MOS)와 화자 유사도 ABX 테스트, 그리고 객관적인 스펙트로그램 차이(L2)와 파형 기반 PESQ 점수이다. 결과는 다음과 같다. WGAN‑GP + DML 조합이 MOS 점수에서 4.3 점(5점 만점)으로 가장 높았으며, 화자 유사도에서도 92 % 이상의 정답률을 기록했다. GAN‑MSE와 WGAN‑GP‑MSE도 MSE‑only 대비 각각 0.3~0.5 점 향상을 보였지만, DML 손실을 포함하지 않은 경우 파형 품질에서 여전히 한계가 있었다. 객관적 지표에서도 DML을 포함한 모델이 파형 재생 시 왜곡을 크게 감소시켰음이 확인되었다.

논문은 또한 학습 안정성 측면에서 WGAN‑GP가 기존 GAN보다 빠른 수렴과 낮은 변동성을 보였으며, DML 손실이 추가되더라도 그래디언트 흐름에 큰 영향을 주지 않아 학습 효율을 유지함을 보고한다. 마지막으로, 제안된 프레임워크는 화자 코드와 함께 새로운 화자에 대한 적은 양의 데이터만으로도 빠른 적응이 가능함을 실험적으로 검증하였다.

결론적으로, 본 연구는 멀티스피커 TTS 시스템에서 음향 모델과 WaveNet 보코더를 효과적으로 연결하는 새로운 학습 전략을 제시한다. 조건부 WGAN‑GP와 파형 기반 DML 손실의 결합은 과도한 평활화를 방지하고, 파형 수준에서의 정밀도를 향상시켜 최종 합성 음성의 자연스러움과 화자 일관성을 크게 개선한다. 향후 연구에서는 더 많은 화자와 언어에 대한 확장, 그리고 실시간 합성을 위한 경량화 모델 적용이 기대된다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기