하이퍼넷을 이용한 이미지 공간 변환 학습 및 보정 기술

초록

본 논문은 변환 파라미터를 입력받아 네트워크 가중치를 동적으로 생성하는 고차원 신경망 구조인 “HyperNet”을 제안한다. 회전 및 아핀 변환 두 가지 기본 공간 변환을 학습·일반화하고, 회전 보정 실험을 통해 입력 이미지의 원래(정규) 형태를 복원하는 능력을 입증한다. 기존 자동인코더(AE)와 비교했을 때 변환 일반화와 외삽 성능이 우수함을 보인다.

상세 분석

HyperNet의 핵심 아이디어는 전통적인 피드포워드 네트워크를 “핵심 모델”로 두고, 변환 파라미터 φ (예: 회전 각도, 아핀 행렬 요소)를 별도의 “고차원 모듈”(컨트롤 뉴런)에게 입력시켜 핵심 모델의 가중치 θ 를 동적으로 생성하도록 설계하는 것이다. 수학적으로는 θ(φ)=h_ω(φ) 라는 함수 h 를 학습함으로써, 변환 파라미터마다 다른 가중치를 갖는 네트워크를 구현한다. 이 구조는 커링(curry) 개념을 차용해 f(x, φ)≈g_θ(x) 를 θ = h_ω(φ) 로 대체함으로써, 변환에 대한 일반화 능력을 크게 향상시킨다.

논문은 두 가지 실험을 통해 HyperNet의 효용을 검증한다. 첫 번째는 회전 일반화 실험으로, 0~360° 전 범위의 연속적인 각도와 45° 간격의 이산 각도 학습을 비교한다. 단순 HyperNet(한 층)과 깊은 HyperNet(컨볼루션 + 전결합 층) 모두 훈련에 사용되지 않은 각도와 심지어 훈련에 전혀 포함되지 않은 숫자(예: 4, 9) 및 문자에 대해 회전된 이미지를 정확히 복원한다. 특히 깊은 HyperNet은 연속적인 각도에 대한 외삽 성능이 뛰어나, 4°·9°와 같은 미세 각도에서도 눈에 띄는 품질을 유지한다.

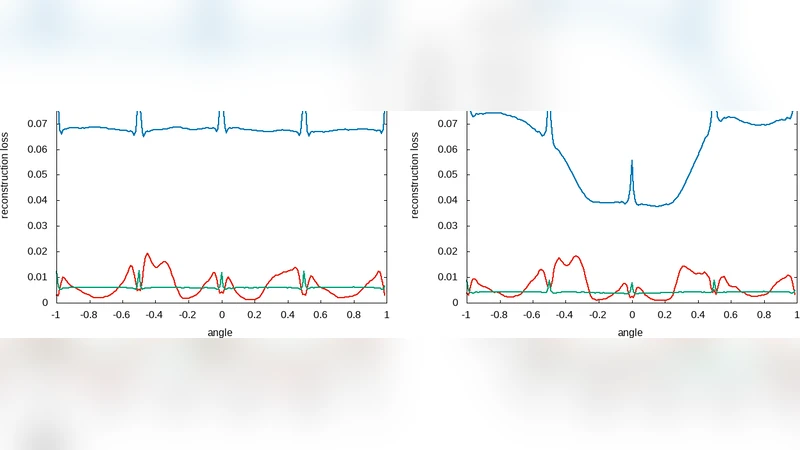

두 번째 실험은 아핀 변환 일반화이다. 6개의 아핀 파라미터(스케일, 전단, 이동 등)를 고차원 입력으로 사용하고, 원본(정규) 이미지를 핵심 모델에 입력한다. 결과는 훈련에 보지 못한 아핀 조합과 새로운 숫자에 대해서도 변환을 정확히 복원했으며, 기존 자동인코더(AE)와 비교했을 때 재구성 손실(Loss)이 0.0138(깊은 HyperNet) 대비 0.0606(AE)으로 크게 낮았다.

마지막으로 회전 보정 실험에서는 회전된 이미지를 그대로 입력으로 사용하고, 고차원 모듈이 회전 각을 추정하도록 설계하였다. 이때도 깊은 HyperNet은 180° 회전으로 6↔9가 뒤바뀐 경우를 포함해, 회전된 이미지를 정규 형태로 복원하는 데 성공했다. 일부 아티팩트가 존재하지만 전반적인 이미지 품질은 양호했다.

전체적으로 HyperNet은 변환 파라미터를 직접 학습하는 것이 아니라 파라미터‑조건부 가중치 생성이라는 메타‑학습 방식을 채택함으로써, 변환 불변성(invariance)과 변환 일반화(generalization) 문제를 효과적으로 해결한다. 또한 기존 ST‑Layer가 요구하는 미분 가능한 샘플링 커널이나 사전 정의된 변환 집합에 비해 더 유연한 구조를 제공한다. 다만 현재 구현은 비교적 단순한 컨볼루션·전결합 구조에 머물러 있어, 대규모 이미지·비전 작업에 적용하려면 메모리·연산 효율성 개선이 필요하다.

댓글 및 학술 토론

Loading comments...

의견 남기기