정체성 파라미터화가 딥러닝에 미치는 영향

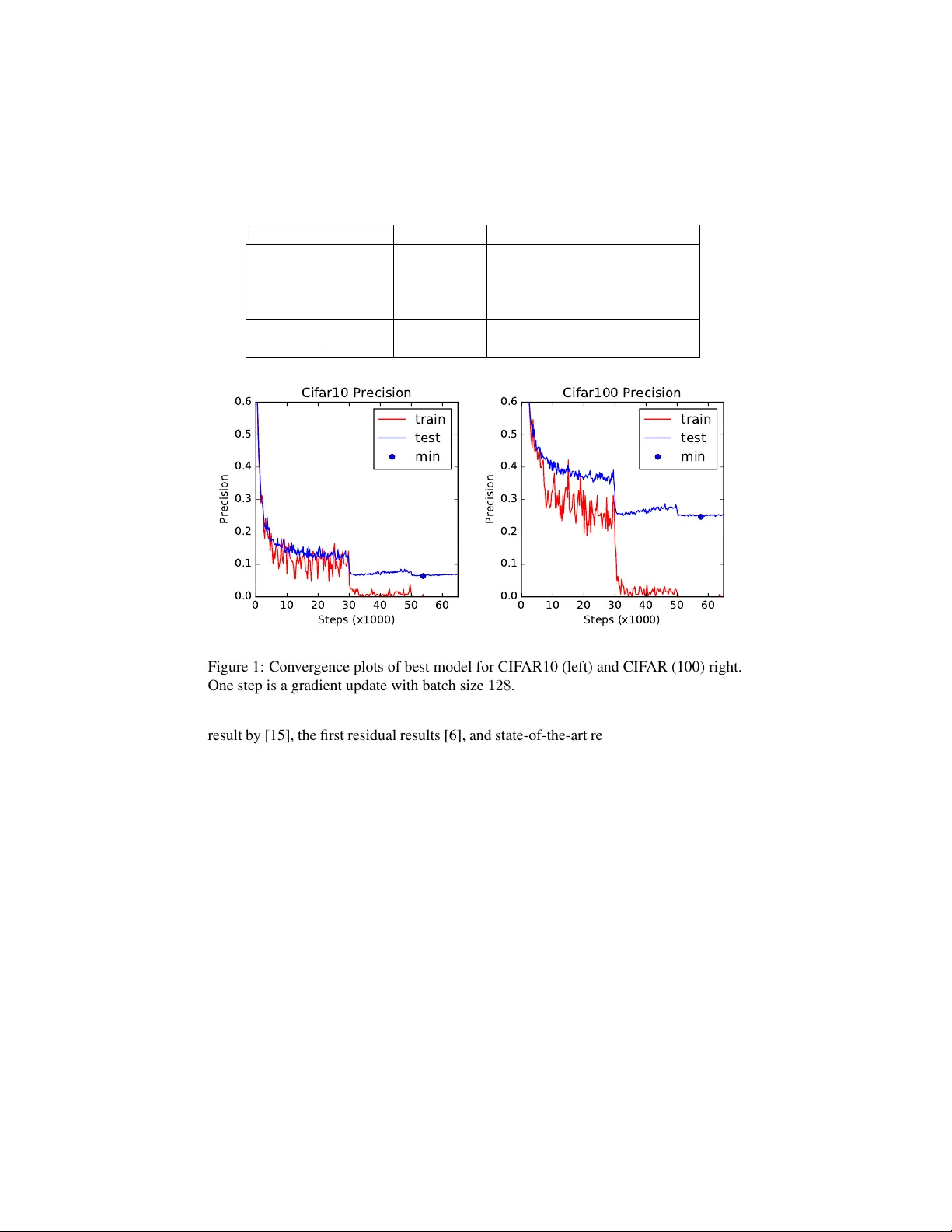

본 논문은 신경망 각 층이 항등 변환을 쉽게 구현하도록 설계하는 “정체성 파라미터화” 원리를 이론적으로 정립하고, 선형 잔차 네트워크의 최적화 지형이 스파리어스 로컬 옵티마를 전혀 갖지 않음을 증명한다. 또한 ReLU 잔차 네트워크가 파라미터 수가 샘플 수보다 충분히 클 때 모든 샘플에 대해 완전한 표현력을 가짐을 보이며, 이를 바탕으로 배치 정규화·드롭아웃·맥스 풀링 없이도 CIFAR‑10/100 및 ImageNet에서 기존 최첨단 전통 합성…

저자: Moritz Hardt, Tengyu Ma

본 논문은 딥러닝 모델 설계에서 “정체성 파라미터화(identity parameterization)”라는 원칙이 왜 중요한지를 이론적·실험적으로 탐구한다. 정체성 파라미터화란 각 층이 x ↦ x + h(x) 형태로 구현되어, 가중치가 0일 때 항등 변환을 바로 수행하도록 재파라미터화하는 것을 의미한다. 이는 배치 정규화와 같은 기법이 도입되기 전부터 잔차 네트워크(ResNet)의 성공 배경이 되었으며, 본 연구는 이를 두 가지 핵심 질문으로 구체화한다. 첫째, 선형 잔차 네트워크가 최적화 관점에서 어떤 지형을 가지는가? 둘째, 비선형 ReLU 잔차 네트워크가 충분한 파라미터를 가질 때 샘플 집합을 완전히 표현할 수 있는가?

**1. 선형 잔차 네트워크의 최적화 지형**

선형 모델을 y = R x + ξ (ξ는 가우시안 노이즈) 형태의 회귀 문제로 설정하고, 잔차 형태 \hat y = (I + A_ℓ)…(I + A_1) x 로 파라미터화한다. 목적함수는 평균 제곱오차 f(A) = E

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기