GPU 기반 섹턴 회피 차원 축소 알고리즘

본 논문은 데이터 집합의 모든 섹턴(점 쌍 차이 벡터)을 이용해 차원을 축소하는 새로운 알고리즘인 Secant‑Avoidance Projection(SAP)을 제안한다. 섹턴을 정규화한 뒤 최소 투영 길이를 최대화하도록 반복적으로 투영 행렬을 업데이트한다. 섹턴 계산과 반복 연산을 GPU에서 병렬 처리함으로써 대규모 데이터에서도 실용적인 실행 시간을 확보한다. 또한 최적 투영 차원을 탐색함으로써 데이터의 토폴로지적 차원 추정에도 활용한다. 실험…

저자: Henry Kvinge, Elin Farnell, Michael Kirby

본 논문은 고차원 데이터 집합을 저차원으로 효율적으로 임베딩하기 위한 새로운 알고리즘, Secant‑Avoidance Projection(SAP)을 제안한다. 서론에서는 현대 과학·공학에서 발생하는 페타바이트 규모의 데이터와 그에 따른 차원 축소 필요성을 강조하고, 기존 차원 축소 기법(PCA 등)이 데이터의 기하학적 구조를 충분히 보존하지 못한다는 점을 지적한다. 차원 추정 자체가 고성능 컴퓨팅 환경에서 병렬화 가능한 작업이라는 관점을 제시하며, 이를 위한 수학적 배경을 다음 두 섹션에 정리한다.

첫 번째 배경 섹션에서는 토폴로지적 차원 개념과 Whitney 임베딩 정리를 소개한다. Whitney 정리는 m‑차원 매끄러운 콤팩트 다양체를 2m + 1 차원 유클리드 공간에 매끄럽게 임베딩할 수 있음을 보장한다. 정리의 증명 과정에서 섹턴 집합 S(모든 서로 다른 점 쌍의 차이 벡터)가 핵심 역할을 하며, 섹턴에 너무 가깝게 투영되지 않을 경우 투영 함수가 bi‑Lipschitz가 되어 역함수가 잘 정의된다. 두 번째 배경에서는 bi‑Lipschitz 조건을 수식화하고, 이 조건이 만족될 때 차원 보존이 이루어진다는 정리를 제시한다.

알고리즘 설계 섹션에서는 구체적인 SAP 절차를 설명한다. 입력으로는 데이터 집합 X ⊂ ℝⁿ, 목표 차원 m, 최대 반복 횟수(또는 수렴 기준), 그리고 이동 파라미터 α가 주어진다. 먼저 모든 섹턴 s = (xᵢ − xⱼ)/‖xᵢ − xⱼ‖₂를 계산하고, 이를 n × p 행렬 S에 열벡터 형태로 저장한다. 이 단계는 섹턴 수 p = n(n‑1)/2가 급격히 증가하므로 GPU에서 완전 병렬화한다. 초기 투영 P¹은 SVD(S = UΣVᵀ)에서 상위 m개의 좌측 특이벡터를 취해 PCA와 동일하게 설정한다.

반복 단계에서는 현재 투영 P⁽ⁱ⁾에 대해 모든 섹턴의 투영 길이 ‖P⁽ⁱ⁾ᵀs‖₂를 계산하고, 최소값을 갖는 섹턴 s*를 찾는다. 이 섹턴이 현재 투영에서 가장 약하게 보존된 방향이므로, 투영 공간을 s* 쪽으로 조금씩 회전시켜 보존성을 향상시킨다. 구체적으로는 s*의 현재 투영 PPᵀs*를 구하고, 기존 열벡터 중 s*와 가장 큰 내적을 갖는 벡터 pₜ를 선택한다. 수정된 Gram‑Schmidt 과정을 통해 PPᵀs*를 새로운 첫 번째 열벡터에 포함시키고, 나머지 열벡터는 직교성을 유지하도록 재정규화한다. 이후 첫 번째 열벡터를 (1‑α)·PPᵀs* + α·(s* − PPᵀs*) 방향으로 정규화하여 새로운 투영 P⁽ⁱ⁺¹⁾를 만든다. α는 0.01로 고정해 매 단계마다 작은 변화를 보장한다.

복잡도 측면에서 가장 무거운 연산은 섹턴 행렬 S의 생성(O(n²) 메모리·연산)와 매 반복마다 모든 섹턴에 대한 ‖Pᵀs‖₂ 계산이다. 저자들은 CUDA 8.0과 Nvidia Tesla K80 2개 GPU를 이용해 이 과정을 수천 개의 스레드에 분산시켰으며, cuSolver 라이브러리를 통해 SVD를 GPU에서 직접 수행했다. 실험 환경은 12,800개의 샘플을 가진 10차원 트리곤메트릭 곡선이며, 100번 반복을 2 GPU에서 몇 초 내에 완료했다.

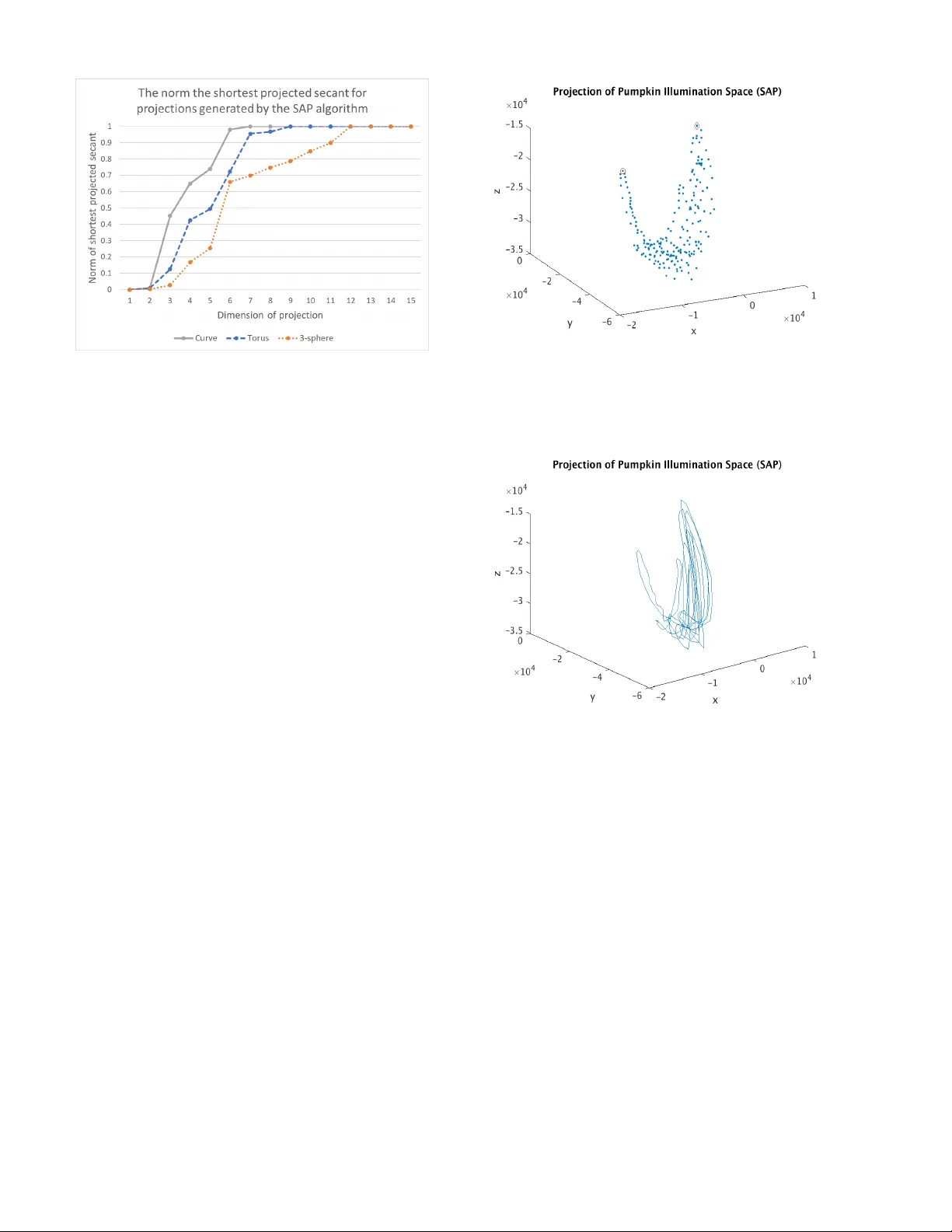

실험 결과는 두 부분으로 나뉜다. 첫 번째는 시각적·정량적 비교로, 동일 데이터에 대해 (1) 원본 10차원 좌표 중 첫 3축 투영, (2) PCA 기반 3차원 투영, (3) SAP 기반 3차원 투영을 제시한다. 최소 섹턴 길이 기준으로 SAP은 0.1677, PCA는 0.0466, 원시 투영은 0.1013을 기록해, SAP이 가장 큰 최소 섹턴 길이를 확보함을 확인한다. 두 번째는 차원 추정 실험으로, 256점씩 샘플링한 (a) 1‑차원 곡선, (b) 2‑차원 토러스, (c) 3‑차원 구를 각각 15차원에 임베딩한 뒤, SAP을 다양한 목표 차원 m에 적용한다. 최소 섹턴 길이가 급격히 증가하는 차원은 각각 3, 5, 7으로, Whitney 정리의 상한과 일치한다. 흥미롭게도 토러스와 구는 이론적 상한보다 낮은 차원(4, 6)에서도 충분히 임베딩이 가능함을 보여, 실제 데이터에서는 이론적 상한이 보수적일 수 있음을 시사한다.

논문의 마지막 섹션에서는 노이즈가 존재하는 경우를 위한 변형 방안을 제시하고, 섹턴 샘플링, α 자동 튜닝, 다중 GPU 스케일링 등 향후 연구 과제를 제시한다. 전체적으로 이 연구는 섹턴 기반 차원 축소라는 수학적 프레임워크를 GPU 병렬 처리와 결합해, 고품질 임베딩과 데이터 차원 추정을 동시에 달성하는 실용적인 알고리즘을 제공한다는 점에서 데이터 과학·머신러닝·컴퓨터 비전 분야에 큰 기여를 할 것으로 기대된다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기