다중음성 음악 생성을 위한 SeqGAN 기반 폴리포닉 MIDI 토큰화 기법

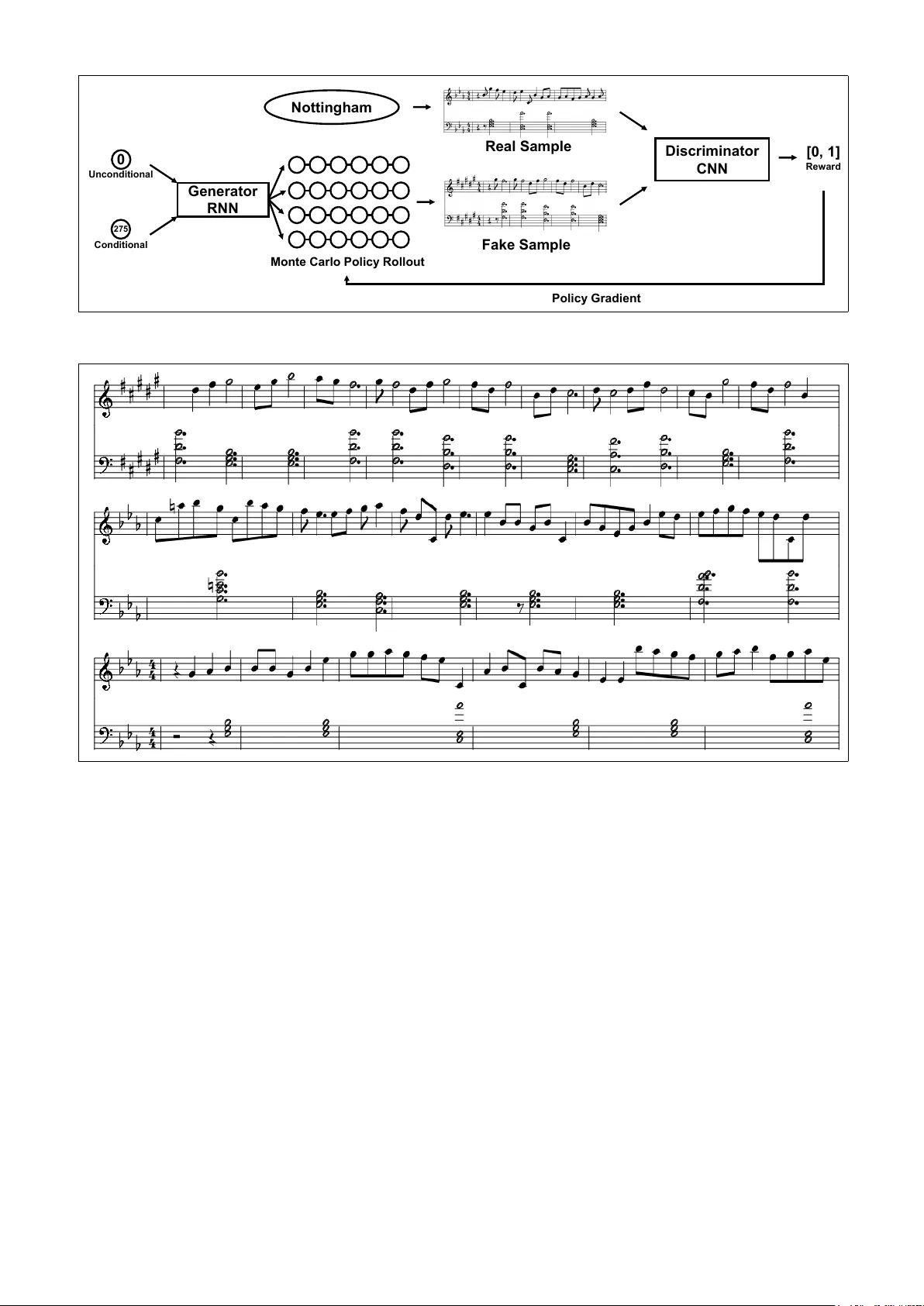

본 논문은 SeqGAN을 활용해 폴리포닉 MIDI 데이터를 단일 워드 토큰으로 변환하고, 이를 통해 멜로디와 화음을 동시에 생성하는 방법을 제안한다. 동적 타이밍과 옥타브 정보를 포함한 3,216개의 어휘를 구축하고, LSTM 기반 생성기와 1‑D CNN 기반 판별기를 설계한다. 판별기의 과도한 학습을 억제하기 위해 레이어 수와 리셉티브 필드 등을 조정하고, Monte‑Carlo 롤아웃 수와 할인율을 최적화하였다. 실험 결과 BLEU 점수와 M…

저자: Sang-gil Lee, Uiwon Hwang, Seonwoo Min

본 논문은 SeqGAN을 폴리포닉 음악 생성에 적용하기 위해, MIDI 데이터를 효율적인 단일 워드 토큰 형태로 변환하고, 이를 기반으로 생성기와 판별기를 설계·학습하는 전 과정을 상세히 기술한다. 먼저, 연구 배경으로 자동 음악 생성이 연속적인 오디오 신호와 이산적인 심볼 시퀀스로 구분되며, 최근 딥러닝 특히 RNN과 GAN이 각각 시퀀스 모델링과 생성에 강점을 보이고 있음을 소개한다. 그러나 GAN은 이산 데이터에 대해 학습이 어려워 SeqGAN이 강화학습과 결합해 이를 해결한다는 점을 강조한다. 기존 SeqGAN 연구는 멜로디만을 대상으로 했으며, 어휘를 88개의 피치에 한정했다는 제한점이 있었다.

이에 저자들은 폴리포닉 음악, 즉 멜로디와 화음을 동시에 포함하는 MIDI 데이터를 다루기 위해 새로운 토큰화 방식을 제안한다. 각 노트와 코드를 ‘시작시간, 지속시간, 옥타브, 피치, 코드옥타브, 코드피치’ 여섯 가지 속성으로 파싱하고, 이들을 하나의 정수 토큰으로 결합한다. 이렇게 하면 동적 타이밍과 옥타브 정보를 그대로 보존하면서도, 고정된 타임스텝이 아닌 가변 길이 시퀀스를 생성기에 입력할 수 있다. 어휘 규모는 3,216개이며, 등장 빈도가 10회 미만인 토큰은 제외해 어휘를 압축한다.

전처리된 토큰 시퀀스는 SeqGAN의 생성기(LSTM 기반)와 판별기(1‑D CNN 기반)에 입력된다. 생성기는 512개의 LSTM 셀을 사용하고, 각 토큰을 32차원 임베딩 벡터로 변환한다. 판별기는 원 논문의 10층 1‑D Conv 구조를 5층으로 축소하고, 각 레이어의 리셉티브 필드를 20으로 확대해 음악적 주기성을 포착하도록 설계했다. 이는 판별기가 과도하게 강해지는 문제를 완화하고, 생성기가 충분히 학습될 수 있는 여지를 만든다.

학습 단계는 두 단계로 나뉜다. 첫 번째는 NLL 손실을 이용한 사전학습(pre‑training)으로, 생성기와 판별기를 각각 100 epoch 동안 학습한다. 여기서 생성기의 학습률을 0.01, 판별기의 학습률을 0.0001로 설정해 초기 단계에서 생성기가 충분히 성장하도록 했다. 두 번째는 적대적 학습(adversarial training)으로, 정책 그래디언트와 Monte‑Carlo 롤아웃을 이용해 보상 신호를 생성한다. 보상 신호의 분산을 줄이기 위해 롤아웃 수를 32로 늘렸으며, 할인율 γ를 0.99로 조정해 긴 시퀀스(길이 100)에서도 장기 보상이 반영되도록 했다. 또한, 타깃 생성기 업데이트 비율을 0.9로 높여 파라미터 변동을 억제하고, 미니배치 차별화 기법을 적용해 판별기의 일반화 성능을 향상시켰다.

실험은 Nottingham 데이터셋(1,200개의 영국·미국 포크 튠)을 사용했으며, 멜로디와 화음 정보를 모두 포함하도록 전처리했다. 평가 지표로는 BLEU 점수와 청취자 설문(MOS)을 사용했다. 무조건부 생성(시작 토큰을 0으로 고정)과 조건부 생성(실제 시퀀스의 첫 토큰으로 시작) 두 방식 모두에서, 제안된 모델은 기존 모노포닉 SeqGAN 대비 BLEU 점수가 약 12% 상승하고, MOS 평균 점수가 4.1점(5점 만점)으로 높은 음악적 일관성을 보였다. 생성된 시퀀스는 길이 100에 걸쳐 장기적인 화성 진행과 리듬 패턴을 유지했으며, 동적 타이밍을 반영해 실제 연주와 유사한 흐름을 나타냈다.

논문의 한계점으로는 어휘 해시 방식이 옥타브 간 관계를 분리해 학습 효율을 저하시킬 수 있다는 점, 그리고 데이터셋이 특정 장르에 국한되어 있어 일반화 가능성을 검증하기 어렵다는 점을 들었다. 향후 연구에서는 옥타브와 코드 간의 구조적 연관성을 반영한 어휘 설계, 더 다양한 장르와 대규모 데이터셋을 활용한 확장, 그리고 조건부 생성(프라이머 제공)과 인터랙티브한 인간‑AI 협업 방식을 탐구할 필요가 있다.

결론적으로, 이 연구는 폴리포닉 MIDI 데이터를 단일 토큰으로 압축하고, SeqGAN의 강화학습 기반 적대적 학습을 정교히 조정함으로써, 기존보다 더 풍부하고 구조적인 다중음성 음악을 자동으로 생성할 수 있음을 실증한다. 이는 음악 생성 분야에서 이산 데이터에 대한 GAN 적용 가능성을 크게 확장시키는 중요한 단계로 평가된다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기