톤 화성 예측을 위한 언어 모델 비교: PPM이 RNN을 앞서다

본 연구는 대규모 서양 전통음악 코퍼스를 이용해 화성 진행을 예측하는 두 종류의 언어 모델, 가변 차수 마코프 모델(PPM)과 순환 신경망(RNN)을 비교한다. 데이터‑드리븐 chord 인코딩을 적용해 약 200개의 화성 유형으로 축소한 뒤, 교차 엔트로피 기준으로 평가한 결과 피아노 데이터셋에서 PPM이 RNN보다 우수했으며, 회귀 분석을 통해 RNN이 희귀 화성에 취약함을 확인하였다.

저자: David R. W. Sears, Filip Korzeniowski, Gerhard Widmer

본 연구는 서양 전통음악의 화성 구문을 언어 모델링 기법으로 분석하고, 최신 확률적 모델들의 성능을 대규모 코퍼스를 통해 비교한다. 먼저 9개의 데이터셋(바흐 코랄, 하이든 현악 사중주, 모차르트 현악 사중주·피아노, 베토벤 현악 사중주·피아노, 쇼팽 피아노, 조플린 랙, 다양한 교향곡 등)으로 구성된 총 1,013,786개의 화성 토큰을 수집하였다. 각 화성 onset는 베이스 음의 스케일 디그리(I)와 베이스 위의 최대 세 개 인터벌(S)로 이루어진 (S, I) 튜플로 인코딩했으며, 음의 중복과 순열을 허용해 13³ 가능한 조합을 233개의 실질적 화성 유형으로 축소하였다. 이 인코딩은 화성 어휘를 크게 감소시켜 모델 학습을 효율화한다.

모델링은 두 가지 접근법으로 진행되었다. 첫 번째는 가변 차수 마코프 모델인 IDyOM을 기반으로 한 Prediction by Partial Match (PPM*) 알고리즘이며, escape method C와 혼합 스무딩을 적용해 고차수 컨텍스트의 희소성을 보완한다. 또한 장기 통계(LTM+)와 단기 캐시(STM)를 각각 학습하고, 두 통계를 가중 기하 평균(BOTH+)으로 결합해 전반적인 예측력을 강화하였다. 두 번째는 순환 신경망(RNN)으로, 2층 128유닛 LSTM 또는 GRU 구조에 64차원 임베딩을 사용하고, 입력‑출력 사이에 스킵 연결을 두어 정보 흐름을 원활하게 했다. 학습은 Adam 옵티마이저와 배치 크기 4, 최대 200 epoch, 조기 종료(10 epoch 연속 검증 손실 감소 없음) 및 그래디언트 클리핑(1.0 초과)으로 진행하였다.

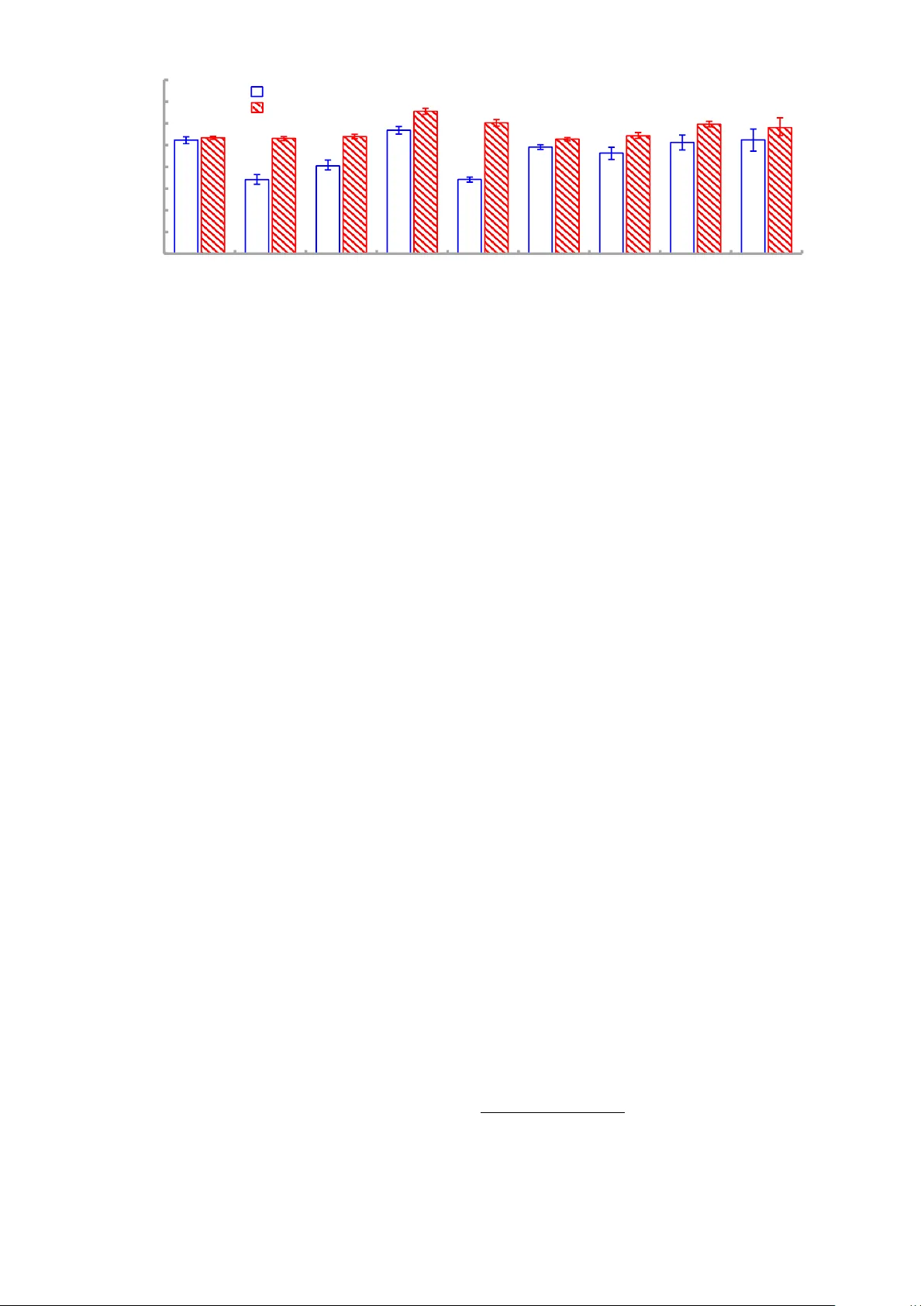

성능 평가는 교차 엔트로피(Hₘ)로 수행했으며, 4‑fold 교차 검증을 통해 각 데이터셋별 평균값을 산출하였다. 결과는 PPM 기반 모델이 전체 코퍼스와 개별 데이터셋에서 RNN보다 낮은 교차 엔트로피를 기록했음을 보여준다. 특히 피아노 전용 데이터셋(쇼팽, 조플린)에서는 차이가 가장 크게 나타났으며, 이는 피아노 음악이 화성 진행에서 보다 규칙적인 패턴을 보이기 때문으로 해석된다. 회귀 분석에서는 화성 유형의 빈도, 인터벌 복잡도, 베이스 스케일 디그리 등이 설명 변수로 사용되었고, 희귀 화성(출현 빈도 낮은 경우)이 RNN의 예측 오류에 크게 기여한다는 결과가 도출되었다. 이는 RNN이 데이터 희소성에 취약하고, 고차원 화성 공간에서 일반화 능력이 제한적임을 의미한다.

논문은 현재 인코딩이 화성‑멜로디 상호작용을 충분히 반영하지 못한다는 한계를 인정하고, Transformer 기반 모델, 데이터 증강, 멀티모달(음표와 화성 동시) 학습 등 향후 연구 방향을 제시한다. 또한, PPM과 같은 전통적인 확률 모델이 충분히 큰 코퍼스와 적절한 인코딩을 갖출 경우, 최신 딥러닝 모델보다도 경쟁력 있는 성능을 보일 수 있음을 실증적으로 입증하였다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기