디지털 네이티브를 위한 박물관 게임화와 VR·AR·ML·BCI 활용 방안

초록

**

본 논문은 디지털 네이티브 세대가 박물관에서 풍부한 학습 경험을 얻도록 돕기 위해, 인터랙티비티, 웨어러블, 가상·증강현실, 머신러닝, 뇌‑컴퓨터 인터페이스 등 최신 기술을 게임화와 결합한 교육 모델을 제시한다. 지역·글로벌 앱 설계, 실내 위치추적, AR·VR 콘텐츠, 음악·역사 기호 자동 인식 등 구체적 사례를 분석하고, 구현 시 고려해야 할 기술적·교육적 과제를 논의한다.

**

상세 분석

**

이 논문은 디지털 네이티브가 일상에서 접하는 고도화된 인터페이스를 박물관 교육에 그대로 옮겨 놓음으로써 학습 동기를 증폭시키는 전략을 제시한다. 먼저 ‘인터랙티비티’와 ‘웨어러블’은 사용자의 신체 움직임과 생체 데이터를 실시간으로 수집·반영하는 기반을 제공한다. 예를 들어, 손목 밴드나 스마트 글라스는 사용자의 위치, 심박, 시선 등을 파악해 맞춤형 퀘스트를 생성한다. 이는 전통적인 전시 해설보다 몰입감을 높이고, 학습자의 인지 부하를 적절히 조절한다는 장점을 가진다.

‘실내 지오로케이션’은 Wi‑Fi, BLE 비콘, GPS·Wi‑Fi 복합 방식을 활용해 전시물 근접성을 정밀하게 판단한다. 논문은 로컬 앱(각 박물관 전용)과 글로벌 앱(다수 박물관 통합) 두 가지 아키텍처를 비교하면서, 데이터베이스 관리, 네트워크 대역폭, 개인정보 보호 등 운영상의 트레이드오프를 제시한다. 특히 QR 코드와 AR‑지오태그를 병행하는 방안은 GPS 신호가 약한 실내에서도 원활한 콘텐츠 호출을 가능하게 한다.

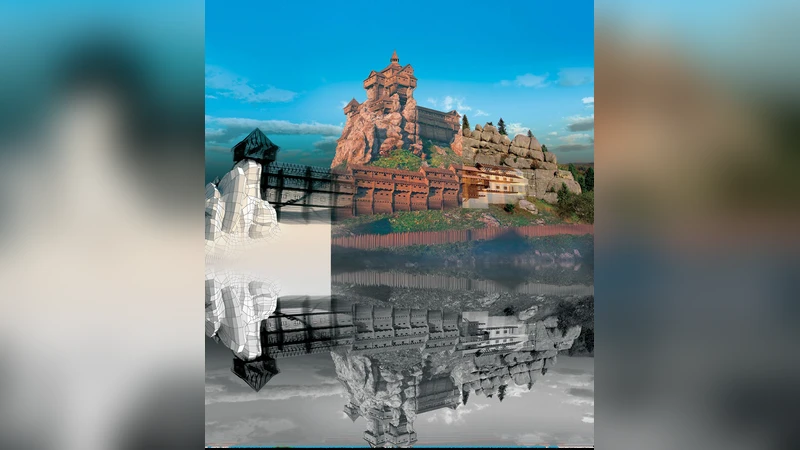

AR은 현실 세계에 3D 모델, 영상, 음성 등을 겹쳐 보여줌으로써 전시물의 역사적·과학적 맥락을 시각·청각적으로 보강한다. 논문은 ‘AR‑geotags’를 사전 배치하고, 방문자가 스마트폰 카메라로 마커를 인식하면 ‘geolayer’를 통해 다중미디어를 제공하는 흐름을 상세히 설명한다. 사용자는 직접 새로운 AR‑태그를 생성하거나 주석을 달아 디지털 생태계를 확장할 수 있어, 협업 학습과 사용자 생성 콘텐츠(UGC)의 가능성을 열어준다.

VR은 완전한 가상 환경을 제공해 물리적 제약을 초월한다. 저자는 구글 카드보드 기반의 저비용 VR 구현 사례와, 대형 박물관이 자체 VR 투어를 제공하는 사례를 비교한다. 특히, 고전적 전시물의 복원·시뮬레이션, 우주·심해 탐사 체험 등 ‘시간·공간 초월 학습’에 강점을 강조한다.

머신러닝은 두 가지 주요 응용으로 제시된다. 첫째, 악기 음성 인식을 통한 자동 악보 생성은 음악 전시의 접근성을 높인다. 최신 오디오 검색 알고리즘(예: Shazam, SoundHound)과 딥러닝 기반 음향 특징 추출을 결합해, 사용자가 현장에서 들은 소리를 실시간으로 악보화한다. 둘째, 역사적 기호·문자 해독 모델은 고대 유물의 텍스트를 자동으로 디지털화하고, AR 레이어에 매핑해 해설을 제공한다. 이러한 ML 파이프라인은 데이터 라벨링, 모델 경량화, 현장 연산(Edge) 등 실용적 과제를 동반한다.

마지막으로 뇌‑컴퓨터 인터페이스(BCI)는 아직 초기 단계이지만, 논문은 EEG 기반 집중도 측정과 게임 난이도 조절, 혹은 ‘뇌파‑제어 전시물’ 시나리오를 제안한다. 이는 학습자의 몰입 상태를 객관적으로 파악하고, 적시 피드백을 제공함으로써 학습 효율을 극대화할 수 있다.

전체적으로 저자는 기술 선택 시 ‘접근성(디바이스 보급률)’, ‘콘텐츠 제작 비용’, ‘데이터 프라이버시’, ‘교육 목표와의 정합성’ 등을 종합적으로 고려해야 함을 강조한다. 특히, 게임화 설계 원칙(목표 설정, 피드백 루프, 보상 체계)을 각 기술에 매핑함으로써, 단순한 엔터테인먼트를 넘어 지속 가능한 교육 효과를 창출할 수 있음을 입증한다.

**

댓글 및 학술 토론

Loading comments...

의견 남기기