쿼터니언 CNN을 활용한 엔드‑투‑엔드 음성 인식 혁신

본 논문은 멜‑필터뱅크 에너지와 그 1·2차 시간 미분을 하나의 쿼터니언으로 묶어, 쿼터니언 컨볼루션 신경망(QCNN)과 CTC 손실을 결합한 엔드‑투‑엔드 음성 인식 모델을 제안한다. TIMIT 데이터셋의 음소 인식 실험에서, 동일한 입력 특성을 사용했음에도 불구하고 QCNN은 파라미터 수를 크게 줄이면서 기존 실수값 CNN보다 낮은 PER(19.64 % vs 20.57 %)를 달성하였다.

저자: Titouan Parcollet, Ying Zhang, Mohamed Morchid

본 논문은 현대 음성 인식 시스템에서 널리 사용되는 멜‑필터뱅크 에너지와 그 1·2차 시간 미분(MFCC, 델타, 델타‑델타)을 하나의 복합 구조로 재구성하는 새로운 접근법을 제시한다. 저자들은 동일 주파수 대역의 세 가지 정보를 각각 i, j, k 축의 허수 성분에 할당하고, 실수부는 0으로 두어 4차원 쿼터니언 Q(f,t)=0+e(f,t)i+∂e/∂t j+∂²e/∂t² k 로 정의한다. 이렇게 하면 각 시간‑주파수 포인트가 하나의 하이퍼컴플렉스 수로 표현되며, 이는 기존 실수 벡터가 123 차원을 차지하던 것을 41 차원(=123/3) 쿼터니언 시퀀스로 압축한다.

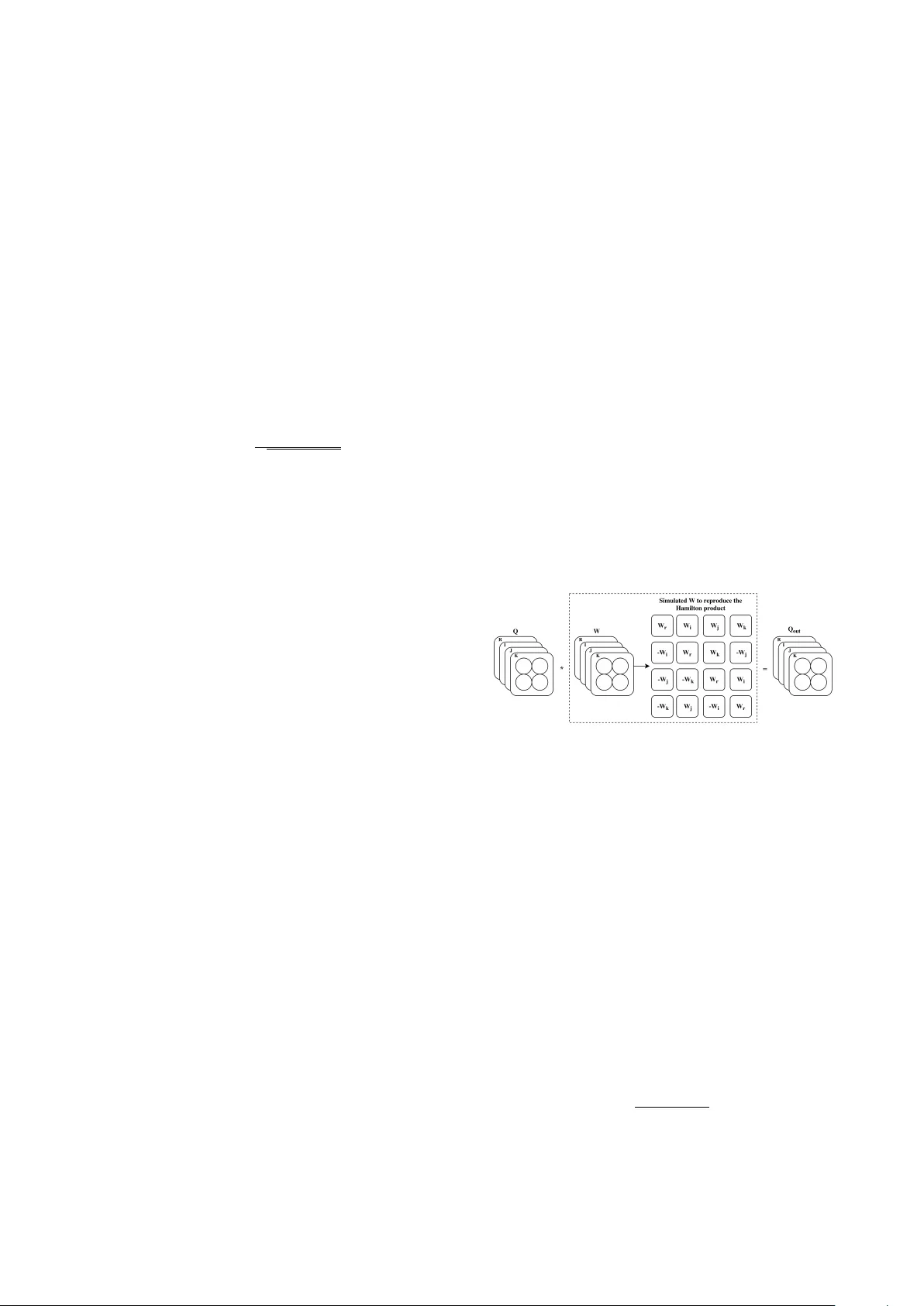

쿼터니언 컨볼루션 신경망(QCNN)은 이러한 입력을 처리하기 위해 해밀턴 곱(⊗)을 핵심 연산으로 채택한다. 해밀턴 곱은 두 쿼터니언을 실수 행렬 형태로 변환해 연산하므로, 기존 실수 CNN의 4배 규모 가중치 행렬을 1개의 쿼터니언 가중치로 대체한다. 결과적으로 동일한 네트워크 깊이와 필터 수에서도 파라미터 수가 약 4배 감소한다. 예를 들어, 256 필터맵·10 레이어 구조의 QCNN은 약 8.1 M 파라미터를 사용하지만, 대응 실수 CNN은 32.1 M 파라미터를 필요로 한다.

학습 과정에서는 각 쿼터니언 성분에 동일한 비선형 함수를 독립적으로 적용하는 “분할 활성화” 방식을 사용한다. 이는 실수부와 허수부 각각에 PReLU와 같은 표준 활성화를 적용해 미분 가능성을 확보한다. 가중치 초기화는 He 초기화 원칙을 쿼터니언에 맞게 확장했으며, 쿼터니언의 크기가 χ‑분포(자유도 4)를 따른다는 점을 고려해 분산 σ=1/√(2·n_in) 로 설정한다. 이러한 초기화는 기울기 소실·폭발을 방지하고 안정적인 학습을 돕는다.

시퀀스‑투‑시퀀스 매핑을 위해 CTC(Connectionist Temporal Classification) 손실을 도입한다. CTC는 입력 프레임과 라벨 시퀀스 간의 정렬을 자동으로 추정하며, 블랭크 토큰을 포함해 가능한 모든 정렬을 합산해 최적 라벨 시퀀스를 학습한다. QCNN의 출력은 각 타임스텝마다 소프트맥스 확률을 제공하고, CTC는 이 확률을 기반으로 손실을 계산한다.

실험은 TIMIT 코퍼스를 사용해 수행되었다. 원본 오디오를 40 차원 로그 멜‑필터뱅크로 변환하고, 에너지, 델타, 델타‑델타, 에너지 항을 포함해 123 차원 실수 벡터를 만든 뒤, 이를 위에서 정의한 쿼터니언 형태로 변환했다. 네트워크 구조는 2D 컨볼루션 → 주파수 축 풀링 → n개의 2D 컨볼루션 레이어 → 3개의 완전 연결 레이어(실수 모델은 1024·256, 쿼터니언 모델은 256·256) 로 구성했으며, 필터 크기는 (3,5) 로 동일하게 유지했다. 활성화는 PReLU, 드롭아웃 0.3, L2 정규화 1e‑5를 적용했으며, 초기 100 epoch는 Adam 옵티마이저, 이후 50 epoch는 SGD(learning rate 1e‑5)로 미세조정했다.

결과는 표 1에 요약된다. 전반적으로 QCNN은 동일한 레이어·필터 구성에서도 실수 CNN보다 낮은 PER을 기록했다. 특히 10 레이어·256 필터맵 구성에서 QCNN은 19.64%(테스트) PER를 달성했으며, 실수 CNN은 21.23%를 기록했다. 파라미터 수는 8.1 M vs 32.1 M 로 4배 이상 차이났다. 또한, 실수 CNN은 필터맵을 늘릴수록 과적합이 심화돼 PER이 오히려 상승하는 경향을 보였지만, QCNN은 파라미터 효율성 덕분에 깊이·폭을 확대해도 성능이 꾸준히 향상되었다.

논문의 주요 기여는 다음과 같다. 첫째, 음성 특성을 쿼터니언으로 구조화해 주파수 대역 내 다양한 시각(에너지, 속도, 가속도)을 하나의 하이퍼컴플렉스 수로 결합함으로써 내부 상관관계를 명시적으로 모델링했다. 둘째, 해밀턴 곱 기반 QCNN을 CTC와 결합해 정렬이 필요 없는 엔드‑투‑엔드 학습 파이프라인을 구축했다. 셋째, 파라미터 수와 메모리 사용량을 크게 절감하면서도 실수 CNN보다 우수한 인식 성능을 입증했다. 이러한 결과는 향후 더 복잡한 음성 인식 파이프라인(예: HMM, RNN, 어텐션, 언어 모델)과 결합했을 때도 큰 이점을 제공할 가능성을 시사한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기