전역 디코딩을 위한 디컨볼루션 기반 신경기계 번역 모델

초록

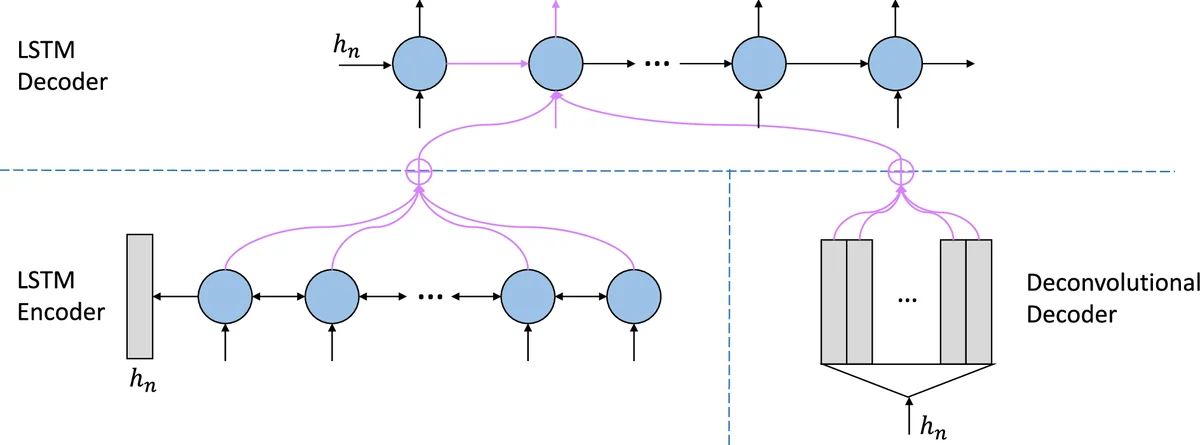

본 논문은 기존 RNN 기반 순차 디코딩의 한계를 극복하고자, 인코더의 최종 은닉 상태를 디컨볼루션 네트워크에 입력해 목표 언어의 전체 문맥을 담은 임베딩 행렬을 생성한다. 이 행렬을 전통적인 RNN 디코더가 어텐션을 통해 활용함으로써, 번역 과정에서 전역적인 구조 정보를 제공하고, 장문 번역 시 반복 현상을 감소시킨다. 중국어‑영어와 영어‑베트남어 데이터셋에서 BLEU 점수가 각각 2.82와 1.54 상승하는 등 기존 Seq2Seq 모델보다 우수한 성능을 보였다.

상세 분석

이 연구는 NMT에서 “번역은 순차적인 단어 생성이 아니라 전역적인 구조와 의미를 동시에 고려해야 한다”는 가설에 기반한다. 기존 Seq2Seq 모델은 인코더‑디코더 구조와 어텐션 메커니즘을 사용하지만, 디코더는 매 시점 이전 토큰에만 의존하는 순차적 의사결정 과정을 갖는다. 저자들은 이를 보완하기 위해 두 개의 디코더를 도입한다. 첫 번째는 전통적인 LSTM 디코더로, 소스‑사이드 어텐션과 함께 목표‑사이드 전역 정보를 활용한다. 두 번째는 디컨볼루션(전치 합성곱) 기반 디코더로, 인코더의 최종 은닉 상태 hₙ을 입력으로 받아 목표 언어의 임베딩 행렬 E∈ℝ^{T×dim}을 생성한다. 여기서 T는 사전에 정의된 출력 길이이며, 각 열은 실제 목표 단어 임베딩에 가까워지도록 학습된다. 디컨볼루션 레이어는 stride와 padding을 조절해 입력 벡터를 원하는 길이와 차원으로 확장한다. 이렇게 생성된 E는 RNN 디코더가 매 타임스텝마다 어텐션을 수행할 때 두 번째 어텐션 소스로 사용된다. 즉, c_t =∑α_{t,i} h_i (소스 어텐션)와 \tilde c_t =∑\tilde α_{t,i} E_i (목표 전역 어텐션) 를 동시에 고려함으로써, 디코더는 현재 생성 토큰을 선택할 때 전체 문맥을 참조한다. 학습 목표는 세 부분으로 구성된다. (1) 전통적인 NLL 손실을 통한 시퀀스 로그우도 최대화, (2) 디컨볼루션 출력 E와 실제 목표 임베딩 \tilde E 사이의 smooth L1 손실, (3) 디컨볼루션이 직접 예측한 토큰 \hat y 에 대한 코사인 기반 교차 엔트로피 손실이다. smooth L1은 작은 오차에 대해 L2, 큰 오차에 대해 L1 특성을 갖아 이상치에 강인하다. 실험에서는 중국어‑영어(NIST)와 영어‑베트남어(IWSLT) 두 데이터셋을 사용했으며, 동일한 하이퍼파라미터와 512 차원의 임베딩·히든 유닛을 적용했다. BLEU 점수는 베이스라인 Seq2Seq 대비 각각 2.82, 1.54 상승했으며, 특히 길이가 긴 문장과 반복 현상이 잦은 경우에 개선 효과가 두드러졌다. 이는 전역 어텐션이 장기 의존성을 완화하고, 디컨볼루션이 제공하는 전체 문맥이 디코더의 선택을 제약하기 때문으로 해석된다. 그러나 모델은 추가적인 CNN 디코더와 두 개의 어텐션 연산으로 인한 연산량 증가와 메모리 사용량 상승이라는 트레이드오프가 존재한다. 또한, 목표 임베딩 행렬 E의 길이 T를 고정해야 하는 제약이 있어, 실제 출력 길이가 크게 변동하는 경우에는 패딩 혹은 트렁케이션이 필요하다. 전반적으로 이 접근법은 순차적 디코딩의 한계를 보완하고 전역 정보를 효과적으로 활용함으로써 번역 품질을 향상시키는 새로운 패러다임을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기