신경망 테일러 근사로 본 수렴과 탐색: ReLU 네트워크의 새로운 이론

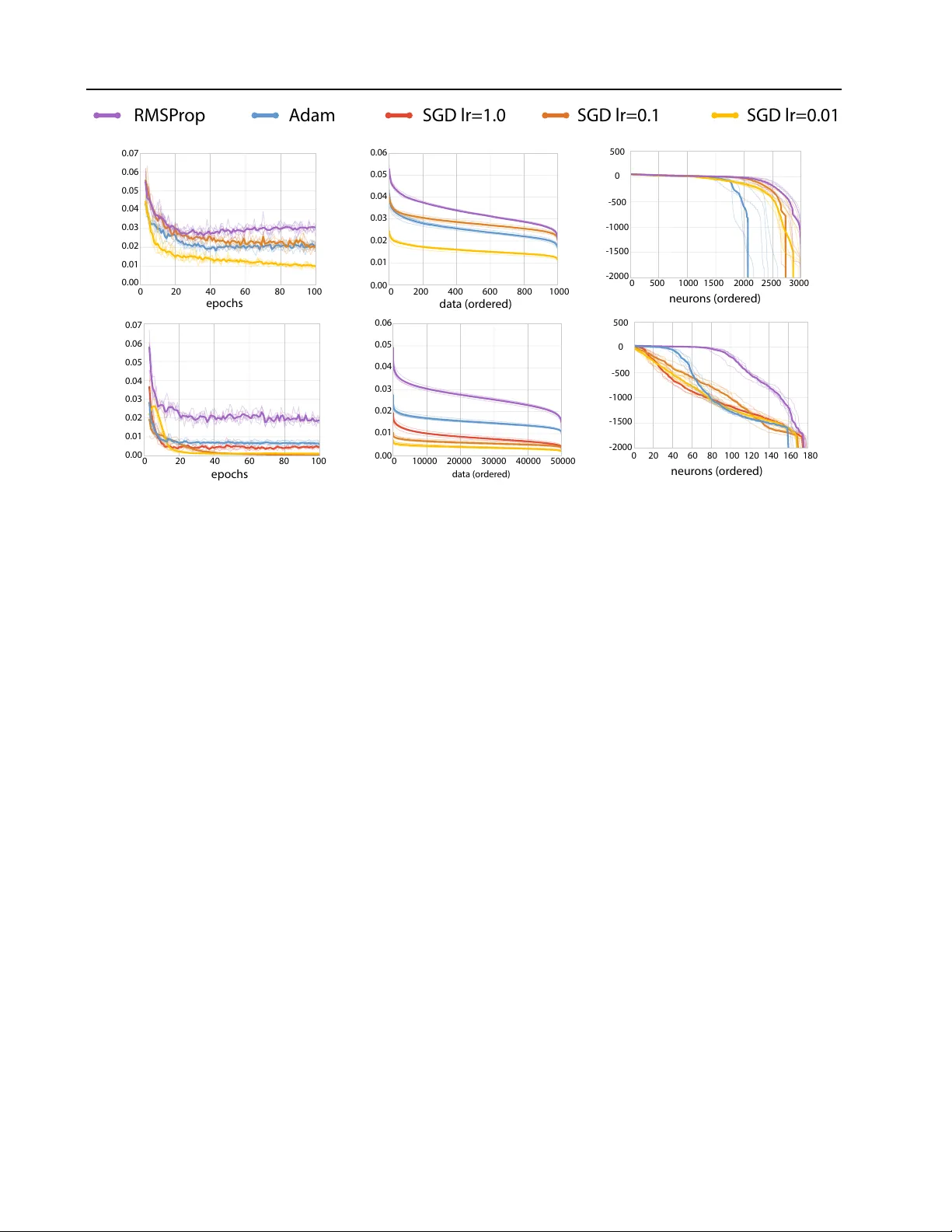

본 논문은 현대 컨볼루션 신경망에서 비부드럽고 비볼록인 ReLU와 max‑pooling 구조를 다루기 위해 ‘신경망 테일러 근사(Neural Taylor Approximation)’를 도입한다. 이를 기반으로 온라인 볼록 최적화 프레임에서 1/√N 수준의 무후회(no‑regret) 수렴을 증명하고, 그 최적값을 ‘테일러 최적(Taylor optimum)’이라 명명한다. 또한, 그래디언트가 파편화(shattered)되는 현상을 분석하고, RMSP…

저자: David Balduzzi, Brian McWilliams, Tony Butler-Yeoman

**1. 서론**

현대의 컨볼루션 신경망(CNN)은 ReLU와 max‑pooling 같은 비부드럽고 비볼록한 연산을 포함한다. 이러한 특성 때문에 기존의 부드럽거나 볼록한 함수에 대한 수렴 이론이 직접 적용되지 않는다. 그럼에도 불구하고 경사 하강법, Adam, RMSProp 등은 성공적으로 사용되고 있다. 저자는 이 격차를 메우기 위해 ‘신경망 테일러 근사(Neural Taylor Approximation)’라는 개념을 도입하고, 이를 통해 비부드러운 네트워크에도 적용 가능한 수렴 보장을 제시한다.

**2. 관련 연구**

볼록 최적화 기법을 신경망에 적용하려는 시도는 과거에도 있었으며, 게임 이론적 접근, 텐서 분해, 일반화된 가우스‑뉴턴 등 다양한 방법이 제안되었다. 그러나 대부분은 모델 자체를 변형하거나 부드러운 가정에 의존했다. Balduzzi(2016)의 게임 이론적 수렴 결과와는 달리, 본 논문은 실제 사용되는 ReLU 네트워크를 그대로 분석한다.

**3. 문제 정의와 온라인 볼록 최적화 프레임**

온라인 볼록 최적화에서는 매 라운드마다 새로운 볼록 손실 \(\ell_n\)이 제시되고, 알고리즘은 사후 레지스트(regret)를 최소화한다. 레지스트는 \(\text{Regret}(N)=\sum_{n=1}^N \ell_n(W_n)-\min_V\sum_{n=1}^N \ell_n(V)\) 로 정의된다. 기존 결과에 따르면, 경사 하강, AdaGrad, Adam 등은 \(\text{Regret}(N)=O(\sqrt{N})\) 를 만족한다.

**4. 신경망 테일러 근사 정의**

네트워크 파라미터를 \(W=\{W^1,\dots,W^L\}\)라 하고, 각 레이어 \(l\)의 출력에 대한 파라미터의 야코비안 텐서 \(G_l=J_{L}^{l}\)를 정의한다. 입력 \(x\)와 현재 파라미터 \(W_n\)에 대해 1차 테일러 전개를 수행하면

\

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기