스파크와 MPI를 연결한 알케미스트: 대규모 선형대수 가속기

초록

알케미스트는 Apache Spark와 고성능 MPI 라이브러리를 연동해, 선형대수·머신러닝 연산을 수십 배 빠르게 수행한다. 데이터는 TCP 소켓으로 직접 전송되며, Elemental을 이용해 분산 행렬을 관리한다. 실험에서는 대규모 CG와 400 GB SVD에서 각각 10배, 7.9배 속도 향상을 확인했으며, 17.6 TB까지 확장 가능함을 보였다.

상세 분석

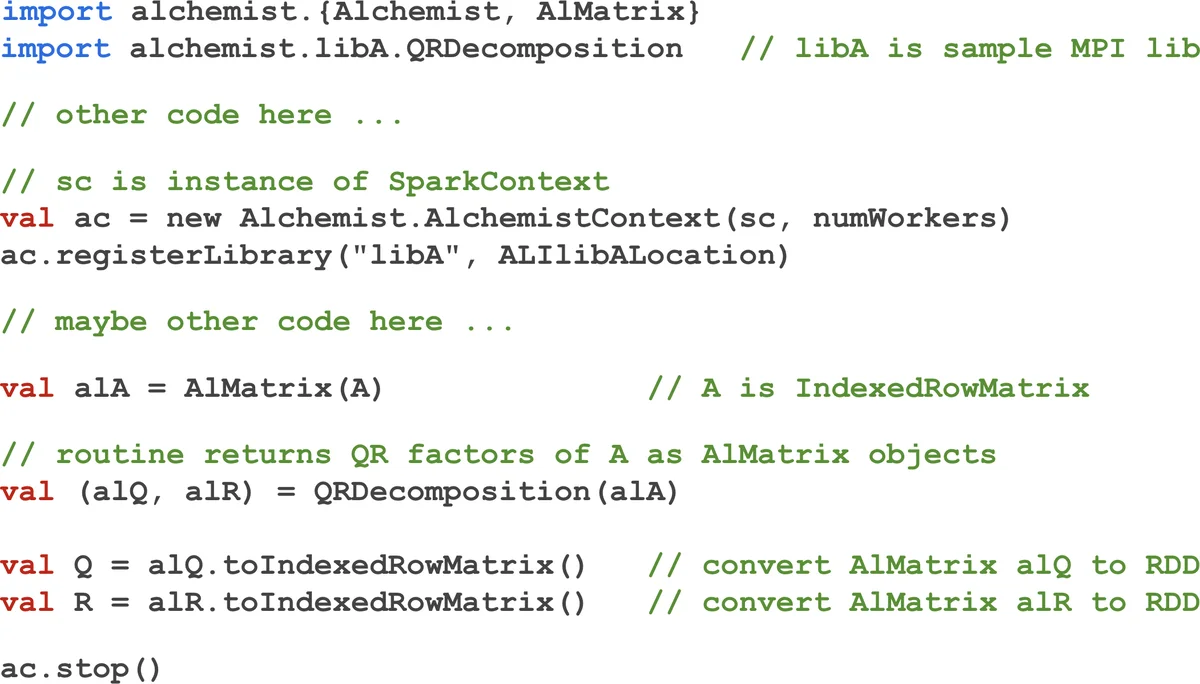

본 논문은 Spark가 제공하는 높은 생산성에도 불구하고, 반복적인 선형대수 연산에서 발생하는 통신 오버헤드와 스케줄러 지연이 성능을 크게 저해한다는 점을 지적한다. 특히 SVD·PCA와 같은 알고리즘은 Bulk‑Synchronous 모델 하에서 작업 간 동기화 비용이 급증해, 동일 규모의 MPI 구현에 비해 10배 이상 느려진다. 이를 해결하기 위해 제안된 알케미스트는 Spark 애플리케이션과 MPI 기반 라이브러리 사이에 브리지 역할을 수행한다. 설계는 세 가지 핵심 컴포넌트로 구성된다. 첫째, 알케미스트 자체는 MPI 프로세스로 시작해 다수의 워커를 유지하고, 필요 시 동적으로 라이브러리를 로드한다. 둘째, Alchemist‑Client Interface(ACI)는 Spark 드라이버와 실행자 사이에 TCP 소켓을 열어 데이터를 직접 전송한다. 이 방식은 파일 I/O나 중간 메모리 복사보다 훨씬 낮은 지연을 제공한다. 셋째, Alchemist‑Library Interface(ALI)는 C/C++ 공유 객체 형태로 구현돼, 사용자가 원하는 MPI 함수명을 전달하면 해당 라이브러리를 호출하고 결과를 직렬화해 다시 Spark로 반환한다. 데이터 전송은 Spark의 IndexedRowMatrix를 행 단위 바이트 스트림으로 변환해 전송하고, 수신 측에서는 Elemental 라이브러리의 DistMatrix 형태로 재구성한다. Elemental은 고성능 분산 행렬 연산을 지원하므로, 이후의 CG나 SVD 같은 알고리즘을 기존 MPI 구현 그대로 활용할 수 있다. 실험에서는 두 가지 대표 워크로드를 선택했다. 첫째, 대규모 음성 분류 문제에서 대칭 양정치 행렬에 대해 Conjugate Gradient를 적용했으며, Spark 순수 구현 대비 약 10배 빠른 실행 시간을 기록했다. 둘째, 400 GB 규모의 3‑차원 해양 온도 데이터에 대해 Truncated SVD를 수행했을 때, 알케미스트 기반 구현이 최대 7.9배 가속되었다. 또한 동일 코드를 17.6 TB 데이터셋에 적용해 선형 확장성을 확인했으며, 데이터 전송 오버헤드가 전체 실행 시간의 10~15% 수준에 머물렀다. 관련 연구와 비교했을 때, 기존 Spark+MPI 프로젝트들은 파일 기반 전송이나 공유 메모리 사용으로 높은 오버헤드와 확장성 한계를 보였지만, 알케미스트는 직접 소켓 전송과 동적 라이브러리 로딩으로 이러한 문제를 크게 완화한다. 다만 현재는 밀집 행렬에 최적화돼 있으며, 희소 행렬 지원 및 자동 자원 스케줄링, 장애 복구 메커니즘 등은 향후 과제로 남아 있다. 전반적으로 알케미스트는 Spark 환경의 생산성을 유지하면서, HPC 수준의 연산 성능을 손쉽게 도입할 수 있는 실용적인 솔루션으로 평가된다.

댓글 및 학술 토론

Loading comments...

의견 남기기