이미지 활용 멀티모달 NMT 성능 향상 연구

초록

본 논문은 이미지 정보를 결합한 멀티모달 신경기계번역(NMT)에서 다양한 어텐션 메커니즘을 비교·분석한다. Soft, Hard Stochastic, Local 어텐션을 구현하고, 게이팅·그라운딩 기법을 추가해 이미지 활용도를 높였다. Multi30K 데이터셋(영어→독일어) 실험에서 기존 최고점수를 넘어서는 BLEU 점수를 기록했으며, 이미지가 번역에 미치는 긍정·부정 효과를 정량·정성적으로 조사하였다.

상세 분석

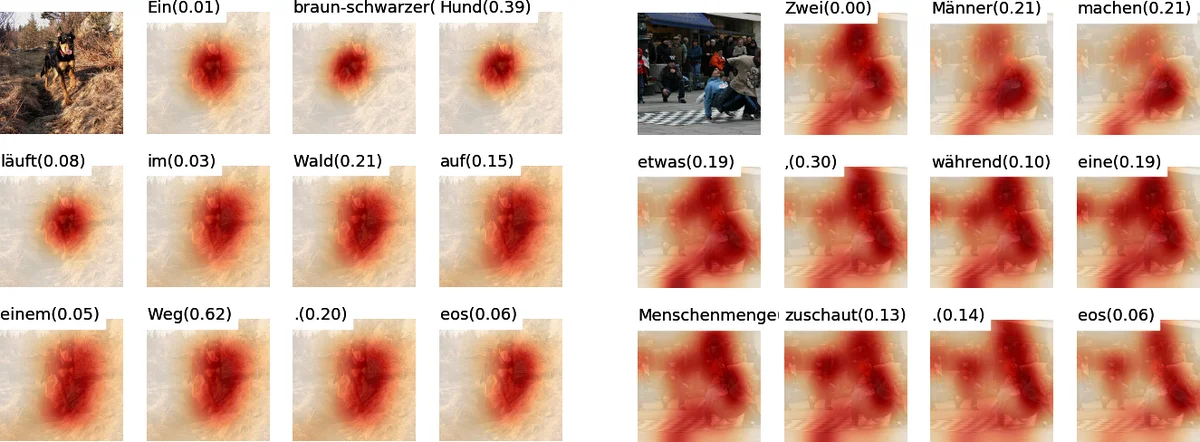

이 연구는 기본적인 Bahdanau‑style 어텐션 기반 NMT 구조에 조건부 GRU(cGRU)를 도입하고, 이를 멀티모달 버전으로 확장하였다. 이미지 특징은 ResNet‑50의 res4f 레이어에서 추출한 14×14×1024 텐서를 196개의 공간 어노테이션(a₁…a_L)으로 변환한다. 세 가지 이미지 어텐션 방식을 제안한다. 첫째, Soft Attention은 모든 어노테이션에 대해 선형 변환 후 tanh‑비선형을 거쳐 스코어 e_{t,l}=vᵀtanh(U_a s₀_t + W_a a_l)를 계산하고, 소프트맥스로 정규화해 가중합 i_t=∑α_{t,i} a_i를 만든다. 둘째, Hard Stochastic Attention은 멀티노미얼 분포 α_t에 따라 하나의 어노테이션만 샘플링(γ_t)하고, 변분 하한을 Monte‑Carlo 샘플링으로 근사해 학습한다. 셋째, Local Attention은 예측된 정렬 위치 p_t= S·sigmoid(vᵀtanh(U_a s₀_t))를 중심으로 반경 D=|I|/4(≈49) 내의 윈도우에만 가중치를 부여하며, 가우시안 마스크를 적용해 연속적인 지역 정보를 강조한다.

추가 최적화로는 (1) 이전 디코더 상태 s_{t‑1}으로부터 게이트 β_t=σ(W_β s_{t‑1}+b_β)를 구해 i_t=β_t∑α_{t,i} a_i 로 이미지 컨텍스트의 영향력을 동적으로 조절하고, (2) 어텐션 파라미터 차원을 2배 확대해 어노테이션 스코어의 표현력을 강화했으며, (3) Grounded Attention을 도입해 초기 디코더 상태 s₀와 각 어노테이션을 합산 후 tanh, L2 정규화, 1×1 컨볼루션을 거쳐 이미지별 중요도 α를 재계산한다. 이러한 기법들은 이미지 정보가 번역에 실제로 기여하도록 유도한다. 실험 결과, Soft Attention이 가장 안정적인 BLEU 향상을 보였으며, Hard Stochastic은 학습 불안정성으로 성능이 뒤떨어졌다. Local Attention은 특정 객체에 집중하는 경향이 있어 일부 문장에서는 유리했지만 전반적인 점수는 Soft에 미치지 못했다. 게이팅 및 그라운딩 기법은 모든 모델에서 평균 0.5~0.8 BLEU 포인트의 추가 이득을 제공하였다.

댓글 및 학술 토론

Loading comments...

의견 남기기