다중 보상 강화 요약: 중요도와 함의 기반 새로운 접근

초록

본 논문은 추상적 텍스트 요약에 saliency와 logical entailment를 반영한 두 개의 새로운 보상 함수(RougeSal, Entail)를 도입하고, 이를 기존 ROUGE 보상과 교대로 최적화하는 다중 보상 강화 학습 프레임워크를 제안한다. Saliency는 SQuAD 답변 스팬을 이용해 학습한 키프레이즈 예측기로 가중치를 부여하고, Entail은 SNLI·Multi‑NLI 기반 함의 분류기로 요약 문장이 원문에 논리적으로 함의되는지를 점수화한다. CNN/DailyMail에서 최첨단 성능을 달성했으며, DUC‑2002 전이 실험에서도 강인함을 입증한다.

상세 분석

이 연구는 추상적 요약 모델이 단순히 n‑gram 일치(Rouge)만을 최적화하는 한계를 인식하고, 두 가지 인간 중심의 질적 요소—핵심 정보 강조(saliency)와 논리적 함의(entailment)—를 강화 학습 보상에 직접 통합한다는 점에서 혁신적이다. Saliency 보상인 RougeSal은 기존 Rouge 점수에 토큰별 가중치를 곱해 중요한 구절이 더 큰 영향을 미치도록 설계되었다. 이 가중치는 SQuAD 데이터셋의 질문‑답변 스팬을 학습한 바이디렉셔널 LSTM 기반 키프레이즈 예측기로부터 얻으며, 답변이 인간이 선택한 핵심 구절이라는 가정 하에 문서 전반의 중요도를 추정한다. Entail 보상은 사전 학습된 자연어 함의 모델(Parikh et al., 2016)을 활용해, 생성 요약의 각 문장을 정답 요약을 전제로 한 함의 확률로 변환한다. 여기서 길이 정규화를 도입해 짧은 문장이 인위적으로 높은 점수를 받는 현상을 방지한다.

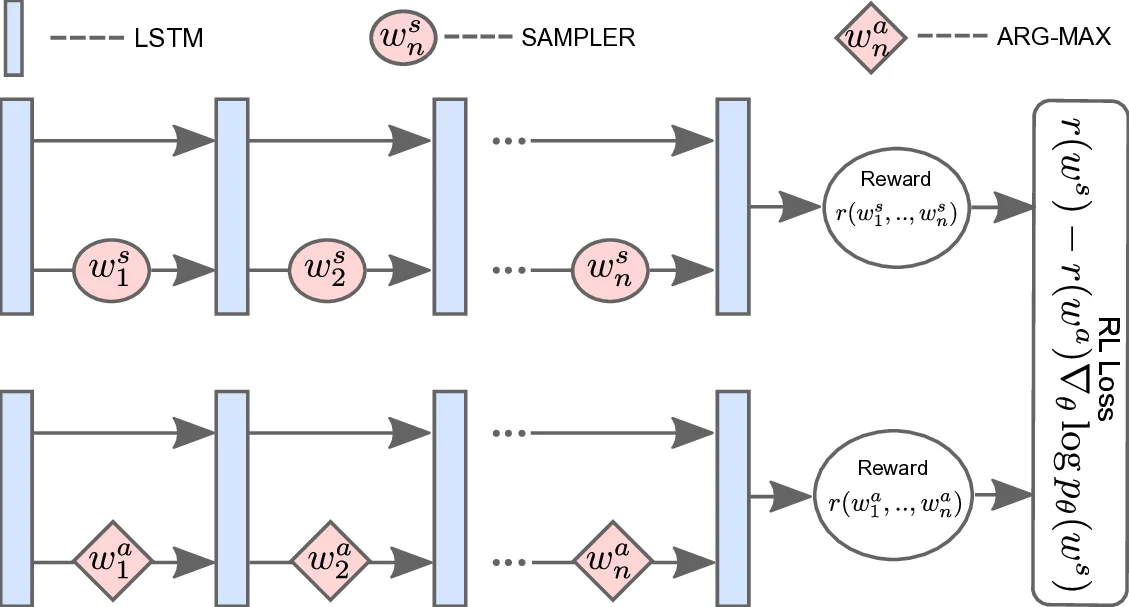

다중 보상 최적화는 두 보상을 동시에 최적화하려는 전통적 가중합 방식의 스케일링 문제를 회피하기 위해, 미니배치 단위로 보상을 교대로 적용하는 방식으로 구현된다. 이는 다중 작업 학습(MTL)에서 파라미터를 공유하되 손실 함수를 번갈아 적용하는 아이디어와 유사하며, 복잡한 하이퍼파라미터 튜닝 없이도 각 보상의 효과를 독립적으로 유지한다. 강화 학습 자체는 REINFORCE 기반의 Self‑Critical Sequence Training(SCST)을 사용해, 현재 모델의 greedy 출력(베이스라인)과 샘플링 출력의 보상 차이를 그래디언트에 반영한다.

실험에서는 기본 Pointer‑Generator + Coverage 모델을 교차 엔트로피 학습한 뒤, 다양한 보상 조합(Rouge, RougeSal, Entail, Rouge+Entail, RougeSal+Entail)을 순차적으로 적용한다. Rouge 보상만 사용해도 기존 모델 대비 유의미한 ROUGE‑L 향상이 관찰됐으며, RougeSal과 Entail 각각이 독립적으로 ROUGE‑1, ROUGE‑2, METEOR 등에서 통계적으로 유의한 개선을 보였다. 특히 두 보상을 결합한 RougeSal+Entail은 모든 자동 평가 지표에서 가장 높은 점수를 기록했으며, 인간 평가에서도 관련성(relevance)과 가독성(readability) 모두에서 기존 최첨단 모델(See et al., 2017)을 능가했다. 전이 실험으로 DUC‑2002에 테스트‑전용으로 적용했을 때도 동일한 추세가 유지돼, 제안된 보상 구조가 데이터셋 간 일반화 능력을 강화함을 시사한다.

한계점으로는 Saliency 예측기가 위키피디아 기반 SQuAD에 의존한다는 점에서 도메인 편향이 존재할 수 있으며, Entail 보상이 문장‑대‑문장 함의에만 초점을 맞추어 긴 문서 전체의 논리적 일관성을 완전히 포착하지 못한다는 점을 들 수 있다. 향후 연구에서는 멀티모달 혹은 도메인‑특화 Saliency 라벨링, 그리고 문서‑전체 함의를 고려한 구조적 엔코더를 도입해 보상의 정밀도를 높이는 방향이 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기