딥러닝 기반 스피커 인식: DBN과 MFCC 융합

본 논문은 딥 빌리프 네트워크(DBN)로 학습한 단시간 스펙트럼 특징을 MFCC와 결합하여 화자 인식 성능을 향상시키는 방법을 제안한다. 128 차원의 프레임 스펙트럼을 입력으로 두 개의 은닉층(각 200유닛)으로 구성된 DBN을 학습하고, 1·2층의 활성화를 L1·L2 특징으로 추출한다. 이 특징들을 2~14번째 MFCC와 결합한 후 GMM‑UBM 모델에 적용했으며, ELSDSR 데이터셋에서 화자 수가 증가하거나 발화 횟수가 적을 때도 MFC…

저자: Adrish Banerjee, Akash Dubey, Abhishek Menon

본 논문은 “Speaker Recognition using Deep Belief Networks”라는 제목으로, 화자 인식 분야에서 전통적으로 사용되어 온 멜 주파수 켑스트럼 계수(MFCC)와 달리, 딥 빌리프 네트워크(DBN)를 이용해 자동으로 학습된 단시간 스펙트럼 특징을 MFCC와 결합함으로써 인식 정확도를 향상시키는 방법을 제시한다.

1. **서론 및 배경**

화자 인식은 고차원 오디오 데이터를 어떻게 효과적으로 표현하고 구분할 것인가가 핵심 과제이다. 기존 시스템은 MFCC와 같은 도메인 특화 특징에 크게 의존해 왔으며, 이는 특징 설계에 많은 인적·시간적 비용이 들어간다. 저자들은 비지도 학습을 통해 스펙트럼 데이터를 직접 모델링하고, 이를 MFCC와 보완적으로 사용하면 화자 고유의 음성 기관 형태 정보를 더 잘 포착할 수 있다고 주장한다. 관련 연구로는 Ng et al., Schwarz et al., Lei et al. 등이 음성·화자 인식에 딥러닝을 적용한 사례를 들며, 특히 DBN이 음악 오디오 특징 학습에 성공했음을 언급한다.

2. **DBN 및 RBM 이론**

DBN은 여러 층의 제한 볼츠만 머신(RBM)으로 구성된 생성 모델이다. 각 RBM은 가시층과 은닉층 사이에 완전 연결을 가지며, 층 내부에는 연결이 없다는 제약을 갖는다. 에너지 함수와 확률 분포 정의, 대조 발산(Contrastive Divergence) 기반 학습 절차를 간략히 소개한다. 논문은 Hinton의 “fast learning algorithm for deep belief nets”을 기반으로, 사전 학습(pre‑training) 후 역전파(back‑propagation)로 지도 미세 조정(fine‑tuning)을 수행한다.

3. **DBN 기반 화자 특징 추출**

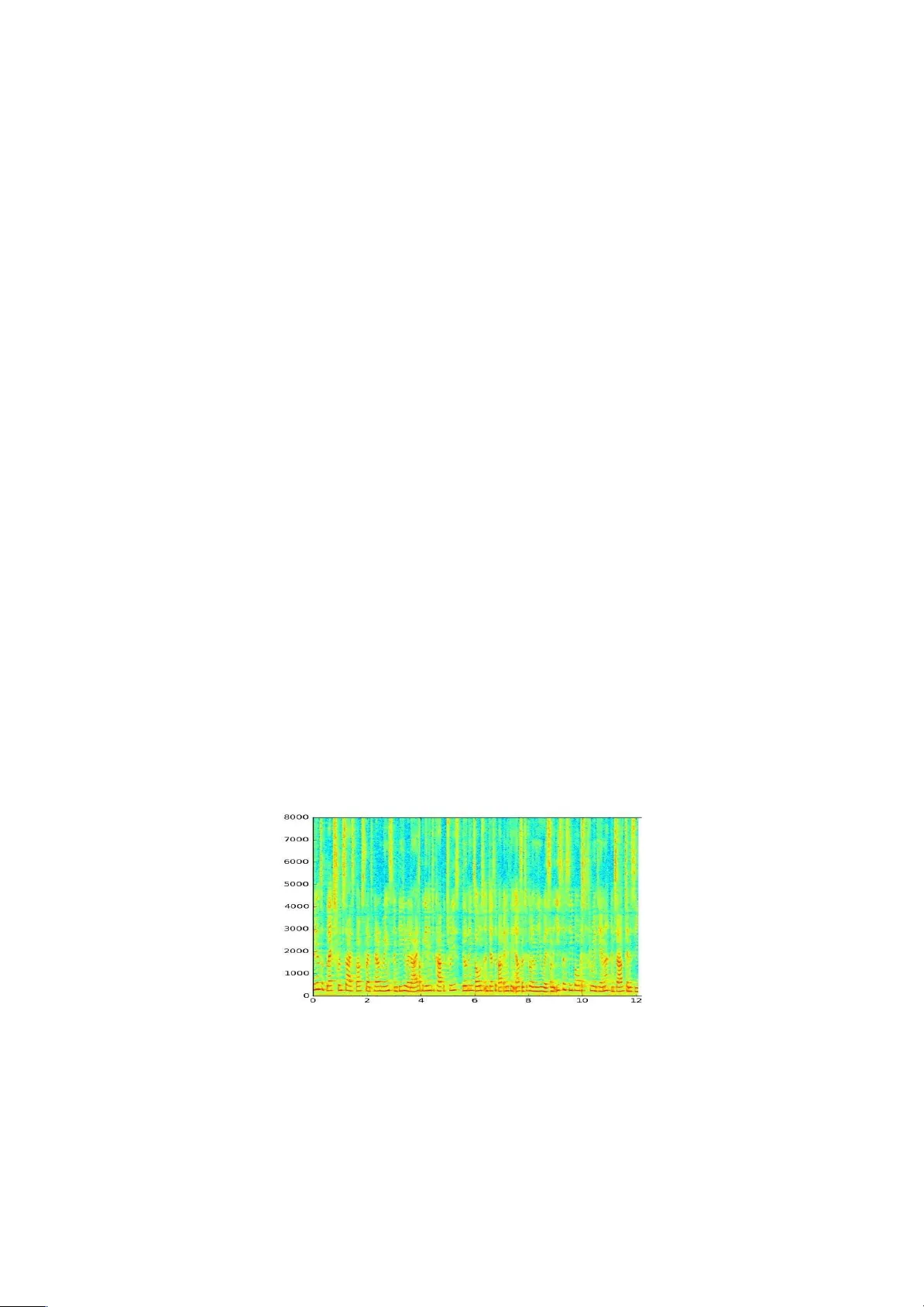

- **데이터 전처리**: 음성 신호를 25 ms 창, 10 ms 홉으로 프레임화하고 스펙트로그램을 얻는다. 각 프레임에 PCA 화이트닝을 적용해 128 차원으로 차원 축소한다.

- **네트워크 구조**: 입력(가시층) 128 유닛, 첫 번째 은닉층 200 유닛, 두 번째 은닉층 200 유닛으로 구성된 2‑층 DBN을 설계한다. 실수값 입력을 위해 가시층에 ReLU 활성화를 사용한다.

- **특징 추출**: 사전 학습 후 레이블이 있는 화자 데이터를 이용해 전체 네트워크를 미세 조정한다. 첫 번째와 두 번째 은닉층의 활성화 출력을 각각 L1, L2 특징이라 명명한다. 이 두 특징은 각각 200 차원의 벡터이며, 기존 MFCC(2~14번째 계수)와 결합한다. 최종 특징 벡터는 “MFCC + L1 + L2” 형태가 된다.

4. **GMM‑UBM 기반 화자 인식**

화자 인식에는 Gaussian Mixture Model‑Universal Background Model(GMM‑UBM) 프레임워크를 적용한다. 각 화자마다 64개의 가우시안 컴포넌트를 갖는 GMM을 학습하고, 전체 화자 데이터로부터 단일 UBM을 구축한다. 테스트 시 로그우도비(log‑likelihood ratio)를 계산해 화자 검증을 수행한다.

5. **실험 설계 및 결과**

- **데이터셋**: ELSDSR 데이터베이스를 사용하였다. 화자 수를 2명, 5명, 12명, 15명, 22명으로 변동시키며 실험을 진행했다.

- **특징 조합 별 성능**: MFCC 단독, MFCC+L1, MFCC+L2, MFCC+L1+L2 네 가지 조합을 비교하였다. 표 1에 따르면, 화자 수가 증가할수록 MFCC 단독은 정확도가 0.90 수준에 머무는 반면, MFCC+L1+L2는 0.95~0.99로 일관된 우위를 보였다.

- **발화 횟수에 따른 민감도**: 화자당 발화 횟수를 1, 2, 3개로 제한한 실험에서도 MFCC+L1+L2 조합은 0.85~0.92의 정확도를 기록, 라벨 데이터가 부족한 상황에서도 DBN 특징이 큰 보조 효과를 제공함을 확인했다.

- **시각화**: 정확도 vs. 화자 수, 정확도 vs. 발화 횟수 그래프를 제시해, 제안 방법이 전반적으로 우수함을 시각적으로 입증하였다.

6. **논의 및 한계**

- **장점**: 비지도 학습으로 대량의 라벨 없는 음성 데이터를 활용할 수 있어, 라벨 데이터가 제한된 환경에서도 성능 향상이 가능하다. DBN이 학습한 L1·L2 특징이 MFCC와 상보적인 정보를 제공한다는 점이 핵심이다.

- **제한점**: DBN 학습에 사용된 하이퍼파라미터(학습률, 배치 크기, CD‑k 등)가 상세히 기술되지 않아 재현성이 떨어진다. 또한, 특징 결합 방식을 단순 연결에 머물렀으며, 보다 정교한 융합 방법(예: attention, 차원 축소 후 결합 등)에 대한 탐색이 부족하다. 실험이 ELSDSR 데이터셋 하나에만 국한되어, 다른 언어·채널 조건에서의 일반화 가능성을 검증하지 않았다.

7. **결론 및 향후 연구**

저자들은 DBN이 단시간 스펙트럼 특징을 효과적으로 추출함을 입증했으며, 특히 라벨이 부족한 상황에서 MFCC와 결합했을 때 인식 정확도가 크게 향상된다고 결론짓는다. 향후 연구 방향으로는 (1) 하이퍼파라미터 자동 최적화, (2) 특징 융합을 위한 고도화된 메커니즘, (3) 다양한 잡음·채널 환경에서의 견고성 평가, (4) MFCC를 완전히 대체할 수 있는 완전 비지도 화자 모델링(예: 변분 오토인코더, 트랜스포머 기반) 등을 제시한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기