모바일 딥러닝을 활용한 카사바 잎병 진단 성능 평가

초록

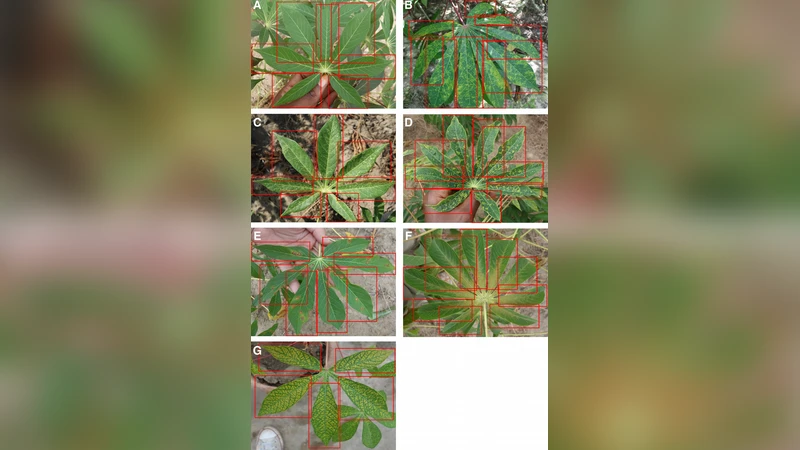

본 연구는 카사바 잎의 병증상을 실시간으로 감지하기 위해 CNN 기반 객체 탐지 모델을 학습하고, 이를 스마트폰 앱에 탑재하여 탄자니아 현장에서 촬영한 720장의 이미지와 영상에 대해 평가하였다. 경증·중증 두 단계의 증상을 구분했으며, 실제 환경에서 F1 점수가 최대 32% 감소하는 등 정밀도·재현율 조정의 필요성을 강조한다.

상세 분석

본 논문은 최근 컴퓨터 비전 분야에서 급격히 향상된 컨볼루션 신경망(CNN) 기술을 농업 현장, 특히 카사바(Manihot esculenta) 잎병 진단에 적용하는 실증 연구이다. 연구자는 먼저 공개된 연구용 데이터셋을 기반으로 객체 탐지 모델을 구축했으며, 여기서 사용된 아키텍처는 일반적인 YOLO 계열 혹은 Faster‑RCNN과 유사한 실시간 탐지에 최적화된 구조로 추정된다. 모델 학습 단계에서는 병증상(병든 잎)과 정상 잎을 각각 라벨링하고, 증상의 심각도에 따라 ‘경증(mild)’과 ‘중증(pronounced)’ 두 클래스를 추가로 정의하였다. 데이터 증강으로 조명 변화, 회전, 스케일 변형 등을 적용했음에도 불구하고, 연구용 데이터와 현장 데이터 사이의 도메인 격차가 크게 작용한다는 점을 확인한다.

모델을 모바일 앱에 배포한 뒤, 탄자니아 농경지에서 실제 농부들이 촬영한 720장의 정적 이미지와 연속 영상에 대해 정밀도(Precision), 재현율(Recall), F1‑Score를 측정하였다. 결과는 두 가지 주요 현상을 보여준다. 첫째, 동일한 ‘중증’ 증상이라도 현장 이미지에서는 학습 데이터와 가장 유사함에도 불구하고 재현율이 크게 감소해 F1‑Score가 32% 하락하였다. 이는 조명 불균형, 배경 잡음, 카메라 해상도 차이 등이 모델의 객체 후보 생성 단계에서 누락을 초래했음을 의미한다. 둘째, 영상 입력에서는 프레임 간 연속성 및 압축 아티팩트가 추가적인 오류 원인으로 작용해 정밀도는 유지되지만 재현율이 더욱 낮아지는 경향을 보였다.

이러한 결과는 모바일 환경에서 딥러닝 기반 병진단 시스템을 실용화하려면 단순히 높은 학술적 정확도에 머무르지 말고, ‘현장 적합성( field‑fit )’을 위한 정밀도·재현율의 균형 조정이 필수적임을 시사한다. 구체적으로는 (1) 현장 촬영 조건을 반영한 추가 데이터 수집 및 도메인 적응 기법(예: Fine‑tuning, Adversarial Domain Adaptation) 적용, (2) 모델 추론 시 임계값을 동적으로 조절해 재현율을 보강하고, (3) 영상 입력에 대해 시계열 기반 후처리(예: Temporal Smoothing) 도입이 필요하다. 또한, 모바일 디바이스의 연산·배터리 제한을 고려한 경량화 모델 설계와, 사용자 인터페이스(UI)에서 오탐지를 최소화하도록 피드백 루프를 구축하는 것이 장기적인 서비스 품질 향상에 기여할 것이다.

댓글 및 학술 토론

Loading comments...

의견 남기기