가중치 샘플링 기반 초소형 효율 신경망 WSNet

WSNet은 하나의 압축된 필터 집합에서 가중치를 샘플링함으로써 파라미터와 연산을 공유하는 새로운 신경망 설계 방식이다. 1차원 오디오 분류에 적용해 기존 모델 대비 100배 이상 작은 모델 크기와 최대 16배 빠른 연산을 달성하면서 정확도 저하를 거의 보이지 않는다.

저자: Xiaojie Jin, Yingzhen Yang, Ning Xu

본 논문은 딥 뉴럴 네트워크의 파라미터 과잉 문제와 연산 비용 문제를 동시에 해결하기 위한 새로운 설계 방식인 WSNet(Weight Sampling Network)을 제안한다. 기존의 모델 압축 기법은 완전 학습된 풀 파라미터를 사후에 프루닝, 필터 분해, 양자화 등으로 가공하는 접근법이 대부분이다. 이러한 방법은 압축 과정에서 성능 저하가 발생하거나, 압축 전후의 구조 차이 때문에 재학습이 필요하다는 한계가 있다. WSNet은 이러한 한계를 넘어, 학습 단계부터 파라미터를 공유하도록 설계한다. 구체적으로, 각 컨볼루션 레이어마다 하나의 “압축된 필터”(condensed filter) Φ를 학습하고, 실제 사용되는 N개의 필터 K는 Φ에서 공간적(stride‑based) 및 채널적(반복) 샘플링을 통해 생성한다.

공간 차원 샘플링에서는 Φ의 길이 L*를 L + (N‑1)·S 로 정의하고, stride S 만큼 이동하면서 N개의 필터를 추출한다. 이때 압축 비율은 대략 L/S 로 계산되며, 최소 S=1일 경우 최대 L배의 파라미터 절감이 가능하다. 채널 차원 샘플링에서는 Φ의 채널 수 M*를 1로 두고, C번 반복 샘플링하여 입력 채널 M = C·M* 를 맞춘다. 따라서 채널 차원에서의 압축 비율은 C가 된다. 이러한 두 차원의 샘플링을 결합하면 전체 파라미터 수는 LMN 대비 L*·M*·C 로 크게 감소한다.

학습 과정에서는 모든 K가 Φ에 매핑되므로, 역전파 시 Φ에 대한 그래디언트는 해당 Φ 원소에 연결된 모든 K에 대한 그래디언트의 합으로 계산된다. 이는 기존 딥러닝 프레임워크에서 자동 미분으로 손쉽게 구현 가능하다.

연산 효율성을 높이기 위해 WSNet은 “integral image” 기반의 연산 공유 기법을 도입한다. 입력 피처맵 F와 압축된 필터 Φ 사이의 모든 행‑열 내적을 행렬 P에 저장하고, 누적합 행렬 I를 계산한다. 이후任意 필터와 입력 패치의 컨볼루션 결과는 I의 사각 영역 합으로 O(1) 시간에 얻어진다. 또한 채널 차원에서는 입력을 C개의 그룹으로 나누어 합산함으로써 채널 수를 1/C 로 축소하고, 전체 연산량을 추가로 감소시킨다.

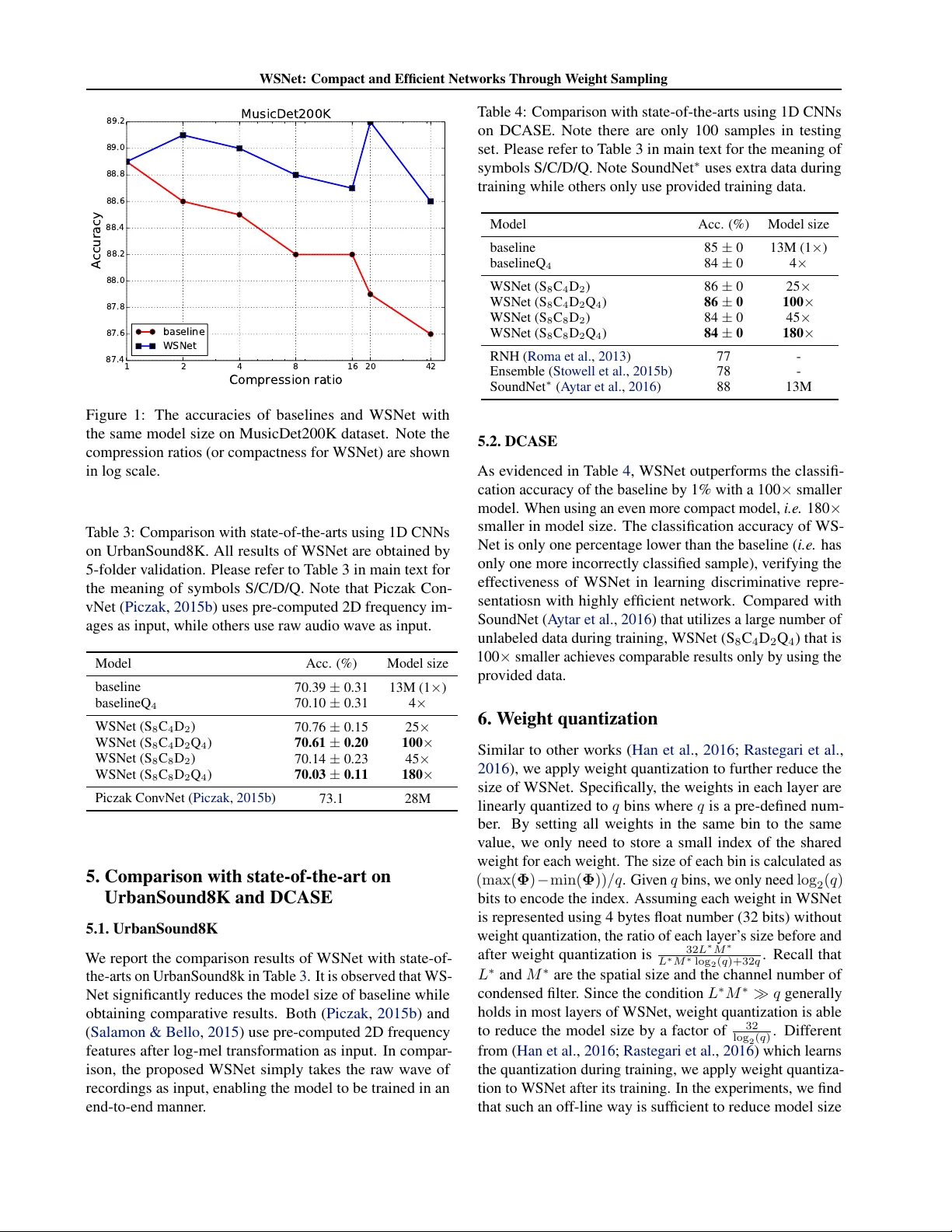

WSNet의 성능을 검증하기 위해 1D CNN 기반의 오디오 분류 작업에 적용하였다. ESC‑50, UrbanSound8K, DCASE, MusicDet200K 네 가지 데이터셋에서 기존 베이스라인(동일한 필터 수를 가진 일반 CNN) 대비 모델 크기를 100배~180배 축소했음에도 불구하고 정확도는 동일하거나 약간 향상되었다. 특히 180배 압축 시에도 정확도 저하가 거의 없었으며, 연산량은 최대 16배까지 감소하였다.

또한 WSNet은 “denser sampling” 기법을 통해 샘플링 stride를 더 작게 잡고, 1×1 컨볼루션을 이용해 차원을 복원함으로써 압축률과 성능 사이의 트레이드오프를 조절한다. 이 방법은 주로 필터 수가 적은 하위 레이어에 적용되어 전체 파라미터 증가를 최소화한다.

2D CNN에도 적용 가능함을 보이기 위해 MNIST와 CIFAR‑10 실험을 수행했으며, 압축된 2D WSNet 모델이 기존 경량 모델과 비슷한 정확도를 유지하면서 파라미터와 연산량을 크게 줄이는 것을 확인하였다.

종합적으로, WSNet은 파라미터 공유를 학습 단계부터 강제함으로써 모델 크기와 연산량을 동시에 크게 감소시키는 새로운 설계 패러다임을 제시한다. 기존 프루닝·양자화·분해 방식이 사후 처리에 의존하는 반면, WSNet은 구조 자체가 압축 친화적이므로 하드웨어 구현 시 메모리·전력 효율성을 크게 향상시킬 수 있다. 향후 연구에서는 다양한 네트워크 아키텍처와 하드웨어 가속기와의 연계, 그리고 자동화된 샘플링 stride·채널 비율 탐색을 통한 최적화가 기대된다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기