문맥 기반 간단 RNN으로 대화 행위 인식

초록

본 논문은 대화 행위(Dialgoue Act) 분류에 있어 발화 자체만을 이용하는 기존 방법의 한계를 지적하고, 앞선 발화들을 문맥으로 활용하는 간단한 순환 신경망(RNN) 모델을 제안한다. 발화를 문자 수준 언어 모델(mLSTM)로 인코딩한 뒤, 1~4개의 이전 발화를 입력으로 사용해 현재 발화의 대화 행위를 예측한다. 스위치보드 대화 행위 코퍼스(SwDA)에서 문맥을 포함했을 때 정확도가 73.96%에서 77.34%로 상승함을 보이며, 기존 최첨단 모델(73.9%)보다 우수한 성능을 입증한다.

상세 분석

이 연구는 대화 행위 인식이 발화의 의미와 화자 의도에 크게 의존하지만, 실제 대화에서는 이전 발화들의 흐름—즉, 대화의 문맥—이 중요한 단서가 된다는 점을 강조한다. 기존 연구들은 주로 단일 발화 수준에서 단어 n‑gram, HMM, CRF, 혹은 딥러닝 기반 CNN·RNN 등을 적용했으며, 문맥을 활용하려는 시도는 있었지만 대부분 전체 대화를 동시에 입력하거나 복잡한 구조를 사용해 실시간 시스템에 적용하기 어려웠다.

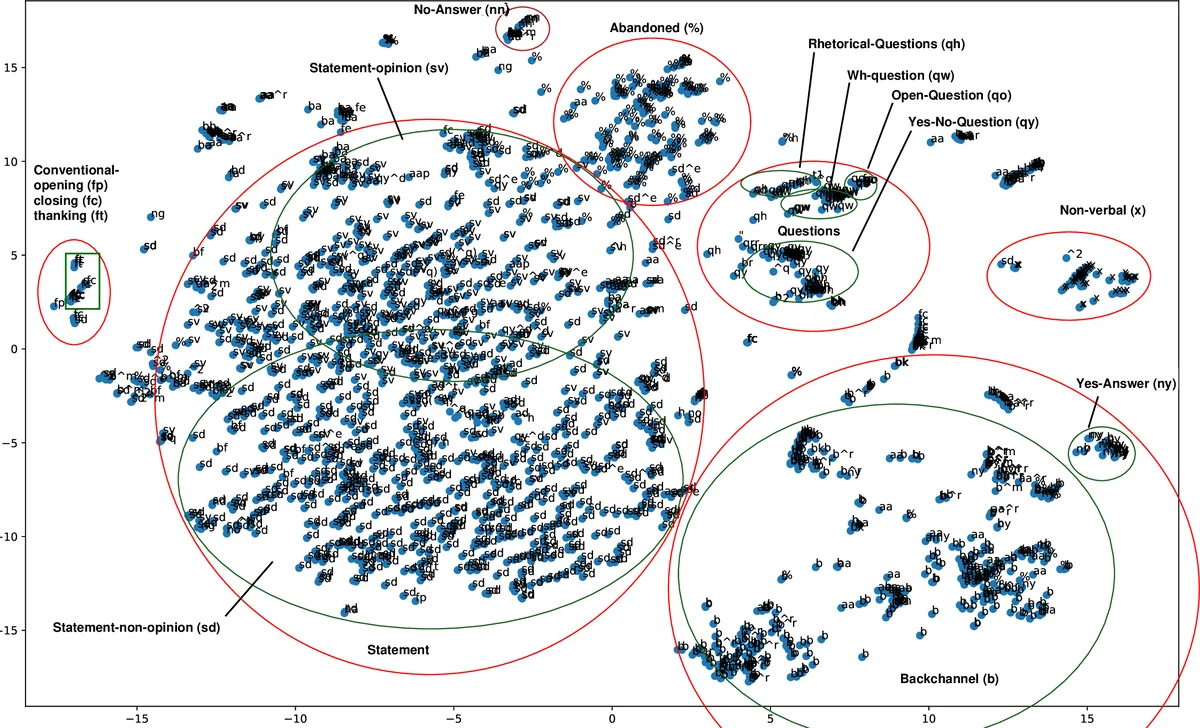

본 논문은 두 가지 핵심 기술을 결합한다. 첫째, 사전 학습된 문자‑레벨 언어 모델인 multiplicative LSTM(mLSTM)를 이용해 각 발화를 4,096 차원의 고차원 벡터로 변환한다. 문자 단위 인코딩은 어휘 외에도 구두점·대소문자·특수문자까지 포착해 짧은 발화에서도 풍부한 정보를 제공한다. 실험에서는 마지막 은닉 상태와 전체 문자 평균 벡터를 비교했으며, 평균 벡터가 대화 행위 구분에 더 유리함을 확인하고 이후 실험에 채택하였다.

둘째, 이러한 발화 벡터들을 순차적으로 입력받는 단순 Elman‑RNN을 설계한다. 현재 발화 s_t와 함께 s_{t‑1}, s_{t‑2} 등 최대 4개의 이전 발화를 입력으로 사용하며, 화자 정보를 원‑핫 형태(

댓글 및 학술 토론

Loading comments...

의견 남기기