딥러닝 기반 입술읽기에서 음소와 비셈의 성능 비교

본 논문은 대규모 연속 음성 데이터인 TCD‑TIMIT을 이용해 38개의 음소와 13개의 비셈(Viseme) 단위로 시각적 말 인식을 수행한다. 특징으로는 DCT와 Eigenlip을 사용하고, 모델은 하이브리드 DNN‑HMM 구조와 WFST 디코더를 적용하였다. 실험 결과, 음소 기반 시스템이 단어 정확도에서는 비셈보다 우수했지만, 단위 수준(음소/비셈) 정확도에서는 비셈이 더 높았다. 이는 사전(발음 사전)의 역할과 동형어(동음이의어) 문제의…

저자: Kwanchiva Thangthai, Helen L Bear, Richard Harvey

본 논문은 시각적 말 인식, 즉 입술 움직임을 통해 말을 인식하는 시스템에서 사용되는 기본 단위인 음소(phoneme)와 비셈(viseme)의 효율성을 비교한다. 전통적으로 음소는 소리의 최소 구분 단위로 정의되며, 비셈은 입술·턱·혀·치아 등 시각적 구강 움직임을 나타내는 최소 단위이다. 여러 연구가 비셈을 사용해 인식 성능을 높이려 했지만, 결과는 일관되지 않았다. 최근 딥러닝(DNN) 기반 모델이 GMM‑HMM을 대체하면서, 이러한 기본 단위 선택이 다시 평가될 필요가 있다.

데이터셋으로는 영국 켈틱 대학교에서 제공하는 TCD‑TIMIT 코퍼스를 사용했으며, 이는 59명의 화자, 약 6,000단어, 160,000개의 발음 사전 항목을 포함하는 대규모 연속 음성 데이터이다. 실험은 화자 종속(SD)과 화자 독립(SI) 두 시나리오로 나뉘어 진행되었다.

특징 추출 단계에서는 두 가지 저차원 이미지 표현을 사용했다. 첫 번째는 44차원 DCT(Discrete Cosine Transform)이며, 이는 이미지의 저주파 성분을 압축한다. 두 번째는 30차원 Eigenlip으로, 회색조 입술 이미지에 PCA를 적용해 주요 변동성을 포착한다. 추출된 원시 특징은 스피커 평균 제거, 15프레임 스플라이싱, LDA‑MLLT 변환, 그리고 fMLLR(Feature‑space Maximum Likelihood Linear Regression) 적응을 거쳐 40차원으로 정규화된다. 이러한 전처리 파이프라인은 Kaldi 툴킷을 기반으로 구현되었으며, 시각적 말 인식에서 흔히 사용되는 HiLDA 프레임워크와 유사하게 동작한다.

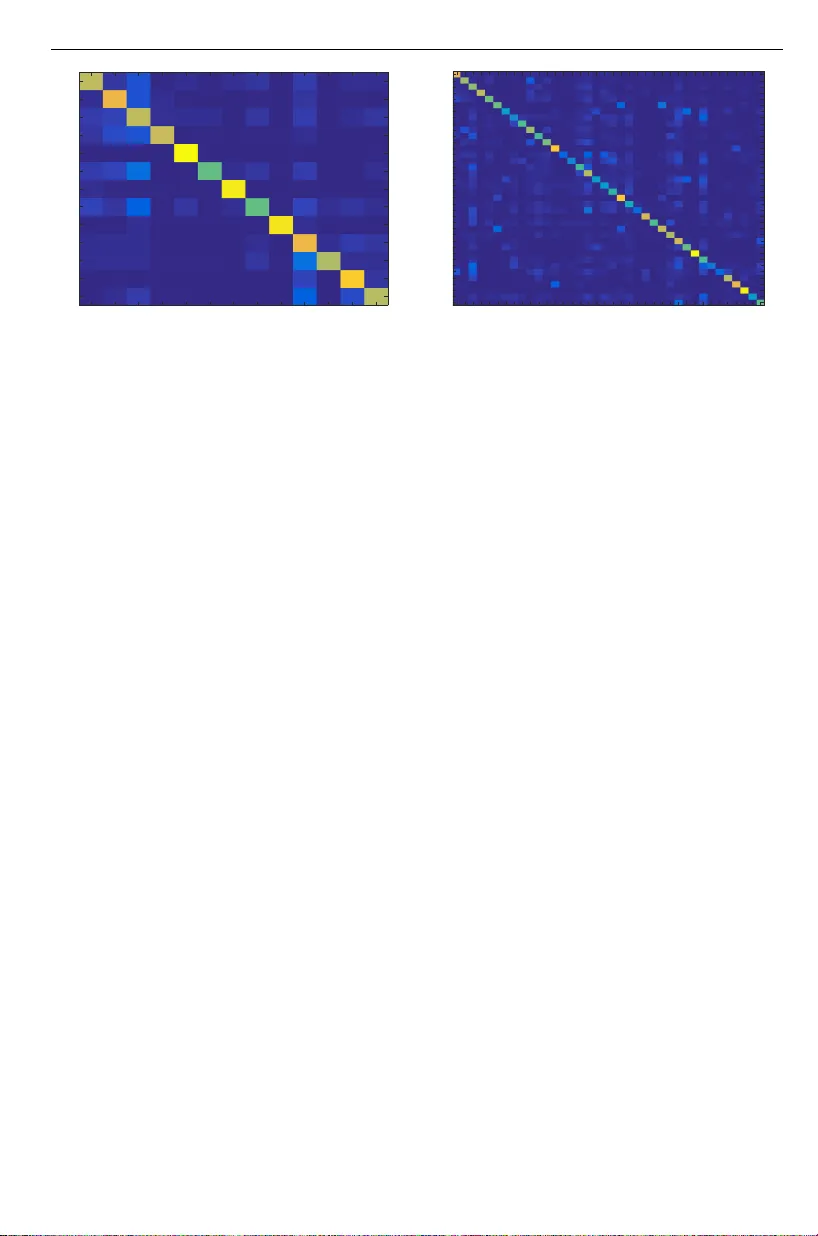

모델 학습은 단계적 접근법을 따른다. 처음에 CI‑GMM(음소/비셈 별 3‑state GMM‑HMM)으로 시간 정렬을 수행하고, 이후 CD‑GMM(문맥 의존 모델)으로 전이한다. CD‑GMM은 LDA‑MLLT 변환된 특징을 사용해 트리 클러스터링으로 상태를 묶으며, 최대 2,000개의 리프와 10,000개의 가우시안을 허용한다. 다음 단계에서는 SAT(Speaker Adaptive Training)를 적용해 fMLLR 변환을 도입하고, 최종적으로 CD‑DNN을 학습한다. CD‑DNN은 6개의 은닉층(각 2,048 뉴런)과 시그모이드 활성화 함수를 사용하며, 초기 가중치는 RBM(Restricted Boltzmann Machine) 사전학습으로 설정한다. 학습은 교차 엔트로피 최소화를 목표로 미니배치 SGD(배치 크기 256)와 드롭아웃(0.1)으로 진행된다.

디코딩은 Weighted Finite‑State Transducer(WFST) 기반으로 수행된다. 시각 모델, 발음 사전, 2‑gram 언어 모델을 결합해 전체 디코딩 그래프를 생성하고, Kaldi의 빔 프루닝(비터비 빔 13.0, 라티스 빔 8.0)과 모델 스케일(0.1)을 적용한다. 디코딩 후에는 라티스 재스코어링을 통해 최적의 단어 오류율(WER)을 얻는다.

발음 사전 분석에서는 음소에서 비셈으로 매핑할 때 동형어(동음이의어) 수가 급증함을 확인했다. 비셈은 13개의 클래스에 여러 음소가 겹쳐 매핑되므로, 사전 항목 수가 감소하고 동일 발음에 여러 단어가 매핑되는 경우가 늘어난다. 이는 비셈 기반 시스템의 단어 정확도를 낮추는 요인으로 작용한다.

실험 결과는 다음과 같다. 비셈 기반 시스템은 Eigenlip 특징을 사용할 때 SD에서 46.61% 비셈 정확도와 33.06% 단어 정확도를, SI에서 44.60%와 19.15%를 기록했다. DCT 특징은 각각 44.66%/14.37%와 42.48%/10.47%에 그쳤다. 반면, 음소 기반 시스템은 SD에서 48.74% 단어 정확도와 38.90% 음소 정확도를, SI에서 41.15%와 31.57%를 달성했다. 즉, 음소 모델이 단어 수준에서는 비셈보다 우수하지만, 단위 수준(음소/비셈)에서는 비셈이 더 높은 정확도를 보였다.

이러한 결과는 두 가지 중요한 시사점을 제공한다. 첫째, DNN‑HMM 하이브리드 구조가 기존 GMM‑HMM 대비 시각적 특징을 더 효과적으로 학습한다는 점이다. 특히, Eigenlip이 DCT보다 높은 성능을 보인 것은 저차원 이미지 표현에서도 PCA 기반 특징이 유용함을 입증한다. 둘째, 음소와 비셈 선택은 시스템 목표에 따라 달라져야 한다는 점이다. 단어 인식 정확도가 최우선이라면 음소 기반이, 단위 수준의 구분이 중요한 애플리케이션(예: 시각‑음성 동기화, 보조 의사소통)에서는 비셈이 더 적합할 수 있다.

마지막으로, 논문은 향후 연구 방향으로 더 정교한 비셈 정의(예: 동적 클러스터링 기반), 멀티모달 통합(음성+시각), 그리고 대규모 언어 모델(Transformer 기반)과의 결합을 제시한다. 이러한 확장은 현재 시스템이 직면한 동형어 문제와 단위 구분 한계를 극복하는 데 기여할 것으로 기대된다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기