데이터 기반 연속 피치 보정 모델 for 팝 보컬

초록

본 논문은 카라오케 환경에서 보컬과 반주가 별도 트랙으로 제공될 때, 두 트랙의 스펙트로그램을 입력으로 사용해 프레임 단위로 필요한 피치 보정 양(센트)을 연속적으로 예측하는 머신러닝 시스템을 제안한다. GRU 기반 RNN을 활용해 시간적 맥락을 고려함으로써 비브라토·글리산도와 같은 표현적 피치 변화를 보존한다. 실험 결과는 제한된 데이터셋에서 일정 수준의 보정이 가능함을 보였지만, 일반화 능력에는 한계가 있다.

상세 분석

이 연구는 기존 Auto‑Tune과 같은 이산적인 스케일 매핑 방식과 달리, 보컬과 반주의 조화로운 하모닉 관계를 직접 학습하여 연속적인 피치 보정을 수행한다는 점에서 혁신적이다. 입력으로 사용된 Constant‑Q Transform(CQT)은 로그‑스케일 주파수 해상도를 제공해 음악적 의미를 보존하면서도 8개의 빈도 bin/노트를 사용해 충분히 세밀한 피치 정보를 전달한다. 그러나 CQT의 해상도가 8 bin/노트에 머무르는 점은 미세한 피치 변동을 포착하는 데 한계가 있을 수 있다.

모델 아키텍처는 14개의 GRU 레이어와 32512 차원의 은닉 상태를 실험했으며, 최종 선택은 4‑layer, 128 차원 상태였다. GRU를 선택한 이유는 LSTM 대비 파라미터가 적고 학습이 빠르면서도 장기 의존성을 충분히 모델링할 수 있기 때문이다. 출력은 -11 범위의 선형값을 센트(−100+100)와 매핑했으며, MSE 손실을 최소화한다. 여기서 중요한 점은 출력 활성화에 선형 함수를 사용해 ‘정음’(zero‑shift) 상황에서 그래디언트가 소멸하지 않도록 설계한 것이다.

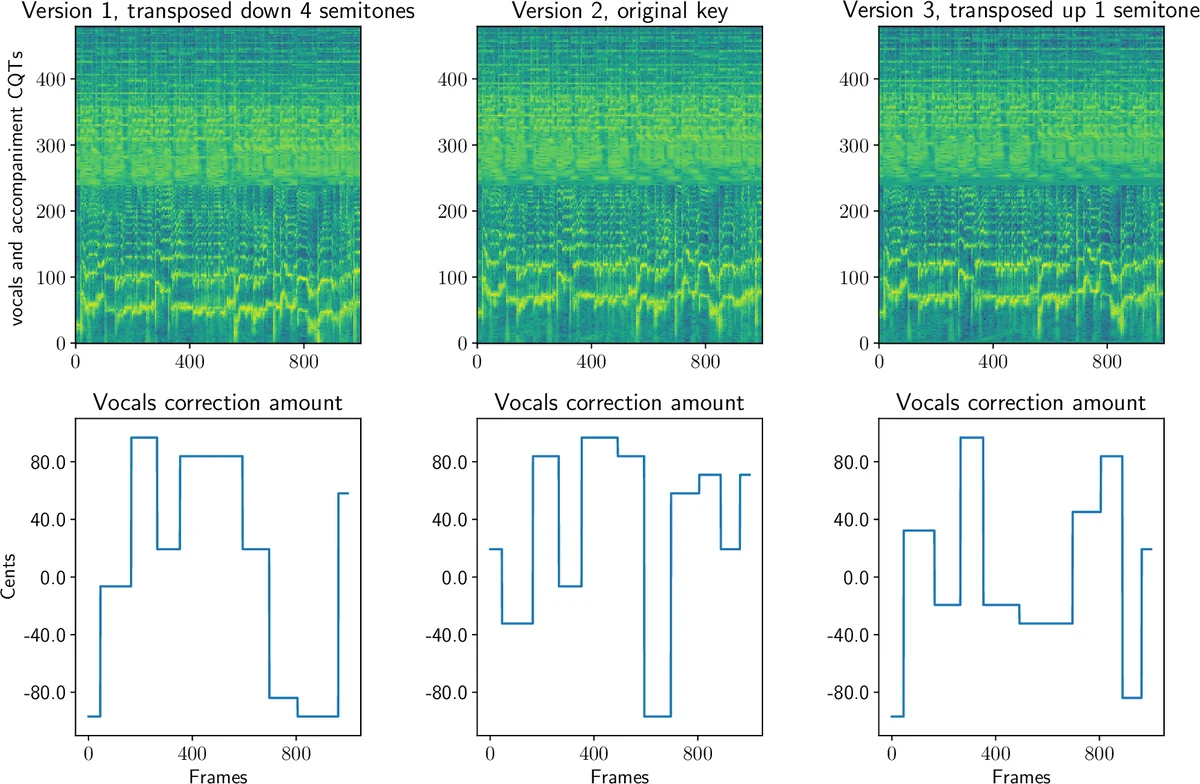

데이터 구축 과정은 SiSEC MUS 데이터셋의 100곡 중 66곡을 선별해 보컬이 단일 멜로디 라인을 갖는 경우만 추출하고, 전체 트랙을 16가지 피치 시프트(±100센트, 12.5센트 간격)로 변형해 학습 샘플을 생성한 점이다. 또한 전역 피치 시프트(±4 semitone)를 반주와 보컬에 동시에 적용해 데이터 증강을 수행했는데, 이는 모델이 다양한 조성·키에 대해 강인하게 학습되도록 돕는다. 하지만 ‘전역 시프트’가 실제 가수의 미세한 음정 오류와는 차이가 있어, 실제 현장 적용 시 오버피팅 위험이 존재한다.

실험 결과는 훈련 데이터에 대해서는 2‑layer 이상에서 손실이 감소했으나, 테스트 곡에 대해서는 손실 감소가 관찰되지 않았다. 이는 데이터 양이 약 25분에 불과하고 장르·보컬 스타일이 다양하게 섞여 있어 모델이 충분히 일반화되지 못했음을 의미한다. 또한 프레임당 43개의 샘플(≈1초당 43프레임)이라는 비교적 짧은 시퀀스 길이와 배치당 20프레임 오버랩 전략이 장기적인 멜로디 흐름을 포착하는 데 제한적일 수 있다.

한계점으로는 (1) 데이터 규모와 다양성 부족, (2) CQT 해상도와 프레임 길이 설정이 표현적 피치 변화를 충분히 포착하지 못함, (3) 출력이 피치 시프트 양만 제공하고 실제 오디오 재합성 파이프라인이 구현되지 않음 등을 들 수 있다. 향후 연구에서는 대규모 멀티트랙 데이터셋 구축, 더 높은 주파수 해상도의 스펙트로그램 사용, Transformer 기반의 장기 컨텍스트 모델링, 그리고 신경망 기반 직접 파형 변환(Neural Vocoder) 등을 결합해 실시간 자동 튜닝 시스템으로 확장할 가능성이 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기