딥 판별 분석을 이용한 i‑벡터 기반 강인한 화자 인식

본 논문은 i‑벡터 공간에서 화자 구분 능력을 향상시키기 위해, 소프트맥스 손실과 센터 손실을 동시에 최적화하는 심층 신경망 기반 보정 기법인 Deep Discriminant Analysis(DDA)를 제안한다. DDA는 기존 LDA와 달리 데이터에 가우시안 가정을 두지 않으며, 비선형 투영을 학습한다. 실험 결과, 짧은 발화 길이의 SRE 데이터셋에서 DDA가 LDA·PLDA 대비 EER을 4.96 %에서 4.69 %로 낮추는 등 유의미한 성…

저자: Shuai Wang, Zili Huang, Yanmin Qian

본 논문은 i‑벡터 기반 화자 인식 시스템에서 널리 사용되는 사후 처리 기법인 Linear Discriminant Analysis(LDA)의 한계를 극복하고, 보다 강인한 화자 구분을 구현하기 위해 Deep Discriminant Analysis(DDA)라는 새로운 신경망 기반 보정 방식을 제안한다.

1. **배경 및 문제점**

i‑벡터는 Joint Factor Analysis(JFA)를 단순화한 저차원 표현으로, 화자와 채널 변이를 하나의 공간에 통합한다. 이로 인해 채널·노이즈와 같은 불필요한 변이가 섞여 있어, 화자 구분 성능을 높이기 위해 LDA와 Probabilistic LDA(PLDA)와 같은 보정 기법이 필수적으로 적용된다. LDA는 클래스 간 평균 차이를 최대화하고 클래스 내 분산을 최소화하는 선형 변환을 제공하지만, (i) 가우시안 분포 가정, (ii) 소표본 크기 문제로 인한 공분산 행렬 특이성, (iii) 차원 축소가 클래스 수 C‑1 이하로 제한, (iv) 비선형 경계 표현력 부족 등 네 가지 근본적인 제약을 가지고 있다. 이러한 제약은 특히 짧은 발화 길이와 다양한 채널 조건이 결합된 실전 시나리오에서 성능 저하를 야기한다.

2. **제안 방법: Deep Discriminant Analysis**

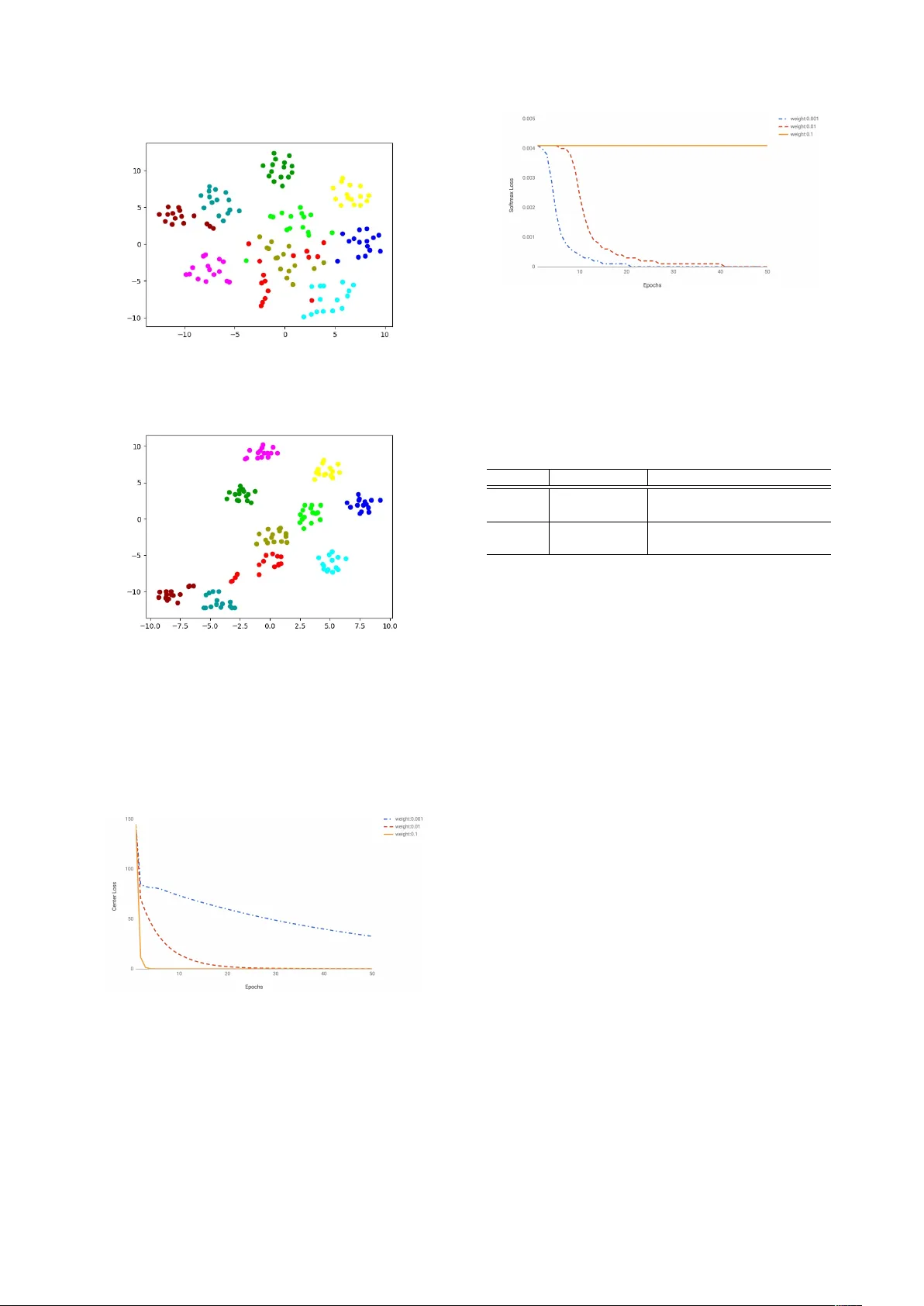

DDA는 i‑벡터를 입력으로 하는 심층 신경망을 설계하고, 두 가지 손실 함수를 동시에 최적화한다.

- **Softmax 손실**: 전통적인 다클래스 분류 손실로, 서로 다른 화자 클래스를 멀리 떨어뜨리도록 네트워크를 학습시킨다.

- **Center 손실**: 각 클래스의 중심을 학습 파라미터로 유지하고, 같은 클래스에 속하는 샘플들을 해당 중심에 가깝게 끌어당겨 클래스 내부 변동성을 감소시킨다. 두 손실을 λ = 0.01 비율로 결합(L = L_softmax + λ L_center)함으로써, LDA와 동일한 목표(클래스 간 거리 확대, 클래스 내 거리 축소)를 달성하면서도 비선형 변환을 통해 복잡한 데이터 구조를 모델링한다.

네트워크 구조는 입력층(600차원 i‑벡터) → 은닉층(600노드, PReLU 활성화) → 배치 정규화 → 임베딩층(300차원, 비선형 변환) → 손실층이다. 임베딩층 출력이 최종 보정된 i‑벡터 역할을 하며, 이후 기존의 Cosine, Euclidean, PLDA 등 다양한 스코어링 방법에 그대로 적용할 수 있다. 학습 시 센터 파라미터는 미니배치 단위로 평균을 구해 업데이트하고, 센터 손실에 대한 학습률을 일반 파라미터보다 10배 크게 설정해 빠른 수렴을 유도한다.

3. **실험 설정**

- **데이터**: NIST SRE 2010 기반의 짧은 발화(3–5 초) 텍스트 독립 테스트 셋. 훈련 데이터는 SRE 04‑08, Switchboard II Phase 2/3, Switchboard Cellular Part 1/2 등에서 추출한 4000명 화자, 각 화자당 40개의 짧은 발화로 구성.

- **베이스라인**: 600차원 i‑벡터(UBM 2048 가우시안, MFCC 20차원 + 1차·2차 미분) 추출 후, Cosine, Euclidean, PLDA 스코어링 적용. LDA(차원 300)와 결합한 경우 Cosine·Euclidean에서 성능 향상이 관찰되었으나, PLDA와 결합하면 개선이 없었다.

- **DDA 설정**: 동일 차원(300) 임베딩, PReLU와 배치 정규화 적용, 학습률 0.01(네트워크), 0.1(센터 손실), λ = 0.01.

4. **결과 및 분석**

- **성능**: DDA + Cosine에서 EER 4.73 %, DDA + Euclidean에서 EER 4.69 %를 기록, 이는 기존 PLDA(4.96 %)보다 약 0.27 %p 개선된 것이다. LDA + Cosine/Euc에서도 각각 4.80 %와 4.75 % 수준으로 DDA보다 뒤처졌다.

- **해석**: 비선형 변환을 통해 클래스 간 경계가 유연하게 조정되었으며, 센터 손실이 클래스 내부 변동성을 효과적으로 억제했다. 특히 짧은 발화와 다양한 채널 조건에서 LDA가 선형 제한으로 인해 충분히 구분하지 못했던 부분을 DDA가 보완한 것으로 판단된다.

- **장점**: (1) 가우시안 가정이 필요 없으며, (2) 차원 축소가 클래스 수에 제한되지 않는다, (3) 단일 신경망 학습으로 보정과 차원 축소를 동시에 수행해 구현 복잡도가 낮다, (4) 기존 스코어링 백엔드와 호환성이 뛰어나다.

5. **한계 및 향후 연구**

- 현재 실험은 2‑layer 얕은 네트워크에 국한되어 있어, 더 깊은 구조나 컨볼루션·어텐션 기반 모델이 성능을 추가로 향상시킬 가능성이 있다.

- 센터 손실의 λ와 학습률 등 하이퍼파라미터에 대한 민감도 분석이 부족하므로, 자동 튜닝 기법 적용이 필요하다.

- 다국어·다채널 대규모 데이터셋에서의 일반화 검증 및 실시간 인식 시스템에의 적용 가능성을 탐색해야 한다.

결론적으로, 본 논문은 i‑벡터 공간에서 LDA의 선형·가우시안 제약을 넘어서는 비선형 보정 기법인 Deep Discriminant Analysis를 제안하고, 짧은 발화 조건에서도 기존 방법들을 능가하는 성능 향상을 입증하였다. 이는 향후 화자 인식 시스템에서 데이터 기반 비선형 보정이 표준화될 가능성을 시사한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기