LSTM의 블랙박스를 해부하다: 문맥 분해로 단어 상호작용 추출하기

초록

본 논문은 LSTM의 예측을 해석하기 위한 새로운 알고리즘인 ‘문맥 분해(Contextual Decomposition, CD)‘를 제안합니다. CD는 LSTM의 내부 게이트 구조를 활용하여 특정 단어나 구문이 최종 예측에 기여하는 방식을 정량적으로 분해합니다. 감성 분석 태스크에서 CD는 상반된 감성을 가진 단어/구문을 신뢰성 있게 식별하고, 이들이 어떻게 결합되어 LSTM의 최종 판단을 이루는지 보여주며, 부정어를 성공적으로 추출하는 등 기존 방법이 못한 상호작용 분석을 가능하게 합니다.

상세 분석

이 논문의 핵심 기술적 기여는 LSTM의 게이트 메커니즘을 해석 가능한 구성 요소로 분해하는 ‘문맥 분해(Contextual Decomposition, CD)’ 알고리즘입니다. CD의 핵심 아이디어는 LSTM의 셀 상태(c_t)와 은닉 상태(h_t)를 특정 대상 구문(예: 분석 중인 단어나 문장 내 구)에만 기인한 기여(β)와, 대상 구문 외의 다른 요소(문맥)와의 상호작용에 기인한 기여(γ)의 합으로 재구성하는 것입니다 (h_t = β_t + γ_t, c_t = β_c_t + γ_c_t).

이 분해를 가능하게 하는 것은 LSTM의 고유한 구조, 특히 입력 게이트(i_t), 망각 게이트(f_t), 출력 게이트(o_t), 그리고 후보 셀 상태(g_t) 간의 요소별 곱(element-wise product) 연산입니다. CD는 이러한 게이트와 상태 업데이트 함수(시그모이드, tanh)를 선형화(L_σ, L_tanh)하여, 게이트 간의 상호작용을 구성 요소별로 추적합니다. 예를 들어, 입력 게이트와 후보 셀 상태의 곱(i_t ⊙ g_t)을 확장하면, β 성분(대상 구문만 관련)과 γ 성분(외부 문맥과의 상호작용 관련) 간의 교차항이 자연스럽게 나타나며, 이를 재귀적으로 할당합니다.

CD의 중요한 강점은 단순한 ‘단어 중요도 점수’를 넘어, 단어들이 ‘어떻게’ 결합되어 예측에 영향을 미치는지(즉, 구성성, compositionality)를 포착한다는 점입니다. 이는 감성 분석에서 “not good"과 같은 부정어 처리에 명확히 드러납니다. 기존 중요도 기반 방법(예: 그래디언트, 통합 그래디언트, 셀 분해)은 “not"과 “good” 각각에 개별적인 점수를 부여할 뿐, 두 단어의 결합으로 인한 의미 반전을 설명하지 못합니다. 반면 CD는 “not good"이라는 구 전체에 대한 β 점수를 계산함으로써, LSTM이 이 구를 하나의 부정적 단위로 처리했음을 보여줄 수 있습니다.

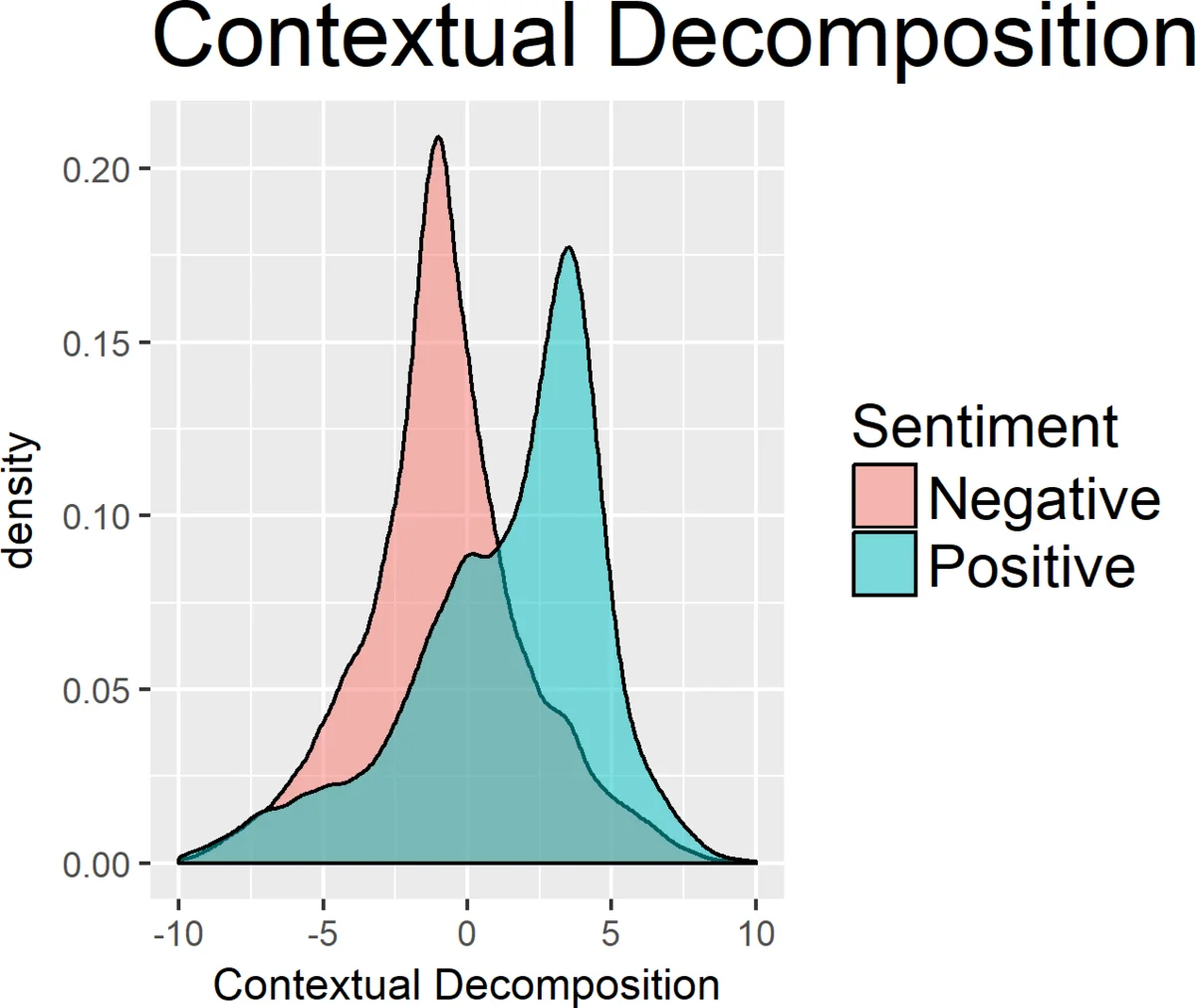

실험 결과(Yelp, SST 데이터셋)는 CD가 기존 방법(통합 그래디언트, 리브-원-아웃 등)에 비해 단어 수준 중요도 평가에서도 우수한 성능을 보이며, 특히 문맥에 민감한 단어(문서 전체 감성과 반대되는 강한 감성어)의 기여를 더 정확하게 평가함을 입증했습니다. 또한 SST의 구문 수준 라벨을 이용한 평가에서 CD는 LSTM 내부의 긍정/부정 부정어를 성공적으로 추출했는데, 이는 CD가 모델의 비선형적 추론 과정을 해부하는 데 효과적임을 강력히 시사합니다.

댓글 및 학술 토론

Loading comments...

의견 남기기