유방암 조직 이미지 분류를 위한 합성곱 캡슐 네트워크

초록

본 논문은 혈색소‑에오신 염색된 유방 조직 생검 이미지를 네 가지 병리학적 클래스(정상, 점액성, 관상피, 인시네)로 구분하기 위해 합성곱 캡슐 네트워크(CapsNet)를 적용한 연구이다. 4‑fold 교차검증에서 평균 정확도 0.87, 민감도도 유사한 수준을 달성했으며, 기존 CNN 기반 방법보다 파라미터 효율성과 위치‑관계 보존 측면에서 장점을 보였다.

상세 분석

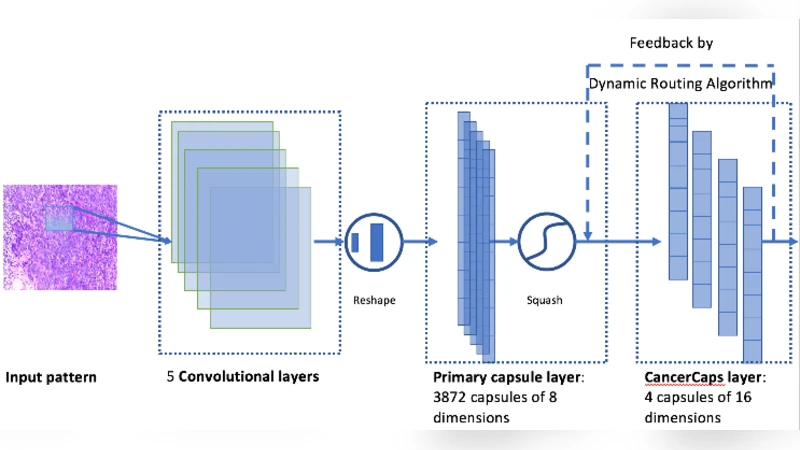

본 연구는 전통적인 합성곱 신경망(CNN)이 이미지 내 객체의 위치와 자세 정보를 손실시키는 한계를 보완하기 위해 캡슐 네트워크를 도입하였다. 캡슐은 벡터 형태의 활성화를 사용해 각 객체의 존재 확률과 변환 매개변수를 동시에 인코딩한다는 점에서 기존 스칼라 뉴런과 근본적으로 차별화된다. 논문에서는 기본적인 Conv‑Capsule 구조를 채택했으며, 초기 레이어에서 5×5 커널, 64개의 필터를 사용해 저수준 특징을 추출한 뒤, PrimaryCapsule 레이어에서 8‑차원 캡슐을 32개 생성한다. 이어지는 DigitCapsule 레이어는 4개의 클래스에 대응하는 16‑차원 캡슐을 형성하고, 동적 라우팅(dynamic routing) 알고리즘을 3번 반복 적용해 캡슐 간 가중치를 최적화한다. 손실 함수는 마진 손실(margin loss)과 재구성 손실을 가중합한 형태로, 클래스 구분 성능과 입력 이미지 재구성을 동시에 촉진한다.

데이터셋은 공개된 BACH(Breast Cancer Histology) 데이터베이스의 400장 이미지를 사용했으며, 각 이미지는 4개의 클래스로 라벨링되어 있다. 원본 이미지 해상도는 2048×1536이지만, 메모리 제약과 학습 효율성을 위해 224×224로 리사이즈하고, 색상 정규화와 랜덤 회전·수평 뒤집기 등 데이터 증강을 적용하였다. 4‑fold 교차검증을 통해 모델의 일반화 능력을 평가했으며, 평균 정확도 0.87은 기존 ResNet‑34 기반 모델(≈0.81)보다 유의미하게 향상된 결과다. 또한 클래스별 민감도는 0.84~0.89 범위에 머물러, 특히 악성 종양(관상피, 인시네) 구분에서 높은 재현율을 보였다.

하지만 캡슐 네트워크는 라우팅 연산이 복잡해 학습 시간이 CNN 대비 약 1.5배 길어지는 단점이 있다. 또한 데이터셋 규모가 작아 과적합 위험이 존재하며, 재구성 손실이 이미지 품질에 크게 의존하기 때문에 색상 변동이 큰 조직학 이미지에선 성능 저하가 관찰될 수 있다. 향후 연구에서는 라우팅 횟수를 동적으로 조절하거나, EfficientCaps와 같은 경량화 기법을 도입해 연산 효율성을 개선하고, 대규모 멀티센터 데이터와 멀티스케일 입력을 결합해 모델의 견고성을 높이는 방안을 모색할 필요가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기