질문응답 전이학습의 감독·비감독 접근법과 실험적 검증

초록

본 논문은 대규모 영화 QA 데이터(MovieQA)를 출발점으로, TOEFL 청취 이해 테스트와 MCTest와 같은 소규모 목표 데이터셋에 대한 전이학습을 수행한다. 두 가지 기존 QA 모델(MemN2N, QA CNN)을 사용해 감독 전이와 비감독 전이를 비교했으며, 감독 전이에서는 정확도가 평균 7%p 상승하고, 비감독 전이에서도 의미 있는 성능 향상이 관찰되었다.

상세 분석

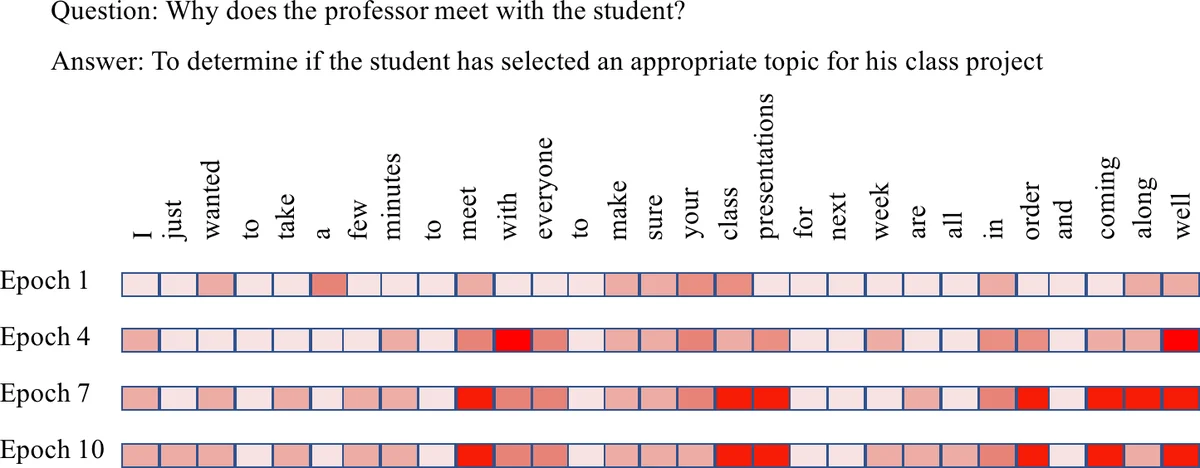

이 연구는 질문응답(QA) 분야에서 전이학습의 실효성을 체계적으로 검증한 최초 사례 중 하나로 평가할 수 있다. 먼저, 저자들은 멀티플 초이스 QA(MCQA)라는 구체적 설정을 선택했으며, 이는 스토리, 질문, 그리고 여러 선택지를 입력으로 받아 정답을 선택하는 전형적인 형태이다. 전이학습 절차는 두 단계로 단순화된다. ① 대규모 소스 데이터(MovieQA)에서 모델을 사전학습(pre‑train)하고, ② 목표 데이터(TOEFL‑manual, TOEFL‑ASR, MC160, MC500)에서 미세조정(fine‑tune)한다. 감독 전이에서는 두 단계 모두 정답 라벨을 사용해 지도학습을 진행한다. 비감독 전이에서는 목표 데이터에 라벨이 없으므로, 사전학습된 모델이 예측한 답을 임시 라벨로 사용해 자체 라벨링(self‑labeling) 후 미세조정을 수행한다. 이 과정은 알고리즘 1에 명시된 대로 반복 학습(epoch) 동안 수행된다.

두 모델은 각각 메모리 네트워크(MemN2N)와 쿼리 기반 어텐션 CNN(QA CNN)이다. MemN2N은 질문과 스토리 문장을 임베딩한 뒤 어텐션 메커니즘을 통해 가중합을 구하고, 선택지 임베딩과의 유사도로 정답을 결정한다. QA CNN은 스토리‑질문, 스토리‑선택지 유사도 맵을 생성하고, 두 단계의 CNN과 쿼리 기반 어텐션을 적용해 문장‑레벨, 단어‑레벨의 중요도를 학습한다. 특히 QA CNN은 파라미터가 많아 전이학습 효과를 정밀히 분석할 수 있는 좋은 대상이 된다.

실험 결과는 표 2에 요약된다. 감독 전이에서 QA CNN은 소스‑전용 모델(51.2%~68.1%)보다 목표‑전용 모델(48.9%~57.5%)보다 높은 정확도를 보였으며, 소스+목표 학습 및 전체 파라미터 미세조정을 거치면 최고 56.1% (TOEFL‑manual)까지 상승한다. MemN2N도 비슷한 추세를 보였지만, 전체 파라미터를 미세조정했을 때의 향상이 상대적으로 작았다. 특히 MCTest의 MC500에서 QA CNN은 72.3%까지 도달해 기존 최고 성능(71.0%~75.3%)을 능가한다. 비감독 전이 실험에서는 라벨이 없는 목표 데이터에 대해 자체 라벨링을 적용했음에도 불구하고, 성능 저하가 최소화되었으며, 특히 데이터가 극히 제한된 상황에서 전이학습이 큰 이점을 제공한다는 점을 확인했다.

이 논문이 제공하는 주요 통찰은 다음과 같다. 첫째, QA 분야에서도 대규모 텍스트 기반 소스 데이터만으로도 충분히 일반화 가능한 표현을 학습할 수 있다. 둘째, 감독 전이와 비감독 전이 모두 목표 데이터의 규모가 작을 때 모델 성능을 크게 끌어올린다. 셋째, 복잡한 구조를 가진 QA CNN은 파라미터 일부만 고정하고 나머지를 미세조정함으로써 전이 효율을 조절할 수 있음을 보여준다. 마지막으로, 비감독 전이에서의 자체 라벨링은 간단하지만 효과적인 전략으로, 라벨링 비용이 높은 실제 응용에서 활용 가능성을 시사한다. 다만, 현재 실험은 영화 스토리와 교육용 청취 자료라는 두 도메인에 국한되었으며, 다른 장르(예: 의료, 법률)로의 확장 가능성은 추가 연구가 필요하다. 또한, 비감독 전이 시 라벨 노이즈가 성능에 미치는 영향을 정량화하는 작업도 향후 과제로 남는다.

댓글 및 학술 토론

Loading comments...

의견 남기기