상업용 노래 오디오에서 가사 전사 초기 연구와 향후 과제

본 논문은 상업용 노래의 보컬만을 추출한 데이터셋을 구축하고, 다양한 음향 모델과 언어 모델을 적용해 가사 자동 전사 성능을 평가한다. TDNN‑LSTM에 3배속 변형 데이터 증강을 적용한 결과, 기존 베이스라인 대비 WER를 96.21%에서 73.90%로 크게 낮추었지만 여전히 높은 오류율을 보인다.

저자: Che-Ping Tsai, Yi-Lin Tuan, Lin-shan Lee

본 논문은 상업용 노래 오디오에서 가사를 자동으로 전사하는 최초의 시도 중 하나로, 기존 음성 인식 기술을 노래에 적용했을 때 발생하는 여러 문제점을 체계적으로 분석하고 해결 방안을 제시한다.

1. **배경 및 필요성**

디지털 미디어의 급증으로 음성 기반 검색·요약·이해 기술이 활발히 연구되고 있지만, 노래와 같은 가창 콘텐츠는 여전히 소외되어 있다. 노래는 인간의 목소리라는 점에서 의미 정보를 담고 있으나, 자유로운 리듬, 넓은 피치 범위, 길어지는 모음, 화음·배경음악 등으로 인해 전통적인 ASR 시스템이 크게 실패한다.

2. **데이터 구축**

저자들은 유튜브에서 “music‑removed” 형태로 제공되는 130곡(약 5시간)의 영어 보컬을 수집하였다. 이 데이터는 원본 음악이 제거된 것이지만, 화음, 스캣, 잔잔한 배경음 등 실제 상업 음원의 복합성을 그대로 포함한다. 곡당 10~35초 길이의 프래그먼트로 나누어 640개의 학습 프래그먼트와 97개의 테스트 프래그먼트를 구성했으며, 가수는 남성 15명, 여성 28명, 그룹 19개로 다양하게 분포한다. 장르는 팝, 전자, 록, 힙합, R&B/소울 등 5가지로 라벨링하였다.

3. **언어 모델**

두 종류의 3‑gram LM을 사용했다. 첫 번째는 LibriSpeech(803M 단어) 기반이며, 두 번째는 가사 전용 코퍼스(574k 곡, 129.8M 단어)에서 구축하였다. 가사 LM은 퍼플렉시티가 123.92로 크게 낮고 OOV 비율도 0.55%에 불과해, 노래 특유의 어휘와 구문을 더 잘 반영한다는 점에서 우수하였다.

4. **음향 모델링 및 적응**

- **GMM‑HMM 기반**: 기본 SAT 트라이폰 모델을 사용해 정렬(a) 후, fMLLR을 장르, 가수, 곡, 프래그먼트 수준에서 적용하였다. 프래그먼트 수준 적응이 가장 큰 개선을 보였으며, 최종 GMM‑HMM 모델(E‑4)은 WER 77.08%를 기록했다.

- **딥러닝 기반**: DNN, BLSTM, TDNN‑LSTM을 각각 실험하였다. 데이터 증강으로 0.9·1.0·1.1 배속(3‑fold)과 0.9·0.95·1.05·1.1 배속(5‑fold) 변형을 적용했으며, 특히 TDNN‑LSTM(3‑fold) 모델이 73.90% WER와 64.33% PER로 최우수 성능을 달성했다. 이는 시간‑채널 컨볼루션과 LSTM의 장기 의존성 학습이 가창의 급격한 피치 변동과 길어지는 모음에 효과적임을 보여준다.

5. **특수 처리: 연장 모음**

가사에 자주 등장하는 길어지는 모음 문제를 해결하기 위해 두 가지 방법을 적용하였다. (1) 모음이 2번까지 반복될 수 있도록 사전을 확장(단어당 최대 2^n 발음)하고, (2) 모음 HMM의 self‑loop 전이 확률을 0.9배 감소시켜 연장된 모음에 대한 관용성을 높였다. 각각 약 3.3%와 0.5%의 추가 WER 감소 효과를 보였다.

6. **실험 결과 요약**

- Baseline (LibriSpeech LM + SAT 트라이폰) WER 96.21%

- GMM‑HMM 프래그먼트 적응 + 가사 LM → 80.40%

- 확장 사전 적용 → 77.08%

- TDNN‑LSTM(3‑fold) + 가사 LM + 확장 사전 + self‑loop 조정 → 73.90% (최고)

전체적으로 모든 개선을 적용해도 WER가 70%대를 벗어나지 못해, 노래 전사 작업이 여전히 어려운 과제임을 확인한다.

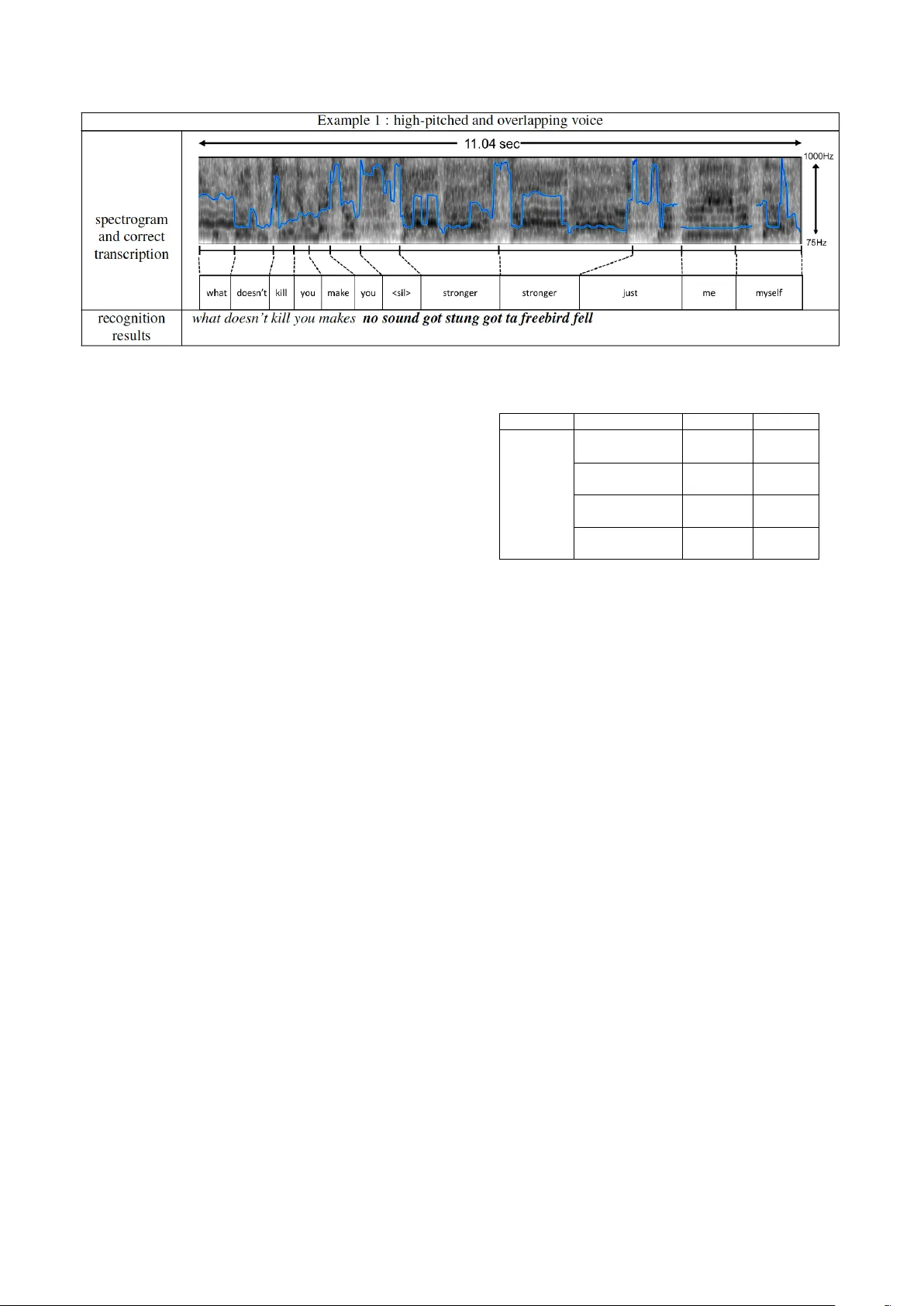

7. **오류 분석**

높은 피치, 급격한 피치 변동, 겹치는 구절(다중 보컬), 잔류 배경음악 등이 주요 오류 원인으로 지목되었다. 특히 고음 구간에서 모델이 급격히 인식 오류를 일으키는 현상이 관찰되었다.

8. **결론 및 향후 과제**

본 연구는 상업용 노래의 보컬만을 대상으로 한 최초 규모의 데이터셋을 공개하고, 다양한 음향·언어 모델링 기법을 적용해 현재 가능한 최선의 성능을 제시한다. 그러나 70%대 WER는 실용적인 수준에 크게 못 미치므로, 대규모 멀티모달 데이터(음악+가사), 고정밀 피치 추정, 그리고 가사와 멜로디를 동시에 모델링하는 통합 접근법이 필요하다. 또한, 데이터 증강을 넘어 실제 다양한 장르·문화권의 노래를 포괄하는 데이터베이스 구축이 향후 연구의 핵심 과제로 남는다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기