리만 기하학 기반 게임 동역학

초록

본 논문은 인구 집단이 상태 사이를 이동할 때 겪는 ‘운동 비용’을 리만 계량으로 모델링하고, 이 비용과 게임으로부터 얻는 이득을 균형시켜 정의되는 일반화된 진화 게임 동역학을 제안한다. 복제자 동역학과 유클리드 투사 동역학을 특수 사례로 포함하며, 양자는 각각 연속형·불연속형 리만 동역학의 전형이다. 또한 메트릭이 해시안(헤시안) 형태일 때는 Bregman 발산을 라야푸노프 함수로 활용해 수렴성과 안정성을 강력히 보장한다. 마지막으로 이러한 동역학이 강화학습과 깊은 연관을 가지며, 기존 결과를 크게 일반화함을 보여준다.

상세 분석

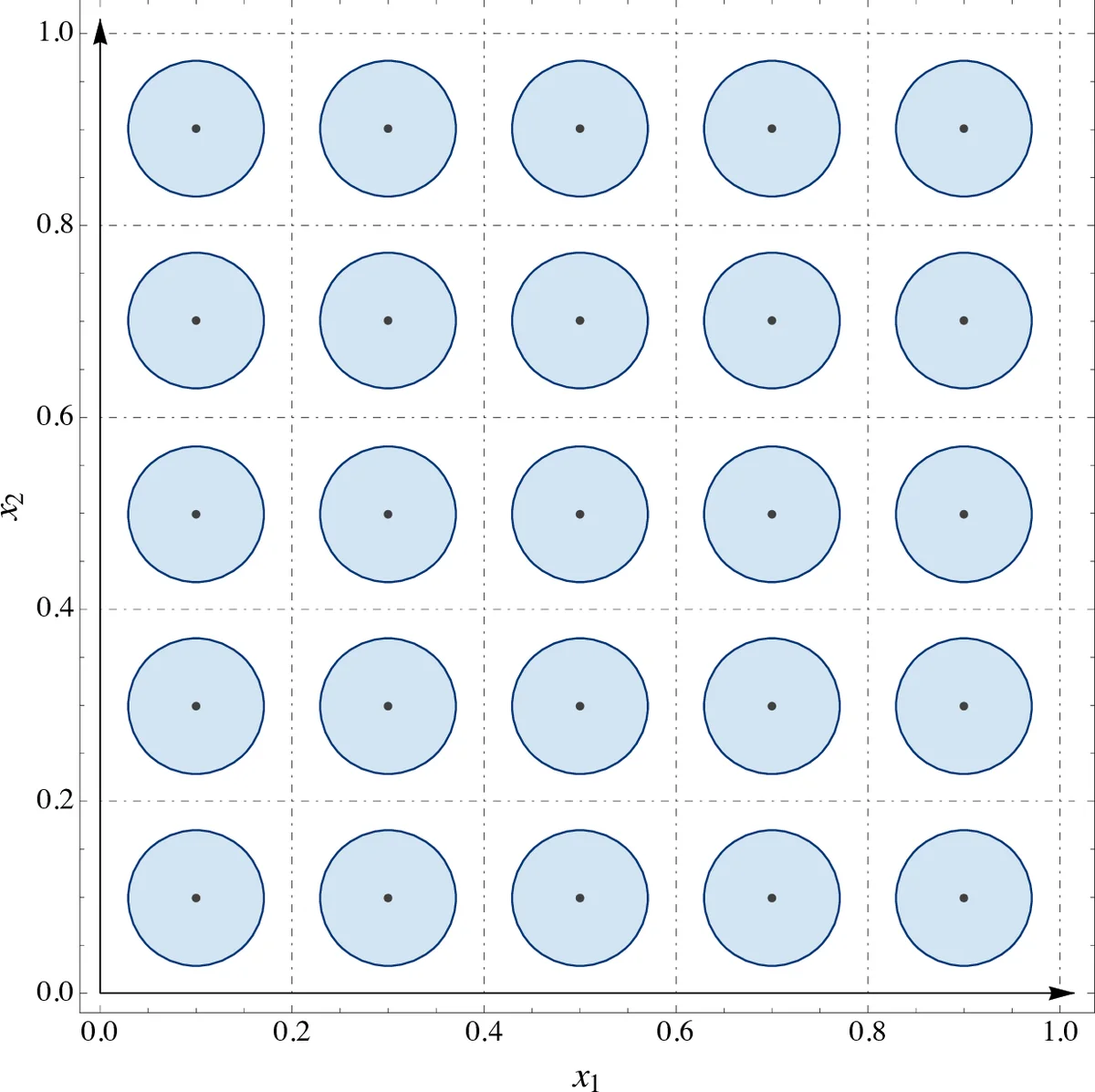

이 논문은 진화 게임 이론에서 “전략의 변화가 현재의 보상에만 의존한다”는 전통적 가정을 넘어, 전략 변화를 수행하는 데 드는 물리적·인지적 비용을 상태‑의존적인 내적(리만 계량)으로 정량화한다는 혁신적인 접근을 제시한다. 저자는 두 가지 힘, 즉 (1) 전략이 얻는 즉시 이득(게임의 페이오프와 변동률의 내적)과 (2) 변화를 수행하는 데 필요한 비용(리만 메트릭에 의해 정의된 거리)의 차이를 최대화하는 최적화 문제를 설정하고, 그 해를 동역학식으로 도출한다. 이 일반화된 프레임워크는 기존의 복제자 동역학(RD)을 샤시하니 메트릭(각 전략 비율에 역비례하는 비용)으로, 그리고 유클리드 투사 동역학(PD)을 표준 유클리드 메트릭으로 각각 특수화한다.

두 메트릭은 경계 행동에서 뚜렷한 차이를 만든다. 샤시하니 메트릭은 경계에서 비용이 무한히 커지므로, 전략이 사라지면 다시 복구되지 않아 지원 집합이 보존되고, 연속적인 흐름을 유지한다. 반면 유클리드 메트릭은 경계에서 비용이 유한하므로 지원이 빈번히 변하고, 불연속적인 움직임이 발생한다. 이러한 차이는 “연속형 리만 동역학”과 “불연속형 리만 동역학”이라는 두 범주로 논문을 구조화하는 핵심이다.

또한 메트릭이 헤시안(즉, 어떤 볼록 함수의 Hessian) 형태일 때, 즉 ‘Hessian 게임 동역학’이라 부르는 경우, Bregman 발산을 라야푸노프 함수로 사용할 수 있다. 이 발산은 현재 상태와 목표 상태 사이의 비대칭 거리로, 메트릭에 자연스럽게 연결된다. 이를 통해 저자는 (i) 잠재 게임(potential games)에서 전역 수렴, (ii) 강수축 게임(contractive games)에서 전역 안정성, (iii) 엄격하게 우세한 전략의 소멸, (iv) 내부 궤적의 시간 평균이 Nash 균형 집합에 수렴한다는 일련의 정리를 증명한다. 특히, 잠재 게임에서는 Kimura의 최대 원리와 직접적인 일반화를 제시해, 메트릭에 따라 가장 가파른 잠재 함수 상승 방향으로 움직인다는 직관을 제공한다.

마지막으로, 저자는 이러한 동역학이 강화학습과 깊은 연관이 있음을 밝힌다. 전략별 누적 점수(또는 페이오프)를 로그-선택 규칙에 적용하면 복제자 동역학이 도출되는 기존 결과를, 헤시안 메트릭이 급격히 증가하는 경우에도 동일한 방식으로 확장한다. 즉, ‘스코어 기반 로그-선택’이 헤시안 게임 동역학을 구현한다는 것이며, 이는 강화학습 이론과 진화 게임 이론 사이의 다리 역할을 한다. 전체적으로, 논문은 리만 기하학을 이용해 게임 동역학을 일반화하고, 메트릭의 구조적 특성에 따라 동역학의 연속성, 수렴성, 학습 해석을 체계적으로 연결한다는 점에서 학문적 기여가 크다.

댓글 및 학술 토론

Loading comments...

의견 남기기