시각을 매개로 한 다국어 음성 임베딩 학습

본 논문은 이미지와 해당 이미지를 설명하는 영어·힌디어 음성 캡션을 이용해, 텍스트 전사 없이도 시각‑음성 다중모달 임베딩을 학습한다. 동일한 모델 구조를 양언어에 적용하고, 두 언어를 동시에 학습한 다국어 모델이 단일언어 모델보다 성능이 우수함을 보이며, 시각 정보를 ‘인터링구아’로 활용해 직접적인 음성‑음성 교차 검색도 가능함을 실증한다.

저자: David Harwath, Galen Chuang, James Glass

본 논문은 “시각을 매개로 한 다국어 음성 임베딩”이라는 새로운 접근법을 제시한다. 연구 배경으로는 현재의 자동 음성 인식(ASR)·기계 번역(MT) 시스템이 대규모 텍스트 전사와 어휘·음소 사전 등 풍부한 언어 자원을 필요로 하며, 이는 전 세계 7,000여 개 언어 중 소수에만 적용 가능하다는 한계가 있다. 이러한 문제를 해결하고자 최근에는 음성 데이터를 시각적 맥락(이미지·비디오)과 결합해 약한 감독(weakly‑supervised) 방식으로 학습하는 연구가 활발히 진행되고 있다. 기존 연구는 주로 영어 음성에 초점을 맞추었지만, 본 논문은 영어와 힌디어 두 언어에 동일한 모델을 적용하고, 두 언어를 동시에 학습한 다국어 모델이 단일언어 모델보다 더 우수한 성능을 보임을 실증한다.

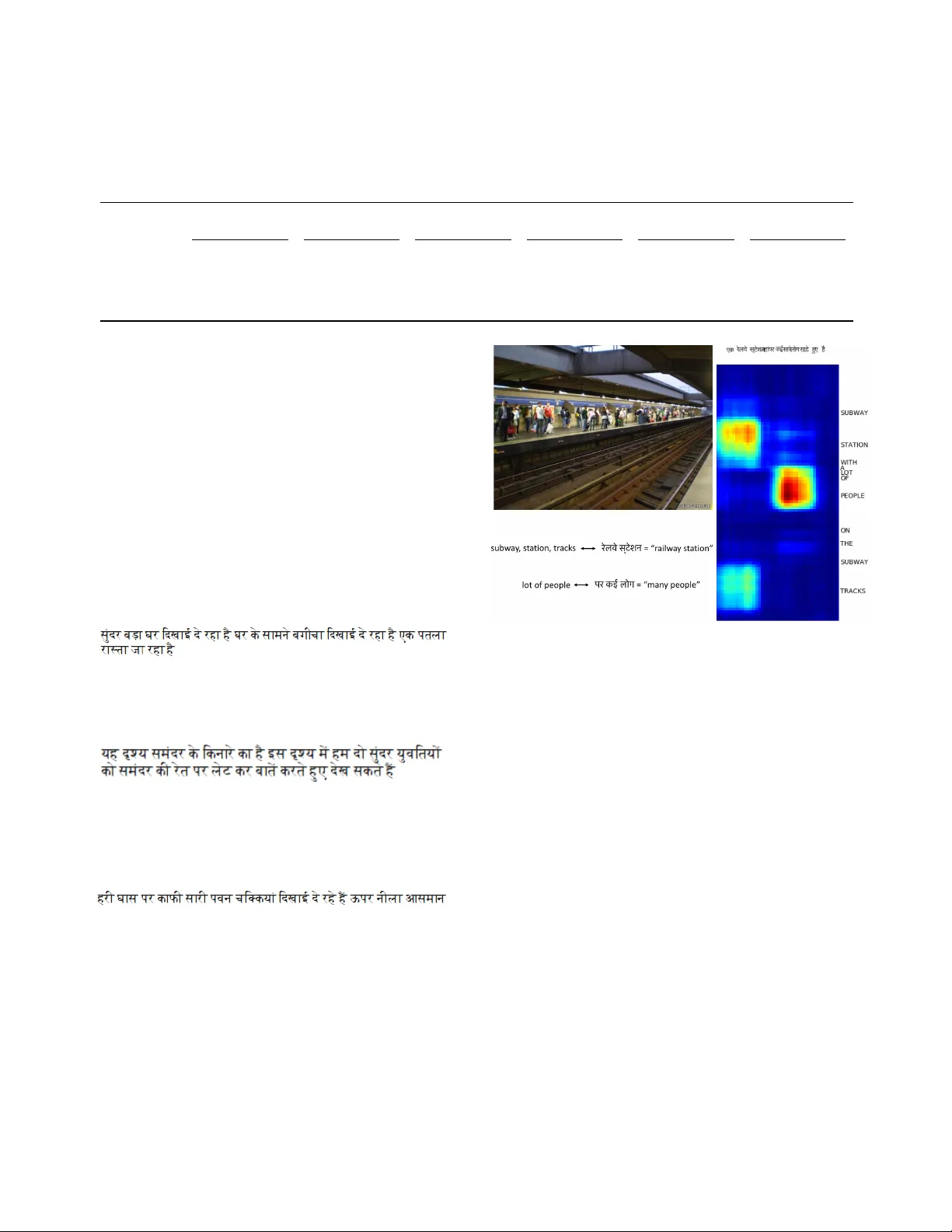

데이터는 MIT Places 205 이미지 데이터베이스에서 추출한 85,480개의 이미지와 각각에 대한 영어·힌디어 음성 캡션으로 구성된다. 캡션은 사람에게 이미지를 보여주고 자유롭게 설명하도록 요청한 것으로, 전사나 텍스트 라벨이 전혀 존재하지 않는다. 영어 캡션은 평균 19.3 단어(≈9.5 초), 힌디어 캡션은 평균 20.4 단어(≈11.4 초)이며, 모두 원시 파형 형태로 사용된다.

모델 구조는 세 개의 컨볼루션 신경망(CNN) 인코더로 이루어진다. 이미지 인코더는 사전학습된 VGG‑16의 conv5까지를 사용하고, 3×3 컨볼루션과 전역 평균 풀링을 통해 2048‑차원 임베딩을 만든다. 음성 인코더는 로그 멜 필터뱅크 스펙트로그램을 입력으로 받아, 배치 정규화(BatchNorm)를 추가한 1‑D CNN 구조를 사용한다. 모든 음성 시퀀스는 1024 프레임(≈10 초)으로 패딩·절단해 고정 길이 텐서로 변환한다.

학습 목표는 마진 랭킹 손실이다. 앵커(a), 양성(p), 임포스터(i) 삼중항을 정의하고, 앵커와 양성 사이의 내적 유사도가 임포스터와의 유사도보다 최소 마진(η = 1)만큼 크게 되도록 최적화한다. 이 손실을 이미지↔영어, 이미지↔힌디어, 영어↔힌디어 등 6가지 방향으로 적용하거나, 여러 방향을 동시에 결합한 복합 손실을 설계한다. 특히 “H ↔ E ↔ I ↔ H” 구성은 이미지와 두 언어 캡션을 모두 연결해, 시각 정보를 통해 양언어 간 의미 정렬을 강화한다.

평가 방법은 검색(retrieval) 과제로, 임베딩 공간에서 쿼리 벡터와 타깃 벡터 사이의 내적 유사도를 기준으로 상위 1, 5, 10개의 결과를 반환하고, 정답이 포함되는 비율을 Recall@K로 측정한다. 실험 결과, 단일언어 모델(E ↔ I, H ↔ I)은 각각 R@1이 6.5 %와 6.1 % 수준에 머물렀지만, 다국어 모델(H ↔ E ↔ I ↔ H)은 R@1이 8.3 %까지 상승했다. 특히 음성‑음성 교차 검색(E ↔ H)에서는 다국어 모델이 단일언어 대비 약 2배 이상의 Recall을 기록했으며, 이는 시각 정보가 양언어 간 의미 정렬을 효과적으로 중재한다는 강력한 증거이다.

추가 분석으로, 음성 인코더의 최종 풀링 레이어를 제거하고 비정규화된 임베딩을 직접 비교한 결과, 동일 이미지에 대한 영어·힌디어 캡션 사이에 단어‑레벨 정렬이 나타났다. 이는 모델이 암묵적으로 단어‑레벨 번역 관계를 학습하고 있음을 시사한다.

결론적으로, 본 연구는 (1) 텍스트 전사 없이도 다국어 음성 의미 임베딩을 학습할 수 있음을 입증하고, (2) 시각 정보를 ‘인터링구아’로 활용해 양언어 간 의미 정렬을 촉진함으로써, 저자원 언어에 대한 음성 기술 적용 가능성을 크게 확대한다는 점을 강조한다. 향후 연구에서는 더 많은 언어와 복잡한 비디오·오디오 데이터셋을 활용하고, 정량적인 단어‑레벨 번역 평가를 수행함으로써 현재의 초기 결과를 보다 견고한 음성‑음성 번역 모델로 확장할 수 있을 것으로 기대한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기