시각 분석을 통한 설명 가능한 딥러닝

초록

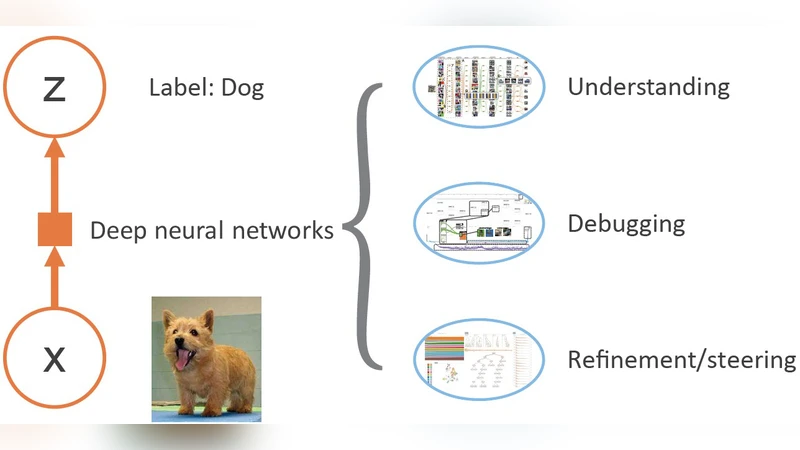

본 논문은 딥러닝 모델의 투명성과 인간 제어성을 확보하기 위해 시각 분석(Visual Analytics) 기법을 통합한 연구 동향을 리뷰한다. 정보 시각화와 머신러닝 이론을 연결해 모델 내부 구조·학습 과정·예측 결과를 직관적으로 탐색·해석할 수 있는 프레임워크를 제시하고, 현재 직면한 기술적·인간‑컴퓨터 상호작용적 과제와 향후 연구 방향을 논의한다.

상세 분석

논문은 먼저 딥러닝 모델이 “블랙박스”로 인식되는 근본 원인을 신경망의 고차원 파라미터 공간과 비선형 연산 구조에 둔다. 이를 극복하기 위한 접근법으로 시각 분석을 제시하는데, 이는 데이터·모델·사용자 세 축을 동시에 고려하는 다중 레이어 시각화 파이프라인을 의미한다. 구체적으로, (1) 특성 공간 시각화에서는 t‑SNE, UMAP 등 차원 축소 기법을 활용해 레이어별 활성값을 2‑D 혹은 3‑D 클러스터 형태로 표현하고, 클래스 경계와 오분류 패턴을 직관적으로 드러낸다. (2) 학습 과정 추적에서는 손실 곡선, 가중치 변화, 그래디언트 흐름 등을 시계열 차트와 히트맵으로 연동시켜, 학습 초반 과적합, 학습률 조정 필요성 등을 실시간으로 파악한다. (3) 예측 설명 단계에서는 Grad‑CAM, LRP, SHAP 등 기존 설명 기법의 결과를 이미지·텍스트·그래프 형태로 결합해, 입력 특징이 최종 결정에 미치는 기여도를 시각적으로 강조한다. 논문은 이러한 시각화가 인간‑기계 협업을 촉진한다는 점을 강조한다. 사용자는 시각 인터페이스를 통해 가설을 검증하고, 모델 파라미터를 직접 조정하거나 데이터 라벨을 재정의함으로써 모델을 “제어”할 수 있다. 또한, 저자는 시각 분석이 다학제 협업(예: 의료, 법률)에서 도메인 전문가와 AI 엔지니어 간 의사소통 비용을 크게 낮춘다고 주장한다. 기술적 한계로는 대규모 모델(예: GPT‑3 수준)에서 실시간 시각화가 계산 비용을 초과할 위험, 시각화 자체가 새로운 편향을 도입할 가능성, 그리고 사용자 인터페이스 설계 시 인지 부하를 최소화하는 UI/UX 원칙이 아직 미비함을 지적한다. 마지막으로, 향후 연구 과제로 인터랙티브 프루닝, 멀티모달 시각 분석, 설명의 정량적 평가 프레임워크 등을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기