k가 중요할까 k‑NN 허브니스로 최적 k 찾기

본 논문은 보컬 분리를 위한 커널 가법 모델(KAM)에서 핵심 파라미터인 k‑NN 이웃 수(k)의 영향을 분석하고, 그래프 이론의 허브니스 지표를 이용해 각 트랙에 최적의 k 값을 자동으로 선택하는 방법을 제안한다. 제안 방법은 별도의 학습이나 다중 실행 없이 낮은 계산 비용으로 k를 최적화하며, 실험을 통해 기존의 전역적 k 스윕보다 향상된 SDR 결과와 허브니스와의 양의 상관관계를 확인한다.

저자: Delia Fano Yela, Dan Stowell, Mark S

본 논문은 커널 가법 모델(Kernel Additive Modelling, KAM)을 이용한 보컬 분리 작업에서 핵심 파라미터인 k‑NN 이웃 수(k)의 역할을 심층적으로 조사하고, 그래프 이론에 기반한 새로운 자동 최적화 방법을 제안한다. KAM은 음악 신호를 시간‑주파수 스펙트로그램으로 변환한 뒤, 각 프레임을 특정 소스(예: 배경음악)와 유사한 다른 프레임들과 연결하고, 그 연결된 프레임들의 중앙값(median) 연산을 통해 배경음악을 추정한다. 이때 보컬은 배경음악에 비해 에너지와 패턴이 희소하고 변동성이 크기 때문에, 보컬이 포함된 프레임은 “이상치”로 간주되어 median 연산에서 억제된다. 이러한 과정에서 k는 각 프레임이 선택하는 가장 가까운 이웃의 수를 결정하는데, k가 작으면 이웃 집합이 너무 제한돼 보컬이 충분히 이상치로 드러나지 않을 위험이 있고, k가 지나치게 크면 모든 프레임이 서로 연결돼 그래프가 완전 연결망에 가까워져 허브성이 사라지고 median 연산의 강건성이 감소한다.

저자는 이러한 구조적 변화를 정량화하기 위해 k‑NN 그래프의 인‑디그리(다른 프레임이 해당 프레임을 이웃으로 선택한 횟수) 분포의 왜도, 즉 허브니스(hubness)를 도입한다. 허브니스는 그래프 내에서 특정 프레임이 “허브” 역할을 하는 정도를 나타내며, 배경음악이 반복적으로 나타나는 구간은 높은 허브성을 보인다. 보컬이 희소하고 변동성이 크므로, 이상적인 k는 허브니스가 최대가 되는 지점이라고 가정한다. 이를 위해 무작위 그래프(에르되시‑레니 모델)에서 기대되는 허브니스 값을 계산하고, 실제 데이터에서 관측된 허브니스와의 차이를 ‘과잉 허브니스(excess hubness)’로 정의한다. 차이를 정규화하기 위해 전체 k 스윕에서 최대 허브니스와 최대 기대 허브니스의 차를 이용해 스케일을 맞춘다.

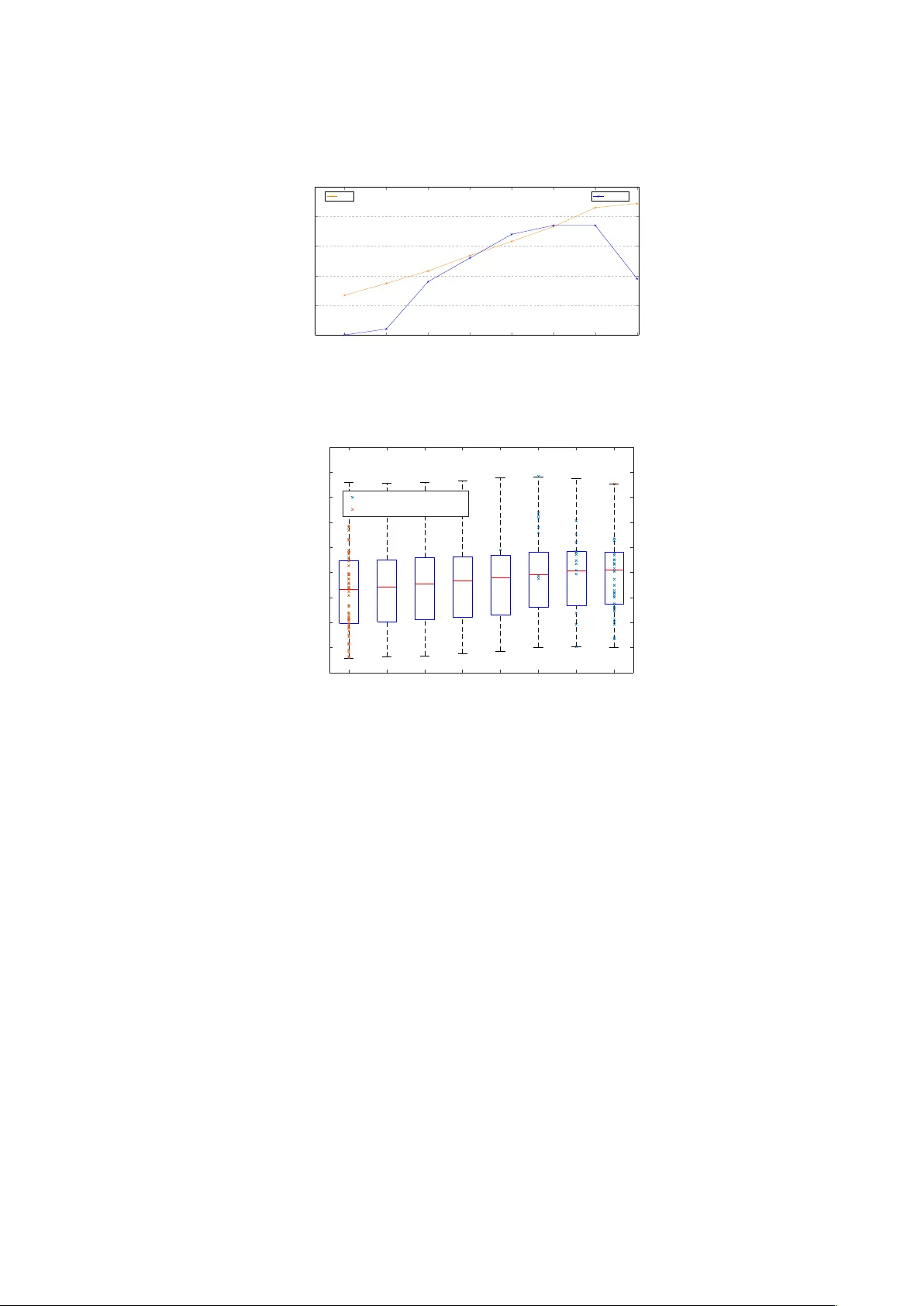

실험은 공개된 Test Demixing Secrets Dataset (DSD100) 50곡을 대상으로 수행된다. 기존 방법은 고정된 k 값을 {0, 25, 50, 100, 200, 400, 800, 1600, 3200} 로 설정하고, 제안 방법은 각 곡의 프레임 수 N에 비례해 k를 0.001 ~ 0.45 × N 범위의 비율로 세밀하게 탐색한다. 평가 지표는 BSS_Eval의 Signal‑to‑Distortion Ratio(SDR)이며, 결과는 다음과 같다. 고정된 k 값이 증가할수록 평균 SDR이 상승하는 경향을 보였지만, 일부 곡에서는 k가 지나치게 커져 오히려 성능이 저하되는 현상이 나타났다. 반면 허브니스는 k가 중간값(예: 800~1600)에서 최고점을 찍으며, 이 구간의 SDR도 평균적으로 높은 편이었다. 즉, 허브니스와 SDR 사이에 양의 상관관계가 존재함을 확인했다. 또한 제안 방법은 한 번의 그래프 구축과 허브니스 계산만으로 최적 k를 결정하므로, 기존의 다중 실행 기반 파라미터 스윕에 비해 계산 비용이 크게 절감된다.

결론적으로, k‑NN 허브니스는 KAM 기반 보컬 분리에서 k 파라미터의 구조적 적합성을 평가하는 효과적인 지표이며, 이를 활용한 자동 k 최적화는 실시간 처리나 대규모 데이터셋에서도 실용적이다. 향후 연구에서는 허브니스 외에도 클러스터링 계수, 평균 최단 경로 길이 등 추가적인 그래프 특성을 결합해 파라미터 선택을 더욱 정교화하고, 다른 소스 분리 작업(예: 악기 분리, 음성 강화)에도 적용 가능성을 탐색할 수 있다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기