웹 비디오 사운드 이벤트 검출을 위한 검색 쿼리 활용 프레임워크

본 논문은 유튜브와 같은 웹 비디오에서 사운드 이벤트를 대규모로 탐지하기 위해, 메타데이터 기반 검색 쿼리를 임시 라벨로 사용하고, 이를 통해 수집한 비디오를 학습된 CNN 분류기로 분석한다. 78개의 사운드 라벨을 이용해 3.7백만 개의 2.3초 세그먼트를 크롤링하고, ESC‑50, UrbanSound8K, TUT 데이터셋으로 학습한 세 모델의 예측을 검색 쿼리 라벨과 인간 청취 라벨 두 가지 기준으로 평가하였다. 검색 쿼리 라벨과 인간 라벨…

저자: Rohan Badlani, Ankit Shah, Benjamin Elizalde

본 논문은 웹 비디오, 특히 유튜브와 같은 플랫폼에서 사운드 이벤트를 자동으로 탐지하고 라벨링하는 방법을 제안한다. 기존의 사운드 이벤트 연구는 주로 DCASE와 같은 제한된 규모의 오디오 전용 데이터셋에 의존해 왔으며, 웹 비디오와 같이 방대한 멀티미디어 환경에서는 메타데이터가 유일한 라벨링 단서가 된다. 저자들은 메타데이터에 포함된 텍스트 정보를 활용해 “ sound” 형태의 검색 쿼리를 구성하고, 이를 통해 78개의 사운드 라벨에 해당하는 비디오를 크롤링하였다. 크롤링된 비디오는 3 초에서 10 분 사이의 길이로 제한했으며, 전체 약 260시간, 3.7 백만 개의 2.3초 세그먼트가 수집되었다.

수집된 비디오에 대한 라벨링은 두 단계로 진행된다. 첫 번째는 기존의 오디오 전용 데이터셋인 ESC‑50, UrbanSound8K, TUT를 활용해 각각 50, 10, 18개의 클래스를 학습하는 CNN 모델을 구축하는 것이다. 각 모델은 로그‑멜 스펙트로그램 60밴드와 그 델타를 2채널 입력으로 사용하며, 2.3초 길이의 윈도우를 90 % 겹치게 슬라이딩한다. 컨볼루션 레이어는 80개의 필터를 두 차례 적용하고, 풀링과 완전 연결층을 거쳐 소프트맥스 출력으로 78개 클래스 중 하나를 예측한다. 학습은 Keras 기반 SGD로 수행되었으며, 검증 세트를 통해 하이퍼파라미터를 최적화하였다.

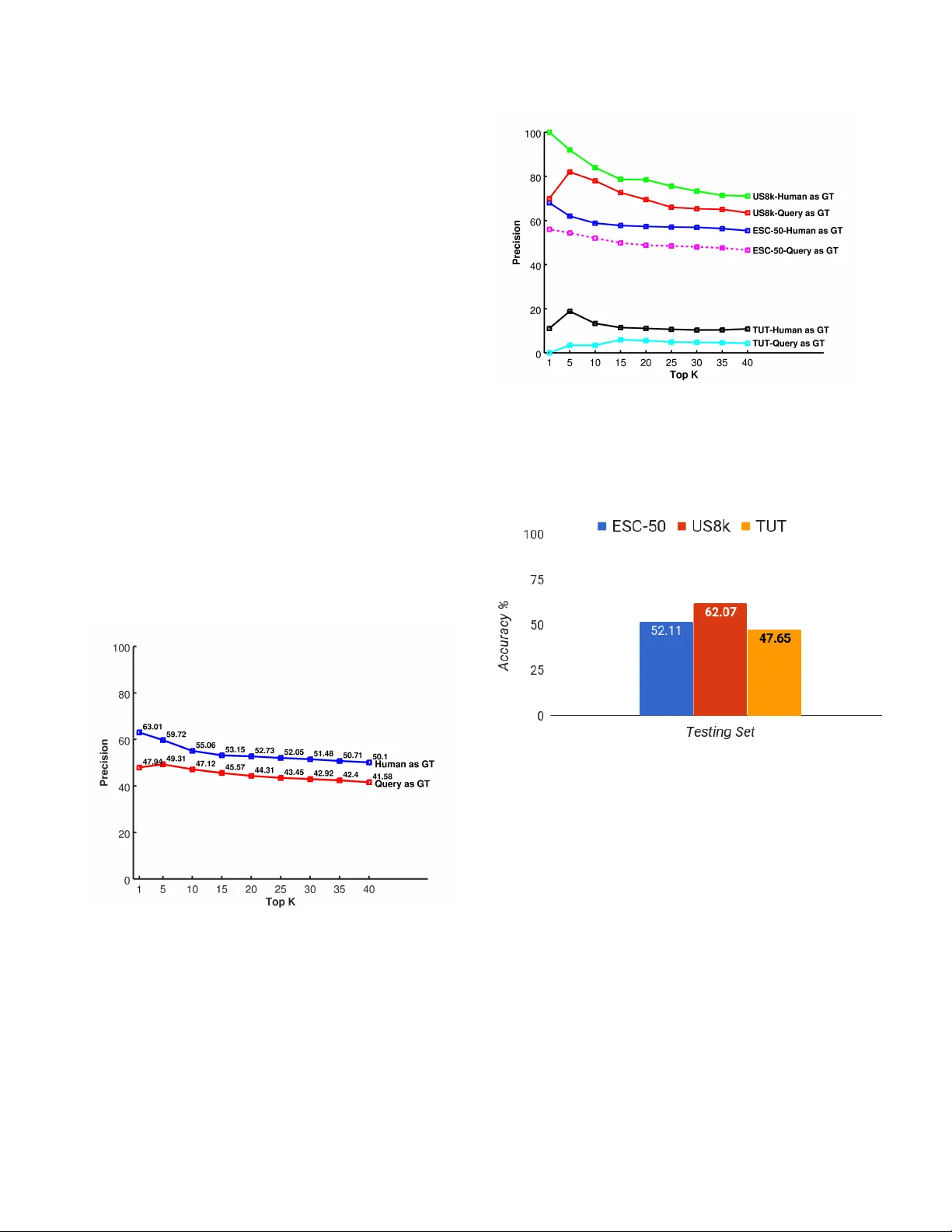

두 번째 단계는 학습된 모델을 크롤링된 비디오 세그먼트에 적용해 예측 확률을 얻는 것이다. 예측 결과는 확률 순으로 정렬되며, 상위 K 개(최대 40개) 세그먼트를 선택해 두 가지 기준으로 평가한다. 첫 번째 기준은 검색 쿼리 자체를 라벨로 가정하는 것으로, 해당 쿼리와 일치하는 모든 세그먼트를 양성으로 처리한다. 두 번째 기준은 인간 청취자를 통한 라벨링으로, 웹 인터페이스에 업로드된 오디오만을 제공하고 시각적·텍스트적 힌트를 차단한 상태에서 청취자들이 “정확함/부정확함”을 판단한다. 각 세그먼트는 최소 3명의 청취자가 평가했으며, 다수결로 최종 라벨을 결정한다.

평가 결과, 검색 쿼리 라벨과 인간 라벨 간 정밀도 차이는 10 % 이내로 매우 근접하였다. 구체적으로 ESC‑50 기반 모델은 검색 쿼리 기준 정밀도 15.43 %, 인간 라벨 기준 정밀도는 약 22 % 정도였으며, US8K 모델은 각각 33.58 %와 40 % 수준, TUT 모델은 7.43 %와 13 % 수준을 보였다. K가 증가함에 따라 정밀도가 안정화되는 경향이 뚜렷했으며, 특히 K = 10~20 구간에서 사용자가 실제 검색 결과 페이지에서 보는 상위 항목과 일치한다는 점이 주목할 만하다. 또한, 각 모델이 자체 테스트 셋에서 달성한 정확도(ESC‑50 52.11 %, US8K 62.07 %, TUT 47.65 %)는 무작위 대비 크게 향상된 것으로, 학습된 CNN이 원본 데이터셋에서 충분히 일반화 가능함을 확인한다.

본 연구의 주요 기여는 다음과 같다. 첫째, 메타데이터 기반 검색 쿼리를 임시 라벨로 활용해 대규모 웹 비디오에서 사운드 이벤트 라벨을 자동으로 생성하는 프레임워크를 제시하였다. 둘째, 검색 쿼리 라벨이 인간 청취 라벨과 높은 상관관계를 보임을 실험적으로 입증함으로써, 비용이 많이 드는 인간 라벨링을 대체하거나 보완할 수 있는 가능성을 제시하였다. 셋째, 멀티클래스 CNN 모델을 각각의 데이터셋에 맞게 최적화하고, 2.3초 길이의 세그먼트 단위로 실시간에 가까운 탐지가 가능하도록 설계하였다.

하지만 몇 가지 한계점도 존재한다. 메타데이터는 시각적 콘텐츠와 강하게 연관될 수 있어, 실제 오디오와 불일치하는 경우가 여전히 발생한다. 또한, “sound” 키워드가 포함된 쿼리라도 사운드가 짧게 등장하거나 배경 소음에 묻히는 경우가 많아 정밀도가 제한적이다. 향후 연구에서는 (1) 크라우드소싱을 통한 라벨 확장 및 품질 검증, (2) 영상·텍스트·오디오를 동시에 활용하는 멀티모달 학습, (3) 장시간 비디오에 대한 연속적 이벤트 검출 및 시간적 연관성 모델링을 진행할 필요가 있다. 이러한 방향을 통해 웹 비디오에서 사운드 이벤트 인식의 정확도와 실용성을 크게 향상시킬 수 있을 것으로 기대된다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기