멀티태스킹 트리플렛 GAN 기반 화자 검증 모델

본 논문은 트리플렛 손실에 조건부 GAN과 소프트맥스 분류기를 결합한 멀티태스킹 프레임워크(MTGAN)를 제안한다. GAN은 샘플 다양성과 일반화를, 소프트맥스는 화자 구분 특성을 강화한다. Librispeech로 학습하고 TIMIT로 평가한 결과, 기존 i‑vector와 단일 트리플렛 모델 대비 EER을 각각 67%와 32% 감소시켰으며, 정확도도 92.65%까지 끌어올렸다.

저자: Wenhao Ding, Liang He

본 논문은 짧은 발화에 대한 텍스트‑독립 화자 검증을 목표로, 기존 트리플렛 손실 기반 모델의 한계를 보완하기 위해 멀티태스킹 학습 프레임워크인 MTGAN(Multitasking Triplet Generative Adversarial Networks)을 제안한다. 연구 배경으로는 i‑vector/PLDA와 같은 전통적인 방법이 짧은 발화에서는 성능이 떨어지고, 최근 DNN 기반 엔드‑투‑엔드 모델이 좋은 성과를 보이지만, 특히 트리플렛 손실을 적용한 경우 학습 데이터가 제한적일 때 화자와 무관한 특징을 학습하는 위험이 있다는 점을 들었다. 이를 해결하고자 인코더에 조건부 GAN과 화자 분류기를 추가해 세 가지 목표를 동시에 달성한다.

1) **인코더**: 2초 길이의 멜‑FBANK(128×128) 스펙트로그램을 입력으로 받아 512 차원의 임베딩을 출력한다. 이 임베딩은 트리플렛 손실, 소프트맥스 손실, GAN 손실 모두에 사용된다.

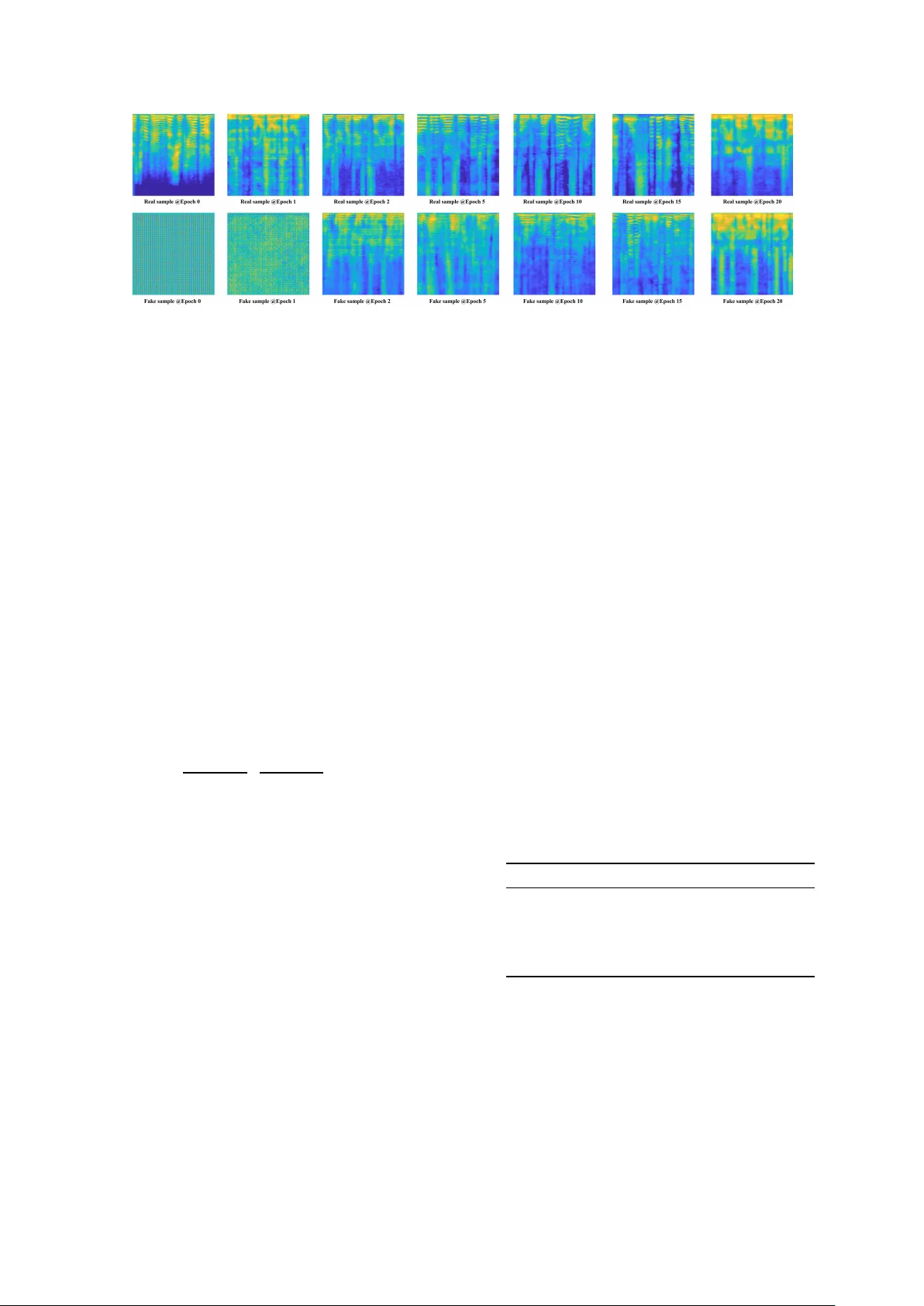

2) **조건부 GAN**: 생성기는 인코더 임베딩과 무작위 노이즈(z)를 결합해 합성 음성 스펙트로그램을 만든다. 판별기는 실제 스펙트로그램과 생성된 스펙트로그램을 구분하며, WGAN‑GP 기법을 적용해 학습 안정성을 확보한다. GAN의 목적은 데이터 다양성을 인위적으로 확대해 인코더가 보다 일반화된 특징을 학습하도록 돕는 것이다.

3) **화자 분류기(Softmax)**: 실제와 합성 샘플 모두를 입력받아 화자 라벨에 대한 소프트맥스 손실을 계산한다. 이 손실은 인코더가 화자 구분에 직접적인 지도 신호를 받게 하여, 트리플렛 손실만 사용할 때 발생할 수 있는 “화자와 무관한 특징” 학습을 억제한다.

전체 손실 함수는 다음과 같이 정의된다.

L_MTGAN = ω₁·L_triplet + ω₂·L_softmax + ω₃·L_G + ω₄·L_D

여기서 ω₁~ω₄는 실험을 통해 0.1, 0.2, 0.2, 0.5로 설정하였다. 트리플렛 손실은 코사인 거리 기반이며 마진 α=0.2를 사용한다.

**샘플링 전략**은 기존 반‑하드 네거티브 방식 대신 배치 내 무작위 샘플링을 채택했으며, 배치에 충분히 많은 화자를 포함시키면 샘플 다양성이 확보돼 성능 차이가 미미함을 실험적으로 확인했다.

**실험 설정**은 다음과 같다. 학습 데이터는 Librispeech “other” 파트에서 1252명(후에 2484명) 화자를 사용했으며, 테스트는 TIMIT를 이용해 전 음소를 포함한 발화를 평가했다. 평가 지표는 Equal Error Rate(EER)와 Accuracy(ACC)이며, 각 모델은 동일한 전처리와 하이퍼파라미터로 비교하였다.

**주요 결과**는 표 1에 요약된다. i‑vector/Cosine은 EER 8.48%, i‑vector/PLDA는 5.61%, Softmax 기반 DNN은 3.61%, 기존 트리플렛 모델은 2.68%를 기록했다. MTGAN은 1.81%의 EER와 92.65%의 정확도로 가장 우수했으며, 이는 i‑vector 대비 67% 감소, 기존 트리플렛 대비 32% 감소에 해당한다. DET 곡선에서도 MTGAN이 가장 낮은 오류율을 보였다.

**Ablation Study**에서는 각 모듈을 하나씩 제거한 실험을 수행했다. (1) GAN 없이 학습하면 EER 2.04%로 약간 상승, (2) Softmax 손실 없이 학습하면 EER 3.34%로 크게 악화, (3) 트리플렛 손실 없이 학습하면 EER 2.71%로 감소하지만 여전히 최적보다 못했다. 이는 세 요소가 상호 보완적으로 작용함을 의미한다. 또한 샘플링 방법(무작위 vs 반‑하드)과 배치 내 화자 수(60명 vs 600명) 실험에서, 화자 수가 많을수록 성능이 향상되며 샘플링 방식 차이는 미미함을 확인했다.

**임베딩 차원** 실험에서는 128, 256, 512, 768, 1024 차원을 테스트했으며, 차원이 커질수록 EER이 소폭 감소했지만 512 차원에서 이미 포화 현상이 나타났다.

**학습 데이터 규모**를 확대한 실험에서는 화자 수를 2484명으로 늘리면 EER가 1.33%까지 낮아지고 정확도 94.27%에 도달했다. 다만 수렴 속도가 다소 느려졌으며, 클래스 수에 따라 분류기의 출력층 크기가 증가하는 구조적 제약이 존재한다.

**결론**으로, MTGAN은 트리플렛 손실의 클러스터링 효과와 GAN의 데이터 다양성 증대, 소프트맥스의 라벨 기반 지도학습을 결합해 짧은 발화 화자 검증에서 기존 방법들을 능가한다. 향후 연구 과제로는 GAN 훈련 안정성 향상, 실시간 추론을 위한 경량화, 그리고 다양한 언어·노이즈 환경에 대한 일반화 검증이 제시된다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기