텍스트 프롬프트 스피커 인증을 위한 딥 CNN 특징 추출기

초록

본 논문은 텍스트‑프롬프트 스피커 인증에서 딥 컨볼루션 신경망(CNN)을 활용한 고수준 특징 추출기를 제안한다. Max‑Feature‑Map(MFM) 활성화와 멀티태스크 학습(스피커와 숫자 동시 구분)을 결합해, RSR2015 평가 셋에서 2.85% EER를 달성했으며, 기존 GMM‑SVM·State‑GMM‑SVM·State‑PLDA 기반 시스템과의 융합을 통해 EER를 1.43%까지 낮추었다.

상세 분석

이 연구는 텍스트‑프롬프트 방식, 즉 사용자가 사전에 정의된 암호(숫자열)를 말하도록 요구하는 스피커 인증 시나리오에 초점을 맞춘다. 기존에는 i‑vector 기반 TV‑UBM, GMM‑SVM, State‑PLDA 등 통계적 모델이 주류였으며, 딥러닝을 직접 스피커 구분에 적용한 사례는 아직 드물었다. 논문은 이러한 공백을 메우기 위해 Light‑CNN 구조에 기반한 깊은 컨볼루션 네트워크를 설계했으며, 핵심은 Max‑Feature‑Map(MFM) 활성화 함수이다. MFM은 두 개의 채널을 비교해 큰 값을 선택함으로써 ReLU와 유사한 비선형성을 제공하면서도 자동 차원 축소와 특징 선택 역할을 수행한다. 이는 파라미터 수를 크게 늘리지 않으면서도 표현력을 강화한다는 장점이 있다.

입력 특징으로는 64차원의 로그 멜 파워 스펙트럼을 사용하고, 시간 축은 최장 96프레임(≈0.96 s)으로 고정한다. 길이가 짧은 경우는 zero‑padding, 긴 경우는 끝부분을 잘라내는 방식으로 정규화한다. HMM‑Viterbi 기반의 디지털(0‑9) 구간 분할을 사전에 수행해 각 숫자마다 별도의 임베딩을 추출한다.

학습 단계에서는 두 가지 모드를 비교한다. 단일 태스크(스피커만 구분)에서는 7.83% EER에 머물렀지만, 멀티태스크(스피커 × 숫자, 총 N × 10 클래스)로 전환하면서 EER가 5.12%로 크게 개선되었다. 특히 훈련 데이터에 영어(WSJ)와 러시아어(새로 구축한 STC‑Russian‑digits) 코퍼스를 추가하면, 언어 간 공통 스피커 변동성을 학습해 2.85% EER까지 끌어올렸다. 이는 딥 모델이 도메인 외 데이터에도 강인하게 일반화될 수 있음을 시사한다.

점수 계산은 학습 후 마지막 소프트맥스 레이어를 제거하고, 앞선 전결합 층에서 추출한 1024‑차원 임베딩을 코사인 유사도로 비교한다. 각 숫자별 코사인 점수를 평균해 최종 패스프레이즈 점수를 산출한다. 별도의 PLDA나 스코어 정규화가 필요 없으며, 이는 시스템 구현을 단순화한다.

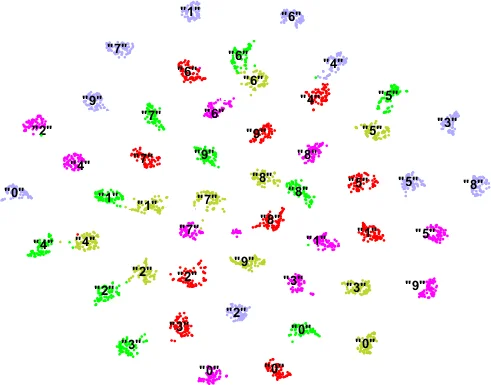

성능 평가에서는 RSR2015 Part 3(5‑digit 패스프레이즈)와 STC‑Russian‑digits 두 데이터셋을 사용했다. 기존 베이스라인 중 가장 좋은 StGMM‑SVM은 3.11% EER를 기록했지만, 제안된 StCNN‑MT(멀티태스크) 모델은 2.85% EER로 우위를 점했다. 더 나아가 BOSARIS 툴킷을 이용해 StCNN과 기존 시스템을 다중 융합하면 전체 EER가 1.43%까지 감소했으며, 이는 개별 베이스라인 대비 약 54%의 오류 감소율이다. t‑SNE 시각화에서도 동일 스피커의 서로 다른 숫자 발화가 클러스터를 형성함을 확인할 수 있었다.

결론적으로, MFM 기반 딥 CNN과 멀티태스크 학습은 텍스트‑프롬프트 스피커 인증에서 통계적 베이스라인을 능가하는 강력한 특징 추출기를 제공한다. 또한, 언어 다양성을 포함한 대규모 비동일 도메인 데이터가 모델 일반화에 긍정적 영향을 미친다는 점은 향후 다언어·다도메인 스피커 인증 시스템 설계에 중요한 인사이트를 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기