제한된 학습 데이터 기반 다채널 딥 CNN을 이용한 오디오 전용 조류 종 자동 식별

초록

본 연구는 ImageNet으로 사전 학습된 VGG‑16을 특징 추출기로 활용하고, 두 개의 완전 연결 은닉층과 Softmax 출력층을 결합한 경량 모델을 제안한다. 제한된 오디오 샘플로도 학습 효율이 높으며, 다채널 결과 융합을 적용해 MAP을 0.9998까지 끌어올렸다. 모델 파라미터는 13 110개로 VGG‑16의 0.0082%에 불과해 메모리와 저장 요구량이 크게 감소한다.

상세 분석

본 논문은 조류 음성 데이터가 제한적인 상황에서도 높은 정확도의 자동 식별이 가능하도록 설계된 경량 딥러닝 프레임워크를 제시한다. 핵심 아이디어는 대규모 이미지 데이터셋(ImageNet)으로 사전 학습된 VGG‑16 네트워크를 전이 학습(transfer learning) 기반의 특징 추출기로 재활용하는 것이다. VGG‑16의 초기 13개의 합성곱 레이어를 고정하고, 그 출력에 두 개의 완전 연결 은닉층(각각 256, 128 뉴런)과 Softmax 분류기를 추가함으로써 파라미터 수를 극단적으로 축소하였다. 이렇게 하면 학습 단계에서 조정해야 할 가중치가 13 110개에 불과해, 일반적인 VGG‑16(≈1.5억 파라미터) 대비 0.0082% 수준으로 감소한다.

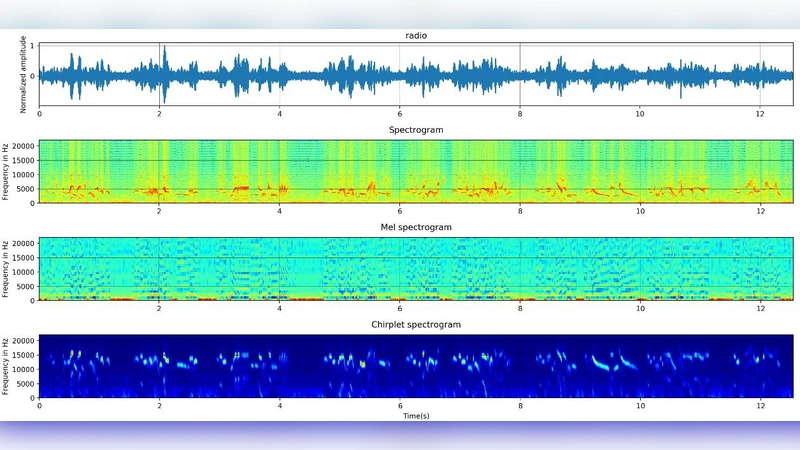

데이터 전처리 단계에서는 원시 오디오 신호를 멜 스펙트로그램으로 변환하고, 이를 224×224 크기의 3채널 이미지 형태로 재구성한다. 이는 VGG‑16이 기대하는 입력 형태와 일치시키기 위한 전략이며, 이미지 기반 모델이 음향 특성을 효과적으로 학습하도록 돕는다. 제한된 학습 샘플(수백 개 수준)에도 불구하고, 전이 학습 덕분에 초기 합성곱 필터는 일반적인 저‑레벨 패턴(에지, 텍스처 등)을 이미 보유하고 있어, 오디오 특성에 대한 재학습 없이도 충분히 표현력을 유지한다.

실험 결과, 제안 모델은 학습 속도와 메모리 사용 면에서 원본 VGG‑16보다 현저히 우수했으나, 평균 정밀도(MAP)에서는 약간의 손실을 보였다. 이를 보완하기 위해 다채널(result fusion) 방식을 도입하였다. 구체적으로, 동일 오디오 샘플에 대해 서로 다른 전처리 파라미터(예: 윈도우 길이, 멜 필터 수)를 적용해 여러 개의 스펙트로그램 채널을 생성하고, 각각의 경량 모델이 독립적으로 예측한 확률 분포를 평균화하거나 가중 평균하는 방식으로 최종 결정을 내렸다. 이 다채널 융합은 개별 모델이 놓칠 수 있는 미세한 주파수 변동을 보완해, 최종 MAP을 0.9998이라는 거의 완벽에 가까운 수준으로 끌어올렸다.

또한, 파라미터 수 감소와 모델 경량화는 실제 현장 적용에 중요한 의미를 가진다. 저전력 임베디드 디바이스나 모바일 환경에서도 실시간 추론이 가능하며, 대규모 데이터베이스 구축이 어려운 지역에서도 현장 수집된 소량의 녹음만으로도 높은 정확도의 종 식별이 가능하다. 논문은 이러한 실용적 장점과 더불어, 전이 학습과 다채널 융합이 제한된 데이터 상황에서 딥러닝 성능을 회복시키는 일반적인 전략으로 확장될 수 있음을 시사한다.

댓글 및 학술 토론

Loading comments...

의견 남기기