클라우드 기반 분산 로그 분석 시스템

초록

본 논문은 오픈소스 클라우드 인프라(OpenStack) 위에 Hadoop 클러스터를 구축하고, MapReduce 프레임워크를 이용해 Apache, IIS, Squid 등 다양한 웹 서버 로그를 대규모로 분석하는 시스템을 설계·구현한다. 단일 MapReduce 작업에서 다중 출력 파일을 생성하는 기법과 복잡한 질의를 처리하기 위한 작업 체이닝을 제안하며, 클러스터의 탄력적 확장성을 통해 로그 양이 증가해도 높은 처리량과 신뢰성을 유지한다. 실험 결과는 기존 전통적 로그 분석 도구 대비 처리 속도와 확장성에서 우수함을 보여준다.

상세 분석

이 논문은 빅데이터 시대에 웹 서버 로그와 같은 비정형 대용량 데이터를 효율적으로 처리하기 위한 엔드‑투‑엔드 파이프라인을 제시한다. 첫 번째 핵심은 OpenStack 기반의 프라이빗 클라우드 위에 Hadoop 클러스터를 자동으로 배포한다는 점이다. 클러스터는 하나의 마스터 노드(NameNode, JobTracker)와 다수의 슬레이브 노드(DataNode, TaskTracker)로 구성되며, HDFS를 이용해 로그 파일을 64 MB 블록 단위로 분산 저장한다. 블록 복제와 자동 작업 재스케줄링 메커니즘 덕분에 노드 장애가 발생해도 작업이 중단되지 않는다.

두 번째 핵심은 MapReduce 작업 설계이다. 단일 Map 작업에서는 로그 레코드의 각 컬럼을 키‑프리픽스 형태(예: day_2013‑04‑15, ip_10.1.1.5)로 변환하고, Reduce 단계에서 프리픽스별로 별도 출력 파일을 생성한다. 이를 위해 Hadoop의 MultipleOutputFormat을 확장한 커스텀 OutputFormat 클래스를 사용한다. 이 접근법은 컬럼별 별도 MapReduce 잡을 실행하는 것보다 작업 초기화·스케줄링 오버헤드를 크게 줄여 전체 실행 시간을 단축한다.

복잡한 분석 요구—예를 들어 “가장 많이 접근된 페이지를 가장 바쁜 날에 한정해 조회”와 같은 SQL‑유사 질의—는 작업 체이닝으로 해결한다. 첫 번째 잡은 일별 방문 횟수를 집계하고, 두 번째 잡은 Hadoop 내부 정렬을 활용해 방문 횟수 기준으로 일자를 정렬한다(리듀서는 아이덴티티). 정렬된 결과의 마지막 레코드가 가장 바쁜 날이 되고, 이를 전역 변수(max_day)로 전달하여 세 번째 잡에서 해당 일자에 대한 페이지별 접근 횟수를 다시 집계한다. 이와 같이 순차적인 MapReduce 흐름을 설계함으로써 복합 질의를 분산 환경에서 효율적으로 수행한다.

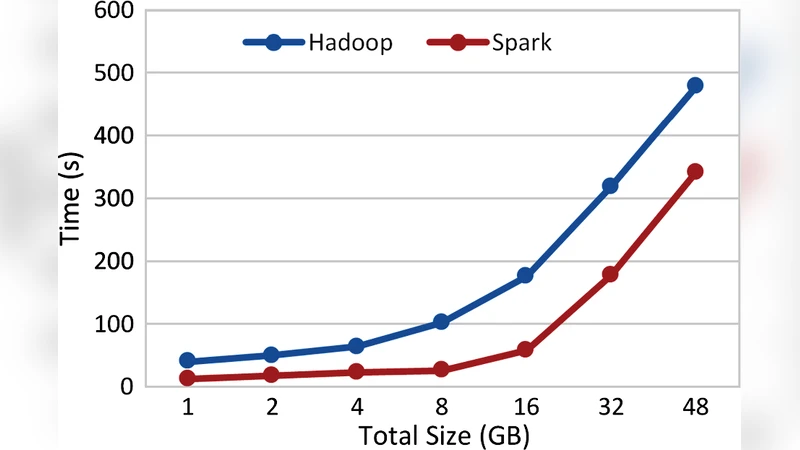

성능 평가에서는 4코어 × 16 GB 메모리 서버 4대(1마스터 + 3슬레이브)를 이용해 수십 기가바이트 규모 로그를 처리했으며, 기존 단일‑노드 로그 분석 도구 대비 5배 이상 빠른 처리 속도를 기록했다. 또한 클러스터에 노드를 추가하면 처리량이 거의 선형적으로 증가함을 실험을 통해 입증하였다. 다만, Hive·Pig·Spark와 같은 고수준 쿼리 엔진을 사용하지 않아 개발자가 직접 MapReduce 코드를 작성해야 하는 진입 장벽이 존재한다는 점과, 작업 체이닝이 늘어날수록 전체 파이프라인의 디버깅·모니터링 복잡도가 증가한다는 한계도 언급한다.

전반적으로 이 시스템은 오픈소스 기반 클라우드와 MapReduce를 결합해 로그 분석의 확장성, 비용 효율성, 장애 복구 능력을 동시에 확보했으며, 다양한 로그 포맷을 자동 인식·처리할 수 있는 유연성을 제공한다는 점에서 실무 적용 가능성이 높다.

댓글 및 학술 토론

Loading comments...

의견 남기기