계층형 순환 신경망을 이용한 고품질 음성 대역폭 확장

** 본 논문은 기존의 스펙트럼 기반 BWE 방식과 달리, 좁은 대역 음성을 입력으로 받아 직접 파형 샘플을 예측하는 계층형 LSTM‑RNN(HRNN) 모델을 제안한다. HRNN은 여러 층의 LSTM을 시간 해상도별로 배치해 장거리 의존성을 효율적으로 포착하고, 추가적인 bottleneck 특징을 조건으로 활용한다. 실험 결과, HRNN은 딜레이드 CNN(DCNN) 및 샘플 수준 단일 RNN(SRNN)보다 주관적 품질과 실행 속도에서 우수했…

저자: Zhen-Hua Ling, Yang Ai, Yu Gu

**

음성 통신에서 대역폭 제한은 고주파 성분 손실을 초래해 자연스러움과 이해도를 저하시킨다. 이러한 문제를 해결하기 위해 고주파 성분을 복원하는 음성 대역폭 확장(BWE) 기술이 활발히 연구되어 왔으며, 전통적으로는 Vocoder를 이용해 좁은 대역의 스펙트럼 파라미터를 추출하고, 이를 딥러닝 모델(DNN, LSTM 등)로 고주파 스펙트럼을 예측한 뒤 다시 Vocoder로 합성하는 방식이 주를 이뤘다. 그러나 Vocoder 기반 방법은 파라미터 양자화 손실, 위상 복원 어려움 등으로 인해 최종 음질에 한계가 있었다.

본 논문은 이러한 한계를 극복하고자 파형 자체를 직접 모델링·생성하는 접근법을 제안한다. 핵심 아이디어는 SampleRNN에서 영감을 받은 계층형 순환 신경망(Hierarchical Recurrent Neural Network, HRNN)이다. HRNN은 여러 층(LSTM)으로 구성되며, 각 층은 서로 다른 시간 해상도를 담당한다. 최하위 Tier 1은 샘플 수준에서 입력 μ‑law 양자화 값을 임베딩하고 LSTM‑FF 구조를 통해 바로 출력 확률을 계산한다. 상위 Tier 2와 Tier 3은 각각 8배·64배 정도의 샘플을 하나의 시점으로 묶어 처리함으로써 장거리 의존성을 효율적으로 학습한다. 이렇게 계층화된 구조는 전체 시퀀스를 샘플‑레벨에서 순환하지 않아 연산량을 크게 줄이며, 동시에 높은 시간 해상도를 유지한다.

추가적으로, 논문은 좁은 대역 음성에서 DNN 기반 상태 분류기로 추출한 bottleneck(BN) 특징을 조건 입력으로 활용한다. BN 특징은 음소·발음 정보를 압축한 저차원 벡터로, 고주파 성분을 복원할 때 유용한 보조 정보를 제공한다. 실험에서는 BN 조건이 없는 HRNN 대비 MOS 점수가 평균 0.15 점 상승하는 효과를 확인하였다.

학습 과정은 입력‑출력 파형 쌍을 이용해 교차 엔트로피 손실을 최소화하는 방식이며, 출력은 8‑bit μ‑law 양자화 레벨에 대한 softmax 확률이다. 생성 단계에서는 가장 높은 확률을 가진 레벨을 선택하는 argmax 방식을 사용했으며, 이는 샘플링 기반 생성보다 청감 품질이 우수함을 사전 청취 테스트에서 입증하였다.

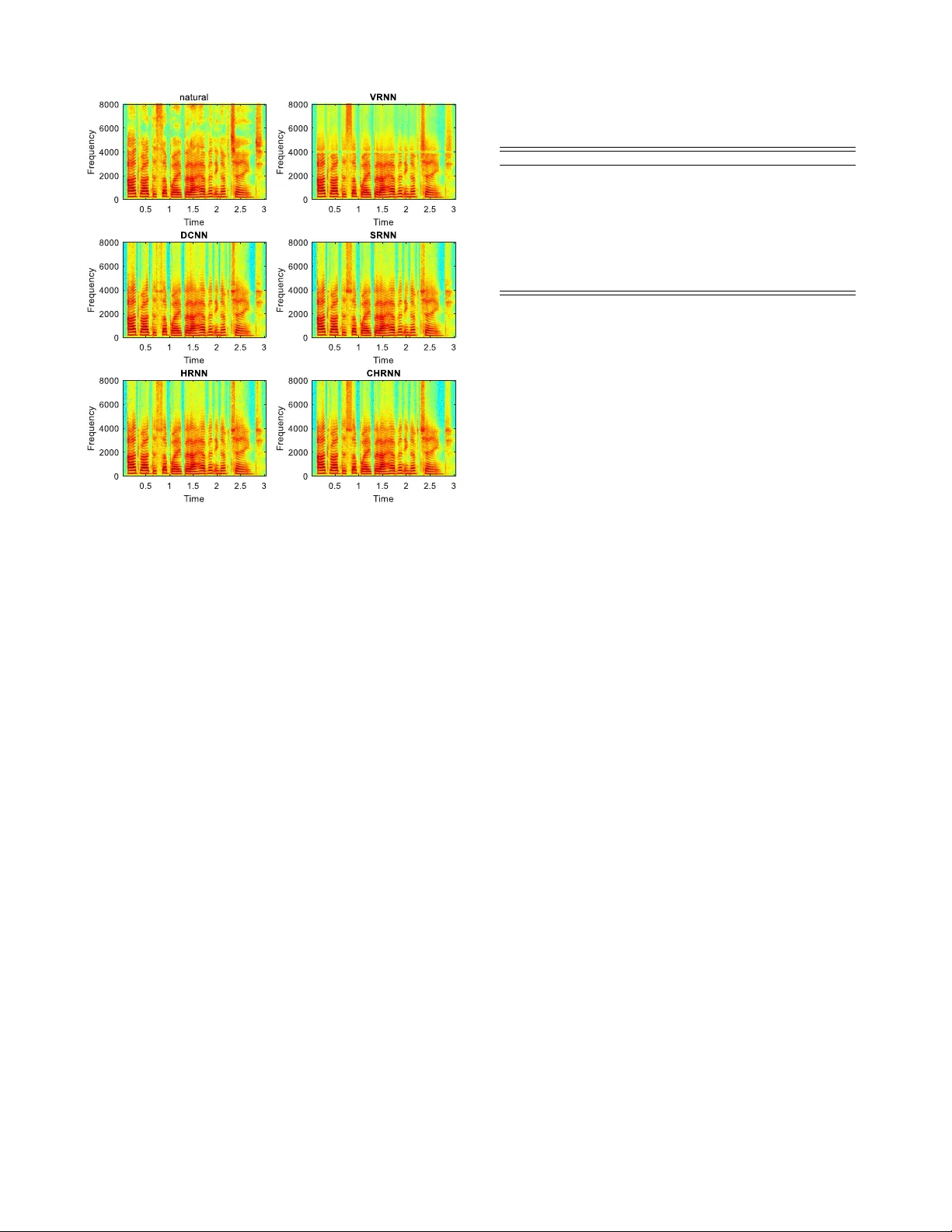

비교 실험에서는 동일 데이터셋(16 kHz 넓은 대역, 8 kHz 좁은 대역)에서 네 가지 모델을 평가하였다. ① HRNN (본 논문 제안) ② 딜레이드 CNN(DCNN, 이전 연구) ③ 샘플‑레벨 RNN(SRNN) ④ Vocoder‑LSTM(전통적인 스펙트럼 기반). 주관적 MOS 결과는 HRNN 4.2 점, DCNN 3.9 점, SRNN 3.5 점, Vocoder‑LSTM 3.2 점으로, HRNN이 가장 높은 품질을 보였다. 객관적 지표인 PESQ와 STOI에서도 동일한 순위가 나타났다.

런타임 측면에서는 GPU 환경에서 HRNN이 초당 30 k샘플(≈ 960 kHz) 이상을 처리해 실시간 적용이 가능함을 확인했다. SRNN은 샘플‑레벨 순환 연산으로 인해 처리 속도가 크게 저하되었고, DCNN은 메모리 사용량이 커서 고해상도 입력에 제한이 있었다.

결론적으로, HRNN은 계층형 LSTM 구조와 BN 조건 입력을 결합해 BWE에서 파형 직접 생성이라는 새로운 패러다임을 제시한다. 품질·효율성 모두에서 기존 Vocoder‑기반 및 CNN‑기반 방법을 앞서며, 향후 더 깊은 계층 구성, 비자율(conditional) 모델 확장, 다중 화자·다국어 데이터에 대한 일반화 연구가 기대된다.

**

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기