인터랙티브 머신러닝 시스템 평가

초록

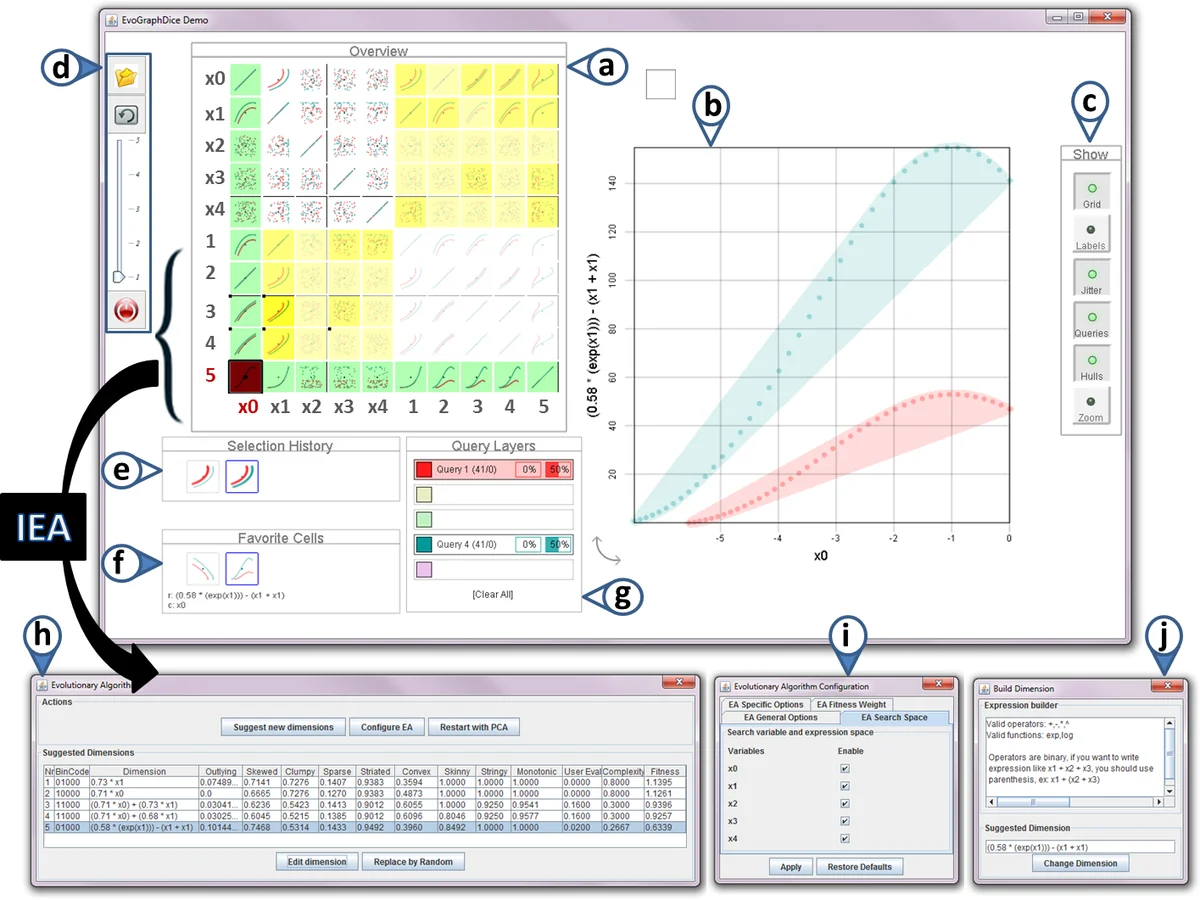

본 논문은 인간과 기계가 상호 작용하며 학습하는 인터랙티브 머신러닝(iML) 시스템의 평가 방법을 고찰한다. 알고리즘 중심의 정량적 분석과 인간 중심의 사용성·효용 평가를 결합해야 함을 주장하고, 다양한 도메인에서의 사례들을 체계적으로 분류·비교한다. 시각 분석을 위한 진화적 탐색 시스템을 사례 연구로 제시하며, 두 평가 축이 상호 보완적으로 작동함을 실증한다. 마지막으로 iML 연구에 필요한 HCI 기반 방법론과 향후 연구 과제를 제시한다.

상세 분석

이 장은 인터랙티브 머신러닝(iML)의 본질을 “인간‑기계 협업”으로 정의하고, 기존 연구가 알고리즘 성능에만 초점을 맞추는 경향을 비판한다. 저자는 평가를 두 축, 즉 알고리즘‑중심 평가와 인간‑중심 평가로 구분한다. 알고리즘‑중심 평가는 학습 알고리즘의 수렴 속도, 정확도, 탐색 효율성 등 정량적 메트릭을 사용해 시스템 자체의 계산적 행동을 측정한다. 반면 인간‑중심 평가는 사용자의 작업 효율, 인지 부하, 만족도, 통찰 획득 등 주관적·정성적 지표를 통해 시스템이 실제 사용자에게 제공하는 가치를 검증한다.

논문은 2012‑2017년 사이에 발표된 19편의 iML 논문을 체계적으로 리뷰한다. 여기서 인간 피드백을 암시적, 명시적, 혼합으로 구분하고, 시스템 피드백을 시각적, 불확실성 표시, 진행형 등으로 분류한다. 각 논문은 사례 연구, 사용자 실험, 관찰 연구, 설문 조사 등 다양한 평가 방법을 사용했으며, 객관적 메트릭(시간, 정밀도·재현율 등)과 주관적 메트릭(설문 점수, 인터뷰 내용) 모두를 활용했다.

특히 저자는 시각 분석 분야에서 인터랙티브 진화적 탐색 시스템을 사례로 들어, 알고리즘‑중심 실험으로는 진화 과정의 수렴 속도와 다양성 유지 정도를, 인간‑중심 실험으로는 사용자가 새로운 통찰을 얻는 빈도와 작업 시간 감소를 측정했다. 결과는 두 평가가 서로 보완적이며, 인간‑중심 설계가 “블랙박스” 문제를 완화하는 데 핵심적임을 보여준다.

마지막으로, iML 시스템 설계·평가에 HCI 방법론(사용자 모델링, 인터랙션 로그 분석, 프로토타이핑 등)을 도입해야 한다고 강조한다. 이는 인간의 숨은 역할(예: 암시적 피드백)과 시스템의 투명성 사이의 균형을 맞추는 데 필수적이다.

댓글 및 학술 토론

Loading comments...

의견 남기기