재현가능하고 효율적인 머신러닝 시스템 대회 플랫폼 ReQuEST

초록

ReQuEST는 머신러닝 워크로드와 하드웨어·소프트웨어 스택 전반을 아우르는 공동 설계 토너먼트 플랫폼이다. Collective Knowledge 프레임워크와 ACM 아티팩트 평가 방식을 활용해 구현·실험·평가 과정을 표준화하고, 속도·정확도·에너지·비용 등 다중 목표를 Pareto 최적화 형태로 공개 점수판에 시각화한다. 첫 토너먼트는 2018년 ASPLOS에서 진행될 예정이며, 지속적인 워크숍을 통해 다양한 데이터셋·모델·플랫폼을 확장한다.

상세 분석

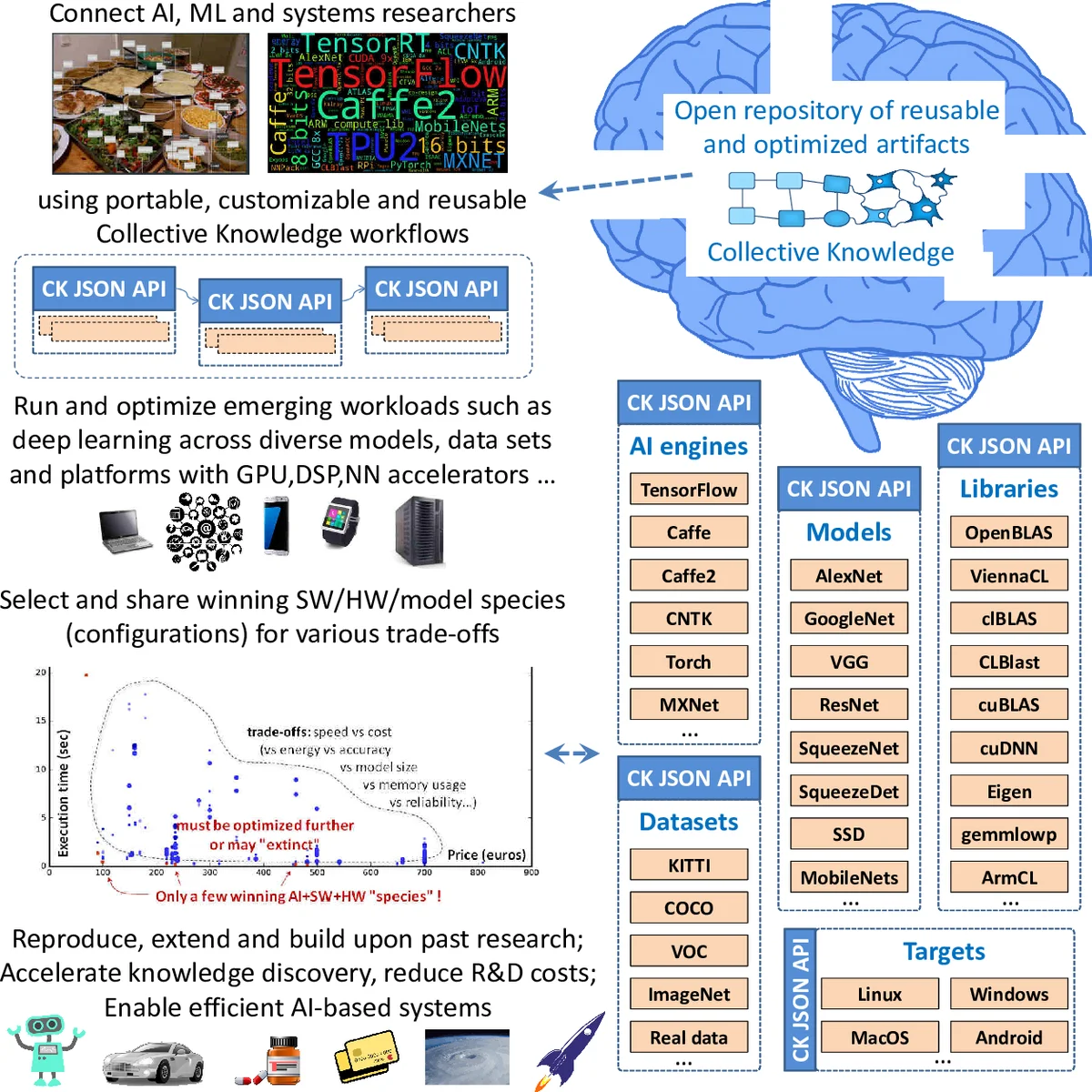

본 논문은 머신러닝 시스템 설계가 하드웨어·컴파일러·프레임워크·데이터셋·알고리즘 등 다층적인 선택지에 의해 복잡도가 급증하고 있음을 지적한다. 이러한 복잡성을 해소하기 위해 저자들은 “ReQuEST”라는 오픈 플랫폼을 제안한다. 핵심은 두 가지 축으로 나뉜다. 첫 번째는 Collective Knowledge (CK) 라는 파이썬 기반 워크플로우 엔진을 이용해 실험 아티팩트를 JSON 메타데이터와 플러그인 형태로 포장하고, 이를 버전 관리와 의존성 해결이 가능한 형태로 저장·공유한다는 점이다. CK는 기존 연구에서 GPU·DSP·FPGA·아날로그 가속기 등 이기종 하드웨어에 대한 자동 벤치마크와 다목적 최적화를 지원해 왔으며, 이를 ReQuEST에 적용함으로써 “플랫폼 독립적인 재현성”을 확보한다. 두 번째는 ACM Artifact Evaluation 절차를 공식적인 검증 메커니즘으로 채택한다는 점이다. 논문은 아티팩트 제출 시 코드·데이터·환경 설정을 모두 검증받아, 점수판에 올라가는 결과가 객관적이고 재현 가능하도록 설계한다.

다중 목표 최적화는 Pareto Frontier 개념을 중심으로 전개된다. 정확도·실행 시간·전력·코스트·하드웨어 면적 등 여러 차원을 동시에 고려해, 각 제출물은 해당 차원에서의 위치를 시각화한다. 특히, 논문에 제시된 예시 점수판(그림 2)은 다양한 딥러닝 프레임워크(TensorFlow, Caffe, MXNet 등)와 모델(AlexNet, ResNet, MobileNet 등), 그리고 모바일·데스크톱·서버 등 다양한 하드웨어에서의 speed vs. platform cost 관계를 한눈에 보여준다. 이는 연구자들이 “어떤 모델‑프레임워크‑하드웨어 조합이 특정 비용·성능 제약 하에 최적인지”를 직관적으로 판단하게 해준다.

또한, ReQuEST는 지속 가능한 커뮤니티 기반 로드맵을 강조한다. 토너먼트는 2년에 한 번씩 시스템·머신러닝 커뮤니티를 교대로 초청해 개최되며, 산업계 패널을 통해 실용적인 전이 전략을 논의한다. 장기 목표는 데이터센터부터 엣지 디바이스까지 포괄하는 하드웨어 스펙트럼을 지원하고, 비전·음성·자연어 처리 등 다양한 애플리케이션 도메인을 포함하도록 아티팩트 풀을 확장하는 것이다.

핵심 기여는 다음과 같다. 1) 표준화된 아티팩트 포맷과 자동화된 벤치마크 파이프라인을 제공해 재현성을 기술적·문화적 수준에서 보장한다. 2) 다중 목표 점수판을 통해 연구자와 엔지니어가 실제 운영 환경에 맞는 트레이드오프를 신속히 탐색한다. 3) 오픈 커뮤니티를 기반으로 지속적인 데이터·모델·플랫폼 업데이트를 가능하게 하여, 급변하는 ML 생태계에 대응한다. 이러한 설계는 현재 개별 논문 수준에서 이루어지는 “베이스라인 재현” 작업을 플랫폼 차원으로 끌어올려, 연구 생산성 및 산업 이전 효율성을 크게 향상시킬 것으로 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기