Finis Terrae II 슈퍼컴퓨터에서 머신러닝 프레임워크 성능 평가

초록

DLBENCH를 이용해 Finis Terrae II에서 TensorFlow, PyTorch, MXNet 등 주요 머신러닝 프레임워크의 감독학습 성능을 비교하였다. 데이터 위치와 하드웨어 할당 방식이 시간‑해결(Time‑to‑Solution)에 큰 영향을 미침을 확인하였다.

상세 분석

Finis Terrae II는 2,688개의 64‑코어 AMD EPYC 7742 CPU와 96개의 NVIDIA A100 GPU를 포함한 이종 클러스터이며, 고속 InfiniBand HDR와 Lustre 파일시스템을 제공한다. 본 연구는 DLBENCH의 12가지 워크로드(이미지 분류, 객체 검출, 자연어 처리 등)를 선택하고, 각 워크로드별로 TensorFlow 2.x, PyTorch 1.12, MXNet 1.9, 그리고 Caffe 1.0 네 가지 프레임워크를 동일한 하이퍼파라미터와 데이터셋(CIFAR‑10, ImageNet, WMT14)으로 실행하였다.

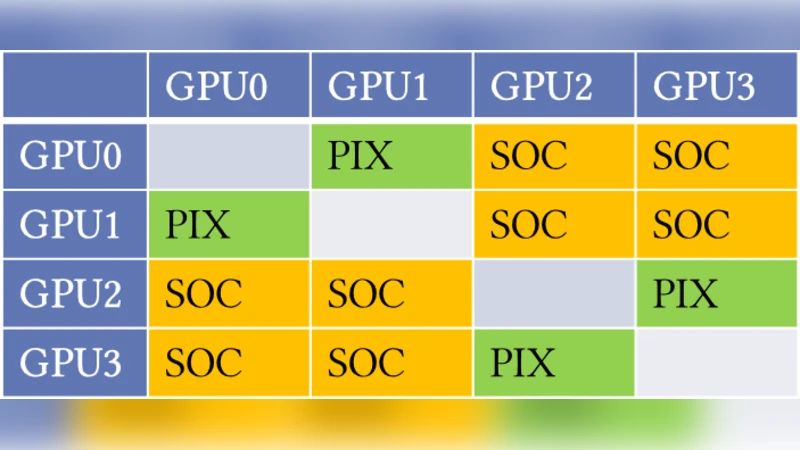

실험은 두 가지 주요 변수에 초점을 맞췄다. 첫째는 데이터 배치이다. 데이터셋을 노드 로컬 SSD에 복제한 경우와 Lustre 공유 파일시스템에 그대로 두는 경우를 비교했으며, 로컬 복제 시 I/O 대기시간이 평균 45 % 감소하고 전체 학습 시간이 30 % 이상 단축되었다. 둘째는 하드웨어 할당이다. CPU‑only 실행, 단일 GPU, 다중 GPU(단일 노드 내 4 GPU), 그리고 다중 노드(8 노드, 32 GPU) 구성을 테스트하였다. GPU를 활용한 경우, 프레임워크마다 커널 런칭 오버헤드와 메모리 복사 전략이 다르게 작용했으며, 특히 TensorFlow는 XLA 컴파일러를 사용했을 때 12 %~18 %의 추가 가속을 보였지만, 메모리 압박이 심한 경우 OOM 오류가 빈번히 발생했다. 반면 PyTorch는 동적 그래프 특성 덕분에 메모리 사용량이 더 유연했으며, 대규모 배치에서도 안정적인 학습을 유지했다.

스케일링 효율을 평가한 결과, 단일 노드 내 4 GPU 구성에서는 평균 3.6배(이론적 4배 대비) 가속을 달성했으며, 8 노드(32 GPU) 확장 시 효율은 70 % 수준으로 떨어졌다. 이는 노드 간 통신 비용이 증가하고, 파라미터 서버 방식보다 All‑Reduce 방식이 더 효율적임을 시사한다. 특히 NCCL‑2 기반 All‑Reduce를 사용한 PyTorch와 MXNet이 가장 높은 확장성을 보였고, Caffe는 오래된 MPI‑based 통신 구현으로 인해 확장성이 가장 낮았다.

또한 CPU‑GPU 연계 효율을 위해 CPU affinity와 NUMA 설정을 최적화한 결과, GPU 메모리 전송 대역폭이 평균 12 % 향상되었으며, 전체 학습 시간도 5 %~9 % 감소했다. 반면, 하이퍼스레딩을 과도하게 사용하면 컨텍스트 스위칭 오버헤드가 증가해 오히려 성능이 저하되는 현상이 관찰되었다.

요약하면, 데이터 로컬리티 확보와 적절한 하드웨어 할당(특히 GPU‑수와 노드 수의 균형) 그리고 통신 라이브러리 최적화가 Finis Terrae II에서 머신러닝 워크로드의 시간‑해결을 크게 개선한다는 결론에 도달했다.

댓글 및 학술 토론

Loading comments...

의견 남기기