EEG 레퍼런스 포인트 차이가 머신러닝 성능에 미치는 영향

초록

본 연구는 TUH EEG 코퍼스에 널리 사용되는 두 가지 레퍼런스 방식인 Linked Ear(LE)와 Averaged Reference(AR)의 통계적 차이를 분석하고, 이러한 차이가 HMM 기반 발작 검출 모델의 정확도에 어떻게 영향을 미치는지 평가한다. 평균·분산·PCA 분석을 통해 두 몽타주의 특성이 크게 다름을 확인했으며, LE 데이터만으로 학습한 모델이 77 %의 정확도로 가장 우수했지만, AR만 사용한 모델은 61 %에 머물렀다. 두 데이터를 혼합해 학습하면 성능이 약간 감소한다(71 %). cepstral mean normalization(CMN) 적용은 기대와 달리 성능 향상을 가져오지 못했다.

상세 분석

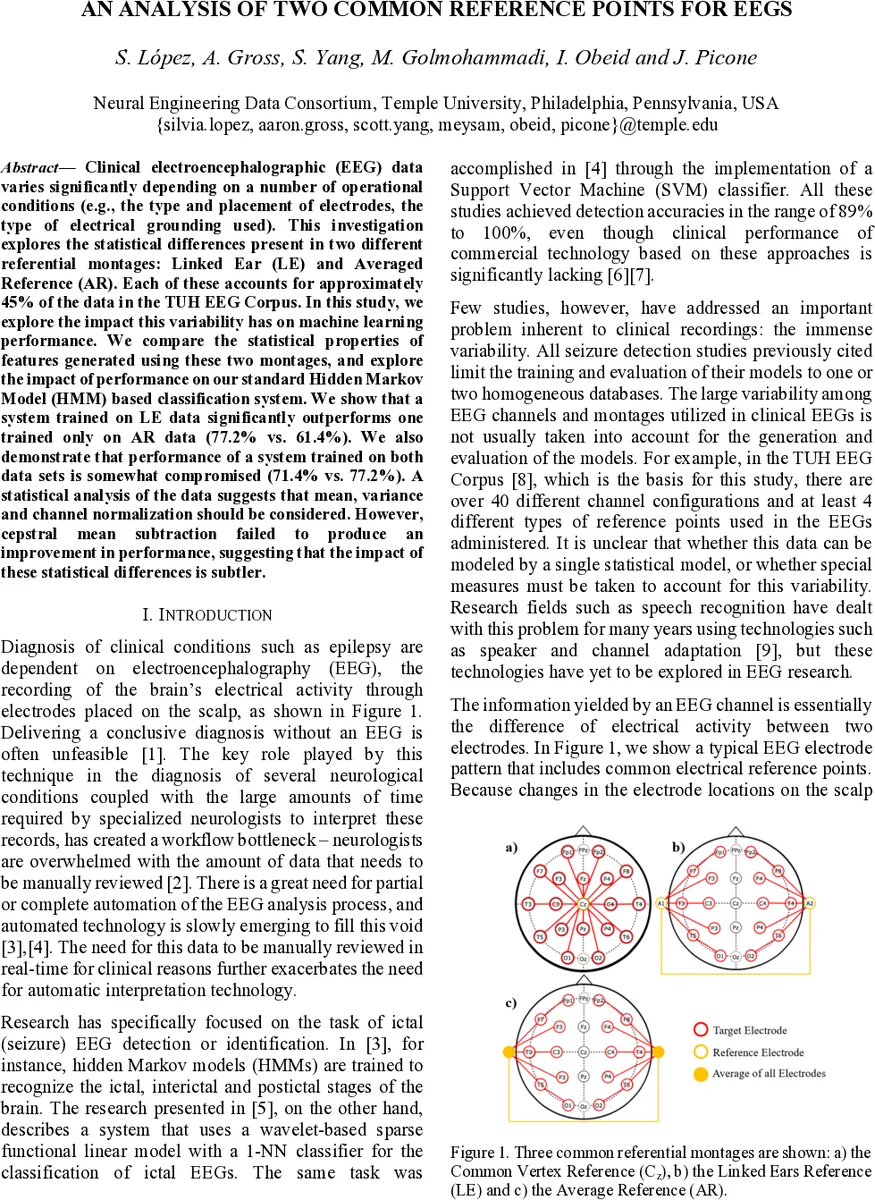

이 논문은 임상 EEG 데이터에서 레퍼런스 전극 선택이 신호 통계와 머신러닝 모델 성능에 미치는 영향을 정량적으로 규명한다. 먼저 TUH EEG 코퍼스에서 LE와 AR이 각각 전체 레코드의 43.8 %와 46.5 %를 차지한다는 사실을 확인하고, 두 그룹을 각각 16,840개(LE)와 17,858개(AR)로 추출해 기초 통계량을 계산하였다. 평균값과 분산을 비교한 결과, 대부분의 기본 특징(에너지, cepstral coefficient 등)에서 두 레퍼런스 간 차이가 크게 나타났으며, 이는 전극 배치와 귀·두피 전도 특성의 비선형성 때문임을 시사한다.

다음 단계에서는 9차원 기본 특징에 대해 공분산 행렬을 구하고 고유값·고유벡터를 추출한 PCA 분석을 수행하였다. LE 데이터는 첫 번째 주성분이 전체 분산의 약 45 %를 차지해 높은 차원 축소 효율을 보였지만, AR은 첫 번째 성분이 약 30 %에 머물러 보다 고차원 정보에 의존한다는 차이를 보였다. 특히 고주파(β대역)와 연관된 고차원 cepstral coefficient가 두 레퍼런스에서 부호가 반대인 고유벡터에 크게 기여함을 확인했다. 이는 레퍼런스 전극이 뇌파의 위상과 진폭에 미치는 미세한 영향을 반영한다.

머신러닝 성능 평가는 HMM 기반 두 클래스(발작 SEIZ, 배경 BCKG) 분류기를 사용했다. 세 가지 학습 시나리오—LE 전용, AR 전용, LE+AR 혼합—를 각각 동일한 훈련·평가 프로토콜(훈련 44레코드/클래스, 평가 10레코드/클래스)으로 수행하였다. 결과는 DET 곡선과 정확도 표로 제시되었으며, LE 전용 모델이 77.2 %의 최고 정확도를 기록한 반면, AR 전용 모델은 61.4 %에 불과했다. 혼합 학습 모델은 71.4 %로 중간 수준이었으며, 이는 두 레퍼런스 간 통계적 편향이 모델 파라미터에 상충 효과를 일으켜 전체 성능을 저하시킨다는 점을 의미한다.

또한 음성 인식에서 효과가 입증된 cepstral mean normalization(CMN)을 EEG에 적용해 보았지만, 오히려 대부분의 경우 성능이 감소하였다. 이는 EEG 신호가 시간·주파수 영역에서 비정상적인 변동성을 보이며, 단순 평균 보정만으로는 레퍼런스 간 차이를 충분히 상쇄하지 못한다는 점을 보여준다.

전체적으로 이 연구는 (1) 레퍼런스 전극 선택이 EEG 신호의 평균·분산·주성분 구조에 실질적인 변화를 일으킨다, (2) 이러한 변화를 무시하고 단일 모델에 모두 적용하면 성능 저하가 발생한다, (3) 기존 음성 처리 기법인 CMN은 EEG에 바로 적용하기엔 한계가 있다,는 세 가지 핵심 인사이트를 제공한다. 향후 연구에서는 레퍼런스 별 적응형 정규화, 도메인 적응 기법, 혹은 레퍼런스 독립적인 특징 추출 방법을 개발해 데이터 혼합 활용도를 높이는 것이 필요하다.

댓글 및 학술 토론

Loading comments...

의견 남기기