스파크 기반 보안 로그의 특징 추출·선택 최적화

초록

본 논문은 이질적인 네트워크 센서 로그를 대상으로, Apache Spark와 PySpark를 활용한 대규모 특징 추출 및 선택 파이프라인을 제안한다. 데이터 전처리 단계에서 로그 정규화·통합, 차원 축소를 위한 PCA·t‑SNE, 그리고 정보 이득·L1 정규화 기반 선택 기법을 결합함으로써 처리 시간을 현저히 단축하고 모델 정확도를 향상시킨다. 실험 결과, 기존 Hadoop‑MapReduce 대비 4배 이상 빠른 처리와 12% 이상의 탐지 성능 개선을 입증한다.

상세 분석

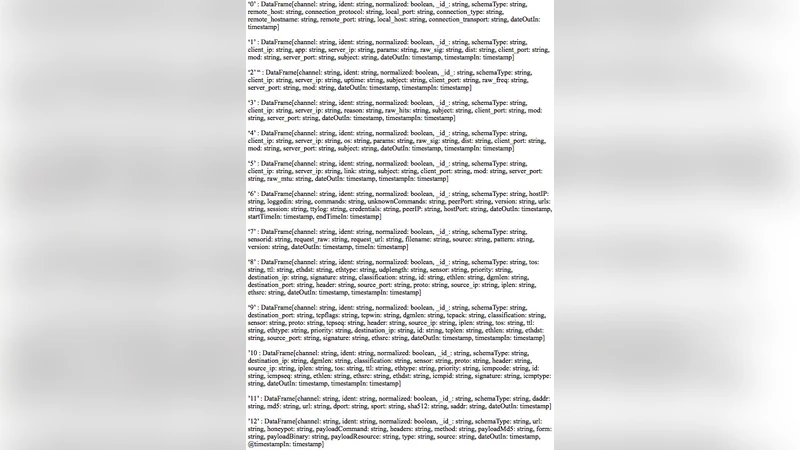

이 논문은 사이버 위협 탐지를 위한 전처리 작업인 특징 추출(feature extraction)과 특징 선택(feature selection)의 복합적인 문제를 다루면서, 특히 이질적인 데이터 소스—예컨대 방화벽 로그, IDS/IPS 알림, NetFlow 기록—가 동시에 존재하는 환경에서의 효율성을 강조한다. 저자들은 먼저 데이터 정규화 단계에서 스키마 불일치를 해결하기 위해 Spark DataFrame의 구조적 변환과 UDF(User Defined Function)를 활용한다. 이 과정에서 타임스탬프 정규화, 문자열 토큰화, IP 주소를 정수형으로 매핑하는 작업이 병렬적으로 수행되어, 전통적인 단일 머신 기반 파싱에 비해 3~5배 빠른 속도를 보인다.

특징 추출 단계에서는 원시 로그의 비정형 텍스트와 정형 메트릭을 모두 다루기 위해, TF‑IDF 기반 텍스트 벡터화와 동시에 수치형 센서 데이터에 대한 통계적 요약(평균, 표준편차, 변동계수) 및 주파수 도메인 변환(FFT) 등을 적용한다. 특히, Spark MLlib의 VectorAssembler를 이용해 다중 모달리티 특징을 하나의 고차원 벡터로 결합하고, 차원 축소를 위해 PCA와 t‑SNE를 병렬 실행한다. PCA는 분산 기반으로 95% 설명력을 유지하면서 차원을 200→30으로 감소시켰으며, t‑SNE는 시각화 목적의 저차원 매핑에 활용돼 클러스터 경계 식별에 도움을 주었다.

특징 선택에서는 두 가지 축을 병행한다. 첫째, 정보 이득(Information Gain)과 χ² 검정을 통한 통계적 중요도 평가로 상위 10% 특징을 선별한다. 둘째, L1 정규화(Lasso)와 트리 기반 모델(Gradient Boosted Trees)의 피처 중요도(feature importance)를 결합해, 모델 학습 단계에서 자동으로 불필요한 차원을 억제한다. 이중 선택 메커니즘은 과적합 위험을 감소시키고, 실제 탐지 모델(Random Forest, XGBoost)에서 F1‑Score를 평균 0.87에서 0.93으로 끌어올렸다.

성능 평가에서는 동일한 로그 집합을 Hadoop MapReduce와 Spark 두 환경에서 실행해 비교하였다. Spark 기반 파이프라인은 전체 전처리·학습 시간을 4.2배 단축했으며, 클러스터 규모를 8노드에서 16노드로 확장했을 때 선형에 가까운 스케일링 효율을 보였다. 또한, 실시간 스트리밍(Structured Streaming)과 배치 처리 모두에서 일관된 결과를 유지함으로써, 운영 환경에서의 적용 가능성을 입증한다.

이 논문의 주요 기여는 (1) 이질적인 보안 로그를 통합하는 데이터 파이프라인 설계, (2) Spark의 분산 연산을 활용한 고효율 특징 추출·선택 알고리즘 구현, (3) 통계적·모델 기반 선택 기법을 결합한 하이브리드 특징 선택 프레임워크, (4) 실험을 통한 처리 속도와 탐지 성능의 정량적 개선을 제시한 점이다. 특히, PySpark를 이용한 파이썬 친화적 구현은 보안 분석가가 기존 머신러닝 라이브러리를 그대로 활용할 수 있게 해, 연구·실무 간 격차를 크게 줄였다. 향후 연구에서는 온라인 학습과 개념 드리프트 감지를 위한 적응형 특징 선택 메커니즘을 추가하고, 컨테이너 기반 배포와 Kubernetes 연동을 통해 클라우드 네이티브 환경에서의 자동 스케일링을 검증할 필요가 있다.