네트워크 상 사적 학습을 위한 무작위 상태 공유 알고리즘

초록

본 논문은 다중 에이전트가 로컬 목적함수의 합을 최소화하는 분산 최적화 문제를 다루며, 정보 교환 시 구조화된 무작위 잡음을 추가해 프라이버시를 보호한다. 두 가지 알고리즘(RSS‑NB, RSS‑LB)을 제안하고, 특히 RSS‑NB의 특수 형태인 함수 공유(FS) 알고리즘이 다항식 목적함수에 대해 네트워크 연결 조건 하에서 강력한 프라이버시 보장을 제공함을 증명한다. 또한 MNIST와 Reuters 데이터셋을 이용한 실험을 통해 정확도 손실 없이 프라이버시를 향상시킬 수 있음을 보여준다.

상세 분석

이 논문은 기존의 분산 그래디언트 하강(DGD) 알고리즘에 구조화된 잡음 삽입을 결합한 두 가지 변형을 제시한다. 첫 번째 변형인 RSS‑NB(Randomized State Sharing – Network Balanced)는 각 에이전트가 이웃에게 동일한 교란된 상태 wᵏ를 전송하고, 교란 벡터 dᵏ는 이웃 간에 교환되는 임의 벡터 sᵏ를 이용해 dᵏ = Σ₍ᵢ∈Nⱼ₎(sᵢ,ⱼᵏ – sⱼ,ᵢᵏ) 로 정의한다. 이 설계는 전체 네트워크에서 Σⱼ dⱼᵏ = 0 을 보장함으로써 평균 잡음이 0이 되도록 하면서도 각 에이전트가 전송하는 값은 비편향 잡음이 포함된 상태가 된다. 잡음 크기 ∥dᵏ∥ ≤ Δ 로 제한하고, Δ가 클수록 프라이버시가 강화되지만 수렴 속도가 느려지는 전형적인 프라이버시‑수렴 트레이드오프가 발생한다. 두 번째 변형인 RSS‑LB(Randomized State Sharing – Locally Balanced)는 각 에이전트가 이웃마다 서로 다른 교란 dⱼ,ᵢᵏ를 생성한다. 여기서는 Bᵏ 행렬(이중 확률 행렬)의 열 가중합이 0이 되도록 로컬 밸런스를 만족시키며, 협업 없이 독립적으로 잡음을 생성할 수 있다. 두 알고리즘 모두 동일한 단계(교란 추가 → 이웃 전송 → 정보 융합 → 투사 그래디언트 하강)를 유지하면서, 잡음이 비편향이지만 평균이 0이 아닌 경우에도 수렴을 보장한다는 점이 핵심이다.

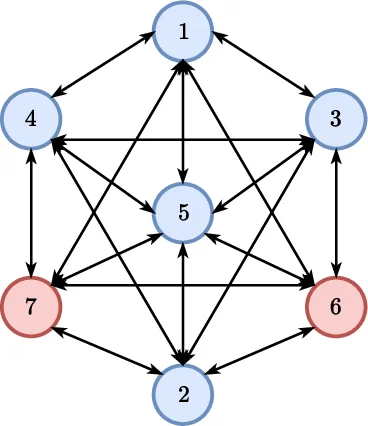

특히 논문은 RSS‑NB의 특수 경우인 함수 공유(FS) 알고리즘을 정의한다. FS에서는 교란이 상태‑의존적이며, 각 에이전트가 자신의 로컬 목적함수 fⱼ(x)를 다항식 형태로 가정하고, 잡음 함수를 이용해 목적함수를 변형한다. 이때 네트워크가 (n‑1)‑연결성을 만족하면, 어느 에이전트도 다른 에이전트의 원본 다항식 계수를 복원할 수 없으며, 이는 강력한 정보‑이론적 프라이버시 보장을 의미한다.

이론적 분석에서는 (i) 잡음이 포함된 업데이트가 여전히 비감소성(가역성) 특성을 유지함을 보이고, (ii) 단계 크기 αₖ가 ∑αₖ = ∞, ∑αₖ² < ∞ 를 만족하면 모든 에이전트의 상태가 전역 최적점 x*에 수렴함을 증명한다. 또한, 잡음의 상한 Δ와 그래디언트 리프시츠 상수 N, 경계 L 사이의 관계를 통해 수렴 속도에 대한 명시적 상한을 도출한다.

실험 부분에서는 MNIST 이미지 분류를 위한 심층 신경망과 Reuters 텍스트 분류를 위한 로지스틱 회귀 모델을 학습한다. Δ 값을 점진적으로 증가시켜 프라이버시 수준을 조절했으며, Δ = 0.1 정도에서는 정확도가 98% 수준(신경망)과 92% 수준(로지스틱 회귀)으로 원본 DGD와 거의 차이가 없었다. Δ를 크게 늘리면 정확도가 약 2~3% 감소하지만, 에이전트 간에 교환되는 값의 변동성이 크게 증가해 프라이버시 위험이 현저히 낮아진다.

전반적으로 이 논문은 잡음의 구조적 설계(네트워크 밸런스 vs 로컬 밸런스)를 통해 비편향 잡음에도 불구하고 확정적 수렴을 보장하고, 다항식 목적함수에 대해 강력한 프라이버시 보호를 제공하는 새로운 프레임워크를 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기