동적 오라클 기반 신경 기계 번역 디코딩 개선

초록

본 논문은 NMT 디코딩 시 학습과 추론 사이의 불일치를 완화하기 위해 Scheduled Sampling의 한계를 보완하는 두 가지 동적 오라클 방법을 제안한다. 하나는 언어 모델을 이용하고, 다른 하나는 사전 학습된 NMT 모델을 활용한다. 실험 결과, 중국어‑영어 번역에서 BLEU 점수가 1점 이상 향상됨을 확인하였다.

상세 분석

이 연구는 신경 기계 번역(NMT)에서 흔히 발생하는 “exposure bias”(노출 편향) 문제를 심도 있게 탐구한다. 기존 Scheduled Sampling은 학습 단계에서 일정 확률로 모델 자체 예측을 사용해 훈련 데이터를 교체하지만, 교체된 토큰이 실제 정답과 일치하지 않을 경우 여전히 금본래(gold) 토큰을 입력으로 사용한다는 정적 오라클(static oracle) 한계를 갖는다. 저자들은 이 문제를 “동적 오라클” 개념을 차용해 해결한다.

첫 번째 방법은 고품질 RNN 기반 언어 모델을 동적 오라클로 활용한다. 모델이 자체 예측 토큰을 선택하면, 언어 모델이 현재까지 생성된 부분 문맥을 기반으로 가장 확률이 높은 토큰을 선택해 다음 입력으로 제공한다. 이때 후보는 전체 어휘가 아니라 현재 소스 문장의 참조(reference) 내에서 제한함으로써 의미적 일관성을 유지한다.

두 번째 방법은 사전 학습된 NMT 모델을 동적 오라클로 이용한다. 이 경우, 언어 모델이 제공하는 토큰보다 더 풍부한 정보를 활용한다. 즉, 소스 문장의 의미를 반영한 번역 후보를 직접 생성하여 다음 단계 입력으로 사용한다. 후보 선택에 어휘 제한을 두지 않아 번역 다양성을 높이고, 원문‑목표문 간의 정합성을 강화한다.

알고리즘 1은 두 방법 모두 공통된 프레임워크를 제시한다. 시간 단계 t에서 확률 p를 샘플링하고, p가 사전 정의된 스케줄 t보다 작으면 모델 자체 예측 ˆy_{t‑1}을 사용한다. 이때 이전에 모델 자체 예측을 사용한 적이 없으면 금본래 토큰 y_{t‑1}을 그대로 사용하고, 이미 사용한 경우에는 동적 오라클이 생성한 ˆy*_{t‑1}을 입력으로 교체한다. 이렇게 함으로써 학습 과정이 점진적으로 “덜 가이드된” 상태로 전이하면서도, 모델이 언제든지 합리적인 입력을 받도록 보장한다.

실험은 1.25M 중국어‑영어 병렬 문장을 사용했으며, NIST 2002‑2005 테스트 세트에서 BLEU 점수를 평가했다. 기본 모델은 attention 기반 cGRU 인코더‑디코더이며, AdaGrad로 최적화하였다. 결과표 1에 따르면, 언어 모델 기반 동적 오라클(SS+LM)은 평균 BLEU 32.71을 기록했고, 사전 학습 NMT 기반 오라클(SS+PRE)은 33.09로 가장 높은 향상을 보였다. 이는 기존 Scheduled Sampling(SS) 대비 각각 약 1.0~1.2점 상승이다.

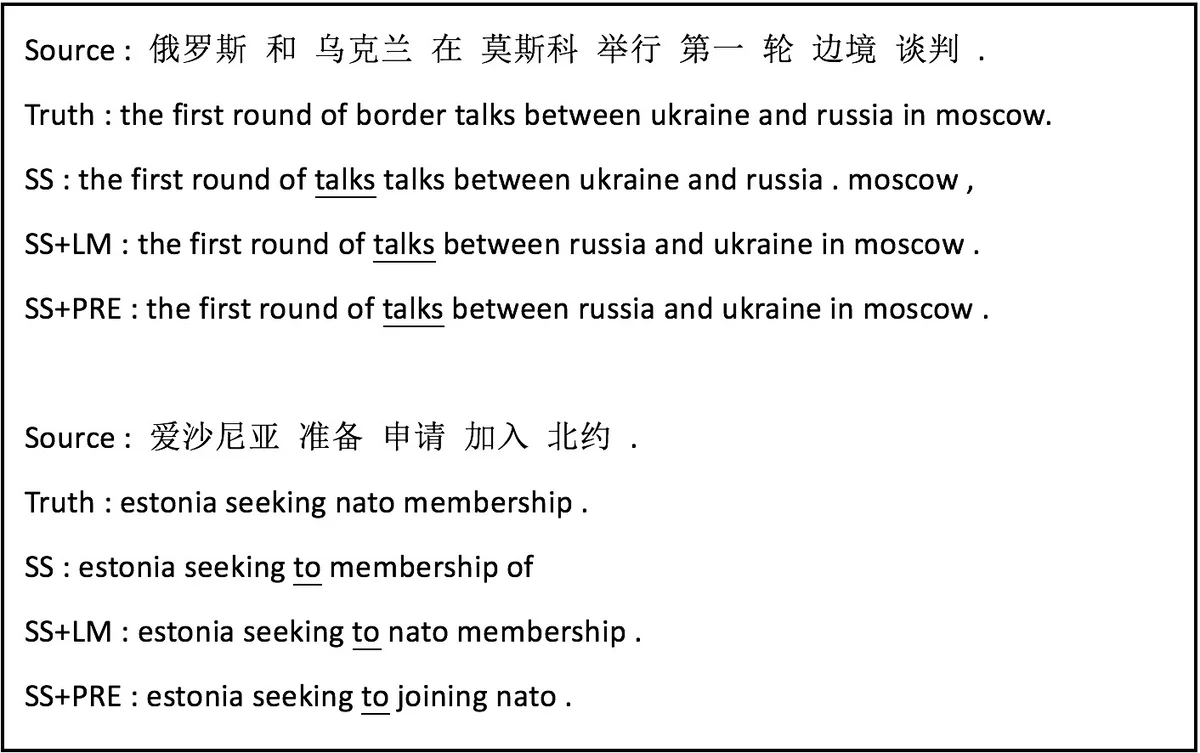

케이스 스터디에서는 Scheduled Sampling이 오류를 일으킨 후에도 금본래 토큰을 계속 사용해 문장이 비논리적으로 흐르는 반면, 동적 오라클은 오류 발생 시 즉시 적절한 대체 토큰을 제공해 문맥을 회복한다는 점을 시각적으로 입증한다. 또한, 사전 학습 오라클은 다중 번역 가능성을 제공해 단일 레퍼런스에 얽매이지 않는 다양성을 모델에 주입한다.

한계점으로는 동적 오라클을 위한 별도 언어 모델·사전 학습 NMT 모델 구축 비용이 추가된다는 점과, 오라클이 제공하는 토큰이 실제 최적 토큰이 아닐 가능성이 존재한다는 점을 들 수 있다. 향후 연구에서는 강화학습 기반 정책 최적화와 오라클 신뢰도 추정 기법을 결합해 더욱 견고한 학습 프레임워크를 설계할 여지가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기